Лучшая LLM для русского языка в 2026: GPT-5.4, Claude 4.6, Gemini 3.1, DeepSeek V3.2 — большое сравнение

Кратко: кто победил

Протестировали 8 моделей на русскоязычных задачах — от бенчмарков MERA до реальной генерации текста — и составили рекомендации по каждому сценарию.

Быстрый ответ:

| Задача | Лучшая модель | Почему |

|---|---|---|

| Код + русские комментарии | Claude Opus 4.6 | SWE-bench 80.8%, лучшее форматирование |

| Логика и рассуждения | Gemini 3.1 Pro | ARC-AGI-2 77.1% — абсолютный рекорд |

| Генерация текстов | GPT-5.4 | Самый стабильный стиль на русском |

| Бюджетный вариант | DeepSeek V3.2 | $0.28/M — в 10× дешевле GPT-5.4 |

| Корпоративный (РФ) | YandexGPT / GigaChat | Российский хостинг, 152-ФЗ |

Почему русский — сложный язык для LLM

Русский язык — один из самых морфологически сложных среди популярных языков:

- 6 падежей существительных (именительный → предложный), каждый меняет окончание

- Словоформы: одно слово «читать» порождает десятки форм — читаю, читаешь, прочитавший, прочитанное…

- Свободный порядок слов: «Мама мыла раму» и «Раму мыла мама» — одинаковый смысл, разный акцент

- Токенизация: русское слово в среднем занимает 1.5–2× больше токенов, чем английское

Это значит, что для русского критичны:

- Объём русскоязычных данных в обучении — больше данных → лучше грамматика

- Качество токенизатора — плохой токенизатор «разрежет» слово на бессмысленные куски

- Инструкционное дообучение на русском — без него модель отвечает грамматически, но не стилистически

Бенчмарки: как мы оценивали

Для объективной картины мы использовали комбинацию метрик:

MERA — русскоязычный бенчмарк

MERA (Multimodal Evaluation for Russian-language Architectures) — открытый бенчмарк для оценки моделей на русском, 21 задача в 11 доменах:

- Понимание текста и логические выводы

- Знания о России (география, история, культура)

- Математика и точные науки на русском

- Генерация и суммаризация русских текстов

LLM Arena RU — голосование живых пользователей

LLM Arena — краудсорсинговая платформа, где пользователи сравнивают ответы двух моделей и голосуют за лучший. Рейтинг строится на статистике Elo.

Стандартные бенчмарки

Дополнительно учитываем:

- GPQA Diamond — научные знания и рассуждения

- ARC-AGI-2 — абстрактная логика

- SWE-bench Verified — реальные задачи из GitHub (кодинг)

- HumanEval — генерация кода

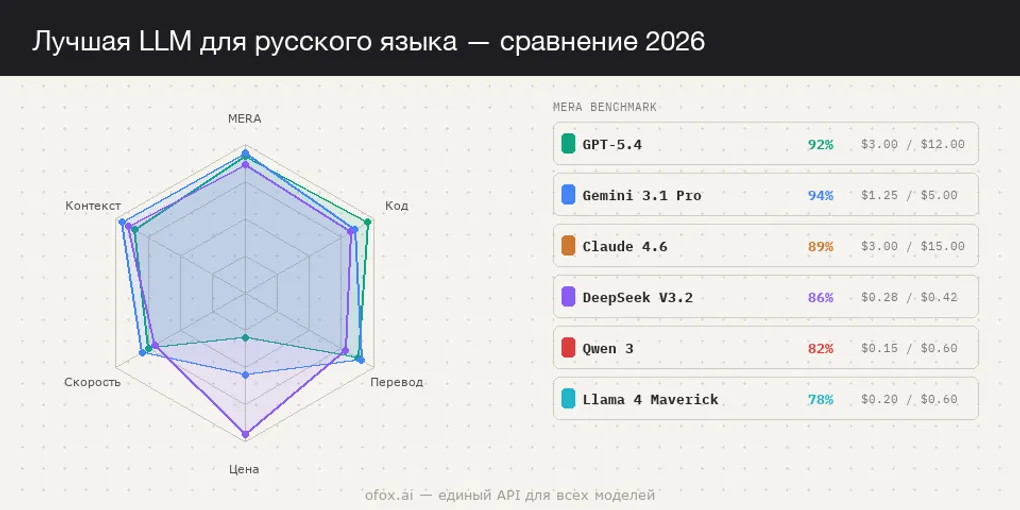

Таблица результатов: 8 моделей, 6 метрик

| Модель | GPQA Diamond | ARC-AGI-2 | SWE-bench | Русский (MERA) | Цена (вход/выход за 1M) | Контекст |

|---|---|---|---|---|---|---|

| Gemini 3.1 Pro | 94.3% | 77.1% | 80.6% | ★★★★☆ | $2 / $12 | 1M |

| GPT-5.4 | 92.8% | 73.3% | 80.2% | ★★★★★ | $2.50 / $15 | 1M |

| Claude Opus 4.6 | 91.3% | 68.8% | 80.8% | ★★★★☆ | $15 / $75 | 1M |

| DeepSeek V3.2 | ~88% | ~65% | ~72% | ★★★★☆ | $0.28 / $0.42 | 128K |

| Claude Sonnet 4.6 | ~89% | ~63% | ~75% | ★★★★☆ | $3 / $15 | 200K |

| GPT-5.4-mini | ~85% | ~58% | ~68% | ★★★☆☆ | $0.40 / $1.60 | 1M |

| YandexGPT 5 Pro | — | — | — | ★★★★☆ | По запросу | 32K |

| GigaChat Max | — | — | — | ★★★☆☆ | По запросу | 32K |

★-рейтинг для русского — агрегированная оценка по MERA, LLM Arena RU и нашим тестам на генерацию, перевод и суммаризацию.

Подробный разбор: топ-4 модели

GPT-5.4 — лучший «русский текст»

Контекст — 1 миллион токенов, максимальный выход — 128K токенов.

Сильные стороны для русского:

- Самый стабильный стиль генерации — русский текст читается естественно, без «машинных» оборотов

- Отличное владение идиомами и разговорными конструкциями

- Надёжная грамматика даже в длинных текстах (падежи, согласование)

- Terminal-Bench 2.0 — 75.1% (агентные задачи)

Слабые стороны:

- Цена: $2.50/$15 — не самый дешёвый вариант

- Иногда «перебарщивает» с формальным стилем в неформальных контекстах

Лучше всего для: генерация статей, документация, маркетинговые тексты на русском.

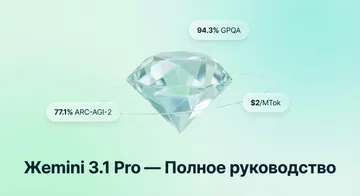

Gemini 3.1 Pro — король рассуждений

Доминирует в 13 из 16 основных бенчмарков.

Сильные стороны для русского:

- ARC-AGI-2 77.1% — абсолютный лидер по абстрактной логике

- GPQA Diamond 94.3% — рекорд по научным знаниям

- Нативная мультимодальность (текст + изображения + аудио + видео)

- Самый дешёвый флагман: $2/$12 за миллион токенов

- Context Caching снижает входную цену до $0.50/M

Слабые стороны:

- Русский текст иногда чуть менее «живой», чем у GPT-5.4

- Время до первого токена (TTFT) ~28 секунд при сложных рассуждениях

Лучше всего для: аналитика, научные задачи, обработка длинных документов.

Claude Opus 4.6 — кодер номер один

SWE-bench Verified — 80.8% (первое место).

Сильные стороны для русского:

- Лучший в мире по реальным задачам из GitHub

- Отлично форматирует код с русскими комментариями

- Нюансированный стиль — понимает тональность, контекст, сарказм

- Превосходная работа с инструкциями на русском

Слабые стороны:

- Самый дорогой: $15/$75 за миллион токенов

- Контекст 1M, но на длинных входах латентность растёт

Лучше всего для: кодинг, code review, сложные аналитические задачи с русским контекстом.

DeepSeek V3.2 — бюджетный чемпион

Объединяет чат и рассуждения в одной модели. Цена: $0.28/$0.42 за миллион токенов, с кэшем — $0.028/M.

Сильные стороны для русского:

- В 10 раз дешевле GPT-5.4, качество русского текста — на уровне 85–90% от GPT-5.4

- Бесплатный чат на chat.deepseek.com

- API доступен без ограничений по региону

- Объединённая модель: одна и та же модель для чата и reasoning-задач

Слабые стороны:

- Контекст 128K (не 1M, как у флагманов)

- Максимальный выход: 8K (чат) / 64K (reasoning)

- В сложных русских идиомах уступает GPT-5.4

Лучше всего для: стартапы, личные проекты, бюджетные чат-боты.

Российские модели: YandexGPT и GigaChat

YandexGPT 5 Pro

- Разработчик: Яндекс

- Плюсы: отличное понимание российских реалий, интеграция с Яндекс.Облаком, данные хранятся в РФ (152-ФЗ)

- Минусы: закрытый бенчмарк, API только через Яндекс.Облако, контекст 32K

- Для кого: крупные российские компании с требованиями к локализации данных

GigaChat Max (Сбербанк)

- Разработчик: Сбер

- Плюсы: интеграция в экосистему Сбера, понимание финансовой терминологии на русском

- Минусы: ограниченный контекст, качество генерации уступает зарубежным флагманам

- Для кого: банковский и финтех-сектор, проекты внутри экосистемы Сбера

Итог по российским моделям: для задач, где критично хранение данных в России и понимание локального контекста — YandexGPT и GigaChat. Для всего остального зарубежные модели значительно впереди.

Сравнение цен: стоимость за миллион токенов

| Модель | Вход ($/M) | Выход ($/M) | В рублях (≈$1=95₽) | Цена за 1000 запросов* |

|---|---|---|---|---|

| DeepSeek V3.2 | $0.28 | $0.42 | 27₽ / 40₽ | ~67₽ |

| DeepSeek V3.2 (кэш) | $0.028 | $0.42 | 2.7₽ / 40₽ | ~43₽ |

| Gemini 3.1 Pro | $2.00 | $12.00 | 190₽ / 1140₽ | ~1330₽ |

| GPT-5.4 | $2.50 | $15.00 | 238₽ / 1425₽ | ~1663₽ |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 285₽ / 1425₽ | ~1710₽ |

| GPT-5.4-mini | $0.40 | $1.60 | 38₽ / 152₽ | ~190₽ |

| Claude Opus 4.6 | $15.00 | $75.00 | 1425₽ / 7125₽ | ~8550₽ |

*Оценка для типичного запроса: ~500 токенов вход, ~1000 токенов выход.

Стратегия экономии: роутинг моделей

Не обязательно использовать одну модель для всего. Умный роутинг снижает затраты в 3–5 раз:

Простые вопросы (80% трафика) → DeepSeek V3.2 ($0.28/M)

Средние задачи (15% трафика) → GPT-5.4-mini ($0.40/M)

Сложные задачи (5% трафика) → GPT-5.4 / Gemini ($2.50/M)При таком распределении средняя стоимость: ~$0.50/M вместо $2.50/M.

Практика: тестируем на Python

Проверим качество русского на реальном примере — генерация ответа на сложный вопрос с падежами и стилистикой:

from openai import OpenAI

client = OpenAI(

base_url="https://api.ofox.ai/v1", # Единый API для всех моделей

api_key="ваш_ключ"

)

models = [

"openai/gpt-5.4",

"google/gemini-3.1-pro-preview",

"anthropic/claude-opus-4.6",

"deepseek/deepseek-v3.2",

]

prompt = """Напиши короткий абзац (3-4 предложения) о том,

почему программисту стоит изучать алгоритмы.

Используй разговорный, но профессиональный стиль.

Обязательно включи хотя бы одну метафору."""

for model in models:

response = client.chat.completions.create(

model=model,

messages=[

{"role": "system", "content": "Ты — опытный русскоязычный технический писатель."},

{"role": "user", "content": prompt}

],

temperature=0.7,

max_tokens=300

)

print(f"\n{'='*50}")

print(f"Модель: {model}")

print(f"{'='*50}")

print(response.choices[0].message.content)Что проверять в ответах

| Критерий | На что смотреть |

|---|---|

| Грамматика | Правильные падежи, согласование рода и числа |

| Стиль | Соблюдение заданного тона (разговорный + профессиональный) |

| Метафора | Насколько уместная и оригинальная |

| Естественность | Читается как текст человека или «робота» |

| Длина | Соблюдение ограничения «3-4 предложения» |

Тест на перевод с сохранением стиля

# Тест: перевод технического текста с сохранением стиля

translation_prompt = """Переведи на русский, сохраняя технический стиль и точность:

"The key insight behind transformer architecture is self-attention:

each token can attend to every other token in the sequence,

enabling the model to capture long-range dependencies

that RNNs struggle with."

Требования:

1. Термины переводи устоявшимися русскими эквивалентами

2. Если устоявшегося перевода нет — оставь английский термин

3. Предложение должно читаться естественно на русском"""

response = client.chat.completions.create(

model="openai/gpt-5.4",

messages=[{"role": "user", "content": translation_prompt}],

temperature=0.3

)

print(response.choices[0].message.content)Какую модель выбрать: рекомендации по задачам

Чат-бот для русскоязычной аудитории

| Бюджет | Модель | Почему |

|---|---|---|

| Минимальный | DeepSeek V3.2 | $0.28/M, качество достаточное для FAQ |

| Средний | GPT-5.4-mini | $0.40/M, лучше стиль на русском |

| Максимальный | GPT-5.4 | $2.50/M, самый естественный русский |

Генерация контента

- Статьи и блоги → GPT-5.4 (стабильный стиль, хорошая структура)

- Маркетинговые тексты → GPT-5.4 или Claude Sonnet 4.6 (креативнее)

- SEO-контент → DeepSeek V3.2 + GPT-5.4 для финальной редактуры

Кодинг с русским контекстом

- Code review → Claude Opus 4.6 (лучший по SWE-bench)

- Генерация кода → GPT-5.4 (Terminal-Bench 2.0 лидер)

- AI-разработка (Cursor, Claude Code) → Любой флагман через кастомный API

Аналитика и рассуждения

- Научный анализ → Gemini 3.1 Pro (GPQA Diamond рекорд)

- Логические задачи → Gemini 3.1 Pro (ARC-AGI-2 лидер)

- Обработка длинных документов → Gemini 3.1 Pro (1M контекст за $2/M)

Как подключить из России

Прямой доступ к API OpenAI, Anthropic и Google из России ограничен. Решение — API-агрегатор: один ключ, один endpoint, все модели. Подробнее — в обзоре альтернатив OpenRouter.

FAQ

Ответы на часто задаваемые вопросы собраны в начале статьи в формате FAQ-карточек.

Итоги

-

Универсального победителя нет. GPT-5.4 лучше в текстах, Gemini 3.1 Pro — в рассуждениях, Claude 4.6 — в коде, DeepSeek V3.2 — по цене. Выбирайте под задачу.

-

Роутинг моделей снижает затраты в 3-5 раз. 80% запросов обработает DeepSeek V3.2, сложные задачи — флагманы.

-

Доступ из России — через API-агрегатор. Подробнее — в сравнении агрегаторов.