Альтернативы OpenRouter в 2026: сравнение агрегаторов LLM API для российских разработчиков

Кратко

- OpenRouter — лидер рынка агрегации LLM API, но не единственный вариант

- Для российских разработчиков критичны три фактора: оплата, задержка и доступ к китайским моделям

- Сравниваем 6 альтернатив по 8 параметрам: модели, цены, задержка, оплата, API-совместимость, поддержка инструментов

- Конкретные рекомендации: какой агрегатор для какого сценария

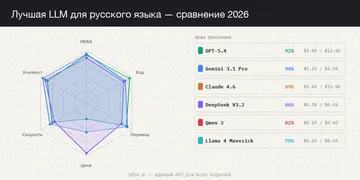

Ищете сравнение самих моделей на русском? Читайте наш обзор LLM для русского языка — бенчмарки MERA, тесты генерации и рекомендации по задачам. Эта статья — про инфраструктуру: через какой сервис подключать модели.

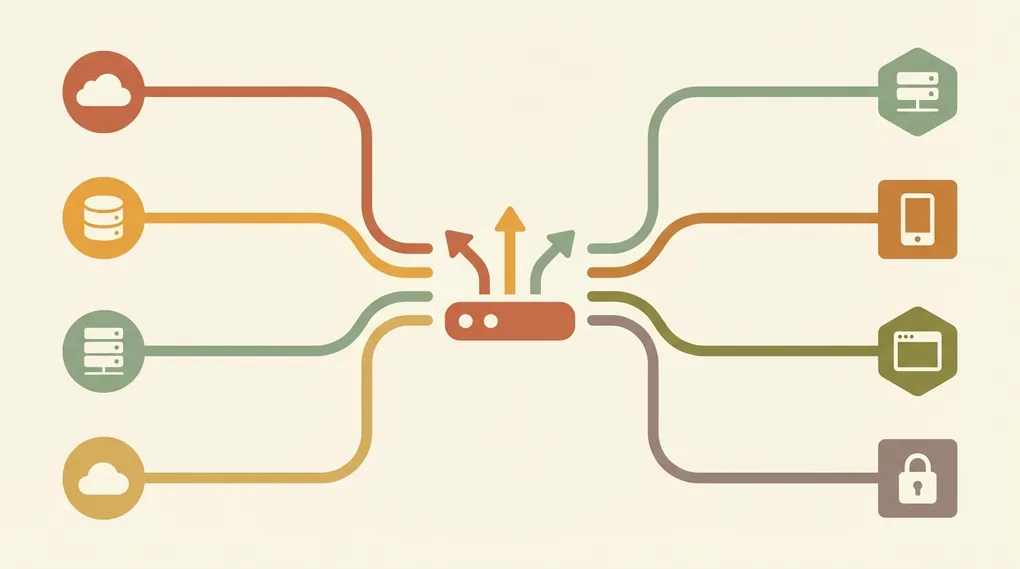

Зачем вообще нужен агрегатор LLM API

Если вы работаете с AI API, рано или поздно вы столкнётесь с проблемой: для разных задач нужны разные модели. GPT-4.1 для сложного рассуждения, Claude Sonnet 4 для генерации кода, Gemini Flash для быстрых ответов, DeepSeek V3 для задач на русском языке.

Без агрегатора это означает:

- Регистрацию у каждого провайдера — OpenAI, Anthropic, Google, DeepSeek

- Несколько API-ключей и разные форматы запросов

- Отдельную оплату в каждом сервисе

- Самостоятельную реализацию fallback-логики и балансировки

Агрегатор решает всё это одним API-ключом и единым endpoint. Вы меняете только параметр model в запросе — всё остальное одинаково.

Главные преимущества агрегатора

| Преимущество | Без агрегатора | С агрегатором |

|---|---|---|

| Количество API-ключей | 4–6 | 1 |

| Формат запросов | Разный у каждого провайдера | Единый OpenAI-совместимый |

| Оплата | Отдельный биллинг везде | Один счёт |

| Fallback при сбоях | Писать самому | Автоматический |

| Новые модели | Интеграция вручную | Доступны сразу |

Проблемы OpenRouter для российских разработчиков

OpenRouter — де-факто стандарт агрегации LLM API. 300+ моделей, стабильный сервис, хорошая документация. Но для разработчиков из России есть три системные проблемы.

Оплата

С 2022 года Visa и Mastercard не работают в России. OpenRouter принимает оплату только через эти системы. Варианты обхода есть (криптовалюта через стороннего платёжного провайдера, виртуальные карты), но они добавляют friction и комиссию.

Задержка

Серверы OpenRouter расположены в США и Европе. Из Москвы средняя задержка до первого токена (TTFT) составляет 800–1500 мс в зависимости от модели и загрузки. Для интерактивных приложений (чат-боты, AI-ассистенты) это заметно.

Китайские модели

OpenRouter не предлагает китайские модели напрямую: ни DeepSeek, ни Qwen, ни Kimi, ни Doubao. Это ограничивает выбор, особенно учитывая, что DeepSeek V3 и Qwen3 показывают отличные результаты на русском языке.

Обзор альтернатив: 6 агрегаторов LLM API

1. OfoxAI

Профиль: Облачный агрегатор с фокусом на азиатских моделях и доступности.

- Модели: 50+ моделей — GPT-4.1, Claude Opus 4.6, Gemini 3.1 Pro, а также эксклюзивные китайские модели: DeepSeek V3, Qwen3, Kimi K2.5

- API: Полностью OpenAI-совместимый (

api.ofox.ai/v1) - Оплата: Криптовалюта, альтернативные методы. Pay-as-you-go без минимальной суммы

- Особенности: Ускоренные узлы для доступа к китайским моделям, низкая задержка для азиатского региона, поддержка Anthropic endpoint (

api.ofox.ai/anthropic)

2. liteLLM

Профиль: Open-source прокси, который можно развернуть самостоятельно.

- Модели: Поддерживает 100+ провайдеров (через ваши собственные ключи)

- API: OpenAI-совместимый

- Оплата: Бесплатно (open-source), но нужен сервер для хостинга

- Особенности: Полный контроль над данными, встроенный роутинг и fallback, управление бюджетом, логирование

3. Novita AI

Профиль: Облачный агрегатор с упором на inference и генерацию изображений.

- Модели: 50+ LLM + модели генерации изображений (Stable Diffusion, FLUX)

- API: OpenAI-совместимый

- Оплата: Карты, криптовалюта

- Особенности: Сильная сторона — генерация изображений. Для чистого LLM API менее оптимизирован

4. proxyapi.ru

Профиль: Российский прокси к OpenAI и Anthropic API.

- Модели: GPT-серия, Claude, ограниченный набор

- API: Проксирует оригинальный OpenAI/Anthropic API

- Оплата: Рубли, российские карты

- Особенности: Простая оплата из России, но ограниченный выбор моделей и заметная наценка

5. aitunnel.ru

Профиль: Ещё один российский прокси-сервис.

- Модели: GPT, Claude, Gemini

- API: OpenAI-совместимый

- Оплата: Рубли

- Особенности: Аналог proxyapi.ru с похожими ограничениями

6. SiliconFlow

Профиль: Китайский облачный inference-провайдер.

- Модели: Сильная сторона — open-source модели: Llama, Qwen, DeepSeek, Mistral

- API: OpenAI-совместимый

- Оплата: Alipay, WeChat Pay, карты

- Особенности: Очень низкие цены на open-source модели, но ограниченный доступ к проприетарным (GPT, Claude)

Сводная таблица: сравнение по 8 параметрам

| Параметр | OpenRouter | OfoxAI | liteLLM | Novita AI | proxyapi.ru | SiliconFlow |

|---|---|---|---|---|---|---|

| Кол-во LLM моделей | 300+ | 50+ | Зависит от ключей | 50+ | ~15 | 30+ |

| Китайские модели | ❌ | ✅ DeepSeek, Qwen, Kimi | Если есть ключи | Частично | ❌ | ✅ Qwen, DeepSeek |

| Оплата из России | Сложно | Крипто, альтернативные | Бесплатно (self-hosted) | Крипто | ✅ Рубли | WeChat/Alipay |

| Pay-as-you-go | ✅ | ✅ | N/A | ✅ | ✅ | ✅ |

| Anthropic endpoint | ❌ | ✅ | ✅ | ❌ | ❌ | ❌ |

| Function Calling | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| Streaming | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| Self-hosted вариант | ❌ | ❌ | ✅ | ❌ | ❌ | ❌ |

Наценки агрегаторов: кто сколько берёт сверху

Основной вопрос при выборе агрегатора — не абсолютная цена модели (она одинакова у всех), а наценка сервиса. Вот реальные данные на март 2026:

| Агрегатор | Наценка к официальной цене | Минимальный депозит | Скрытые комиссии |

|---|---|---|---|

| OpenRouter | 0% (pass-through) | Нет | Нет |

| OfoxAI | 0–5% | Нет | Нет |

| liteLLM | 0% (свои ключи) | Нет (но нужен сервер) | Стоимость хостинга |

| Novita AI | 5–10% | Нет | Нет |

| proxyapi.ru | 30–50% | Нет | Нет |

| aitunnel.ru | 25–40% | Нет | Нет |

| SiliconFlow | 0% (свои модели) | Нет | Нет |

Пример на GPT-4.1 (официальная цена: $2/$8 за 1M токенов):

- OpenRouter / OfoxAI: ~$2/$8 — почти без наценки

- proxyapi.ru: ~$3/$12 — вы платите $4 сверху за каждый миллион выходных токенов

Подробное сравнение моделей (какая LLM лучше для русского, бенчмарки, тесты генерации) — в отдельной статье: Лучшая LLM для русского языка — сравнение 2026. Здесь мы фокусируемся на инфраструктуре.

Задержка и стабильность: что важно из России

Для интерактивных приложений задержка до первого токена (TTFT — Time to First Token) критична. Вот примерные показатели из Москвы:

| Агрегатор | TTFT (GPT-4.1 mini) | TTFT (Claude Sonnet) | Стабильность |

|---|---|---|---|

| OpenRouter | 800–1200 мс | 900–1400 мс | Высокая |

| OfoxAI | 600–1000 мс | 700–1200 мс | Высокая |

| proxyapi.ru | 1000–1500 мс | 1100–1600 мс | Средняя |

| SiliconFlow | 400–700 мс (Qwen/DeepSeek) | N/A | Высокая |

Заметка: Для китайских моделей (DeepSeek, Qwen) SiliconFlow и OfoxAI имеют преимущество за счёт серверов в азиатском регионе. Для западных моделей (GPT, Claude) разница между агрегаторами менее существенна — основная задержка определяется расстоянием до inference-серверов провайдера.

Интеграция с инструментами: Cursor, Claude Code, LangChain

Все перечисленные агрегаторы совместимы с OpenAI API, а значит работают с популярными инструментами. Вот как настроить подключение.

Cursor

В настройках Cursor (Settings → Models → OpenAI API Key):

API Key: ваш-ключ-агрегатора

Base URL: https://api.ofox.ai/v1После этого можно выбрать любую модель из каталога агрегатора прямо в Cursor.

Claude Code

Для работы Claude Code через агрегатор с Anthropic-совместимым endpoint:

export ANTHROPIC_BASE_URL=https://api.ofox.ai/anthropic

export ANTHROPIC_API_KEY=ваш-ключLangChain (Python)

from langchain_openai import ChatOpenAI

llm = ChatOpenAI(

model="openai/gpt-4.1",

base_url="https://api.ofox.ai/v1",

api_key="ваш-ключ"

)

response = llm.invoke("Объясни принцип работы трансформеров")Какой агрегатор выбрать: рекомендации по сценариям

Не существует одного «лучшего» агрегатора — выбор зависит от вашего сценария. Вот конкретные рекомендации.

Индивидуальный разработчик, пет-проект

Рекомендация: OfoxAI или liteLLM (self-hosted)

Вам нужен минимальный порог входа, pay-as-you-go без подписки, доступ к топовым моделям. OfoxAI подходит, если не хотите возиться с инфраструктурой. liteLLM — если уже есть сервер и хотите полный контроль.

Стартап, MVP

Рекомендация: OfoxAI

Быстрый старт, единый биллинг, доступ к 50+ моделям включая китайские. Для MVP скорость выхода на рынок важнее экономии $2 на миллион токенов.

Команда, продакшн

Рекомендация: liteLLM (self-hosted) + OfoxAI как fallback

liteLLM даёт полный контроль: логирование, бюджеты по пользователям, кастомный роутинг. Но нужен DevOps. OfoxAI в качестве резервного канала на случай проблем с прямым доступом к провайдерам.

Только оплата в рублях

Рекомендация: proxyapi.ru или aitunnel.ru

Если оплата в рублях — абсолютный приоритет и вы готовы платить наценку 30–50%, российские прокси — самый простой вариант. Но учтите ограниченный выбор моделей.

Работа с китайскими моделями

Рекомендация: OfoxAI или SiliconFlow

OpenRouter не предлагает DeepSeek и Qwen. SiliconFlow специализируется на open-source моделях с минимальной ценой. OfoxAI объединяет западные и китайские модели в одном API.

Как мигрировать с OpenRouter на другой агрегатор

Миграция между агрегаторами с OpenAI-совместимым API занимает минуты. Основные шаги:

Шаг 1. Зарегистрируйтесь в новом сервисе и получите API-ключ.

Шаг 2. Замените base_url и api_key в вашем коде:

# Было (OpenRouter)

client = OpenAI(

base_url="https://openrouter.ai/api/v1",

api_key="sk-or-..."

)

# Стало (OfoxAI)

client = OpenAI(

base_url="https://api.ofox.ai/v1",

api_key="ваш-новый-ключ"

)Шаг 3. Проверьте названия моделей. У разных агрегаторов могут отличаться идентификаторы:

| Модель | OpenRouter ID | OfoxAI ID |

|---|---|---|

| GPT-4.1 | openai/gpt-4.1 | openai/gpt-4.1 |

| Claude Sonnet 4 | anthropic/claude-sonnet-4 | anthropic/claude-sonnet-4 |

| DeepSeek V3 | N/A | deepseek/deepseek-v3 |

Шаг 4. Протестируйте все эндпоинты: chat completions, streaming, function calling.

Шаг 5. Обновите переменные окружения в CI/CD и на серверах.

Весь процесс обычно занимает 15–30 минут для типичного проекта.

Итоги

- Максимум моделей + китайские LLM + удобная оплата → OfoxAI

- Полный контроль и self-hosted → liteLLM

- Оплата строго в рублях → proxyapi.ru / aitunnel.ru

- Фокус на open-source модели с минимальной ценой → SiliconFlow

Благодаря стандартизации на OpenAI-совместимом формате, миграция между сервисами занимает минуты.