Промпт-инжиниринг для русского языка: 8 техник, которые реально работают в 2026

Зачем это нужно

Один и тот же Claude Opus 4.6 на один и тот же запрос может выдать шаблонную заготовку на три абзаца или точный анализ с конкретными рекомендациями. Разница — в том, как сформулирован вопрос. Почти всегда.

Восемь техник, которые работают для русскоязычных задач.

Техника 1: Дайте модели роль и аудиторию

Без контекста модель отвечает «для всех» — то есть ни для кого.

Слабо: «Объясни, что такое контекстное окно у LLM.»

Сильно: «Ты — технический писатель. Объясни, что такое контекстное окно у LLM, для разработчика, который знает Python, но никогда не работал с AI API. Без академических определений, с примером из реальной задачи.»

В поле «Сильно» добавились: роль, аудитория, ограничение по стилю, конкретный формат вывода. Шанс получить шаблон падает кратно.

Для русскоязычных задач стиль особенно важно указывать явно. «Официально-деловой», «разговорный», «для блога», «как объяснял бы коллеге» — модели понимают это буквально.

Техника 2: Разбивайте сложные задачи на шаги

Один большой запрос работает хуже, чем три последовательных.

Вместо: «Напиши маркетинговую стратегию для SaaS-продукта.»

Цепочка:

- «Я строю B2B SaaS для управления складом малого бизнеса. Назови три главные проблемы моих потенциальных клиентов.»

- «На основе этих проблем предложи пять каналов привлечения клиентов с обоснованием.»

- «Для канала [выбранный из шага 2] составь план на первые 30 дней с метриками.»

Каждый шаг строится на конкретном контексте из предыдущего, а не на абстрактном запросе. Для API-разработчиков это несколько вызовов вместо одного — токенов чуть больше, качество несопоставимо выше.

Техника 3: Используйте примеры (few-shot prompting)

Показать проще, чем описать. Один-два примера убирают большую часть неопределённости.

Допустим, нужны заголовки для Telegram-канала о финансах:

Напиши 5 заголовков для постов в Telegram-канал об инвестициях.

Стиль — как в этих примерах:

- «Почему я закрыл позицию по Сберу и что теперь держу вместо него»

- «Три вещи, которые я понял про облигации только на третьем году»

- «Как я потерял 40% за месяц и что из этого вышло»

Тема новых заголовков: пассивный доход в 2026 году.Модель улавливает стиль, тональность и структуру — личный опыт плюс конкретика — и воспроизводит это для новой темы. Техника одинаково хорошо работает для редактуры, классификации, перевода с сохранением тона.

Техника 4: Управляйте длиной и форматом явно

Модели по умолчанию выдают развёрнутые ответы. Если это не нужно — скажите прямо:

- «Ответь не более чем тремя предложениями.»

- «Структурируй в виде таблицы: Задача / Рекомендуемая модель / Причина.»

- «Дай только итог, без объяснений.»

- «Напиши TL;DR, потом детальное объяснение.»

Для русскоязычного контента отдельно работает: «Не используй шаблонные вводные фразы — “Безусловно”, “Конечно”, “Это важный вопрос”.» Модели знают эти паттерны и умеют их избегать.

Если работаете через API и нужна гарантированная структура — просите JSON. В GPT-5.4 это response_format: {"type": "json_object"}, в Claude — описание схемы в промпте, в Gemini — response_mime_type: "application/json".

Техника 5: Задавайте ограничения, а не только цели

Хорошие промпты описывают не только то, что нужно, но и то, чего быть не должно.

Вместо: «Напиши статью про DeepSeek для нашего блога.»

Лучше: «Напиши статью про DeepSeek V3.2 для технического блога. 800-1000 слов. Не упоминай ChatGPT как ориентир — читатели уже знакомы с OpenAI. Пропусти вводный раздел про LLM — аудитория это знает. Начни с конкретного use case.»

Ограничения экономят итерации. Лучше сказать «не делай X» в первом запросе, чем исправлять X в следующем.

Для русских текстов полезные ограничения: «без канцеляризмов», «активный залог вместо пассивного», «без вводных слов “данный”, “следует отметить”, “необходимо подчеркнуть”».

Техника 6: Используйте chain-of-thought для аналитических задач

Для задач, где важна логика — анализ данных, оценка рисков, сравнение вариантов — просите модель рассуждать вслух перед выводом.

Пример промпта для выбора провайдера:

Я выбираю между двумя API-провайдерами.

Провайдер A: $3/1M токенов, p99 задержка 800ms, 99.5% uptime.

Провайдер B: $1.5/1M токенов, p99 задержка 300ms, 99.9% uptime.

Нагрузка: 500K токенов в день, задержка < 500ms нужна для 95% запросов.

Подумай шаг за шагом, учитывая все факторы, и дай рекомендацию.«Подумай шаг за шагом» — это не украшение. В GPT-5.4 и Gemini 3.1 Pro качество аналитических ответов на такие промпты заметно выше, чем без этой фразы.

У Claude Opus 4.6 есть Extended Thinking — режим, который делает многошаговое рассуждение автоматически для сложных запросов. Через OfoxAI он доступен через API без отдельной подписки у Anthropic.

Техника 7: Итеративное уточнение вместо идеального промпта

Не нужно тратить 20 минут на идеальную формулировку. Быстрее — запустить, посмотреть, уточнить.

- Написали промпт за 30 секунд, запустили.

- Результат не тот — диагностируете: формат? глубина? стиль?

- Добавляете одно уточнение, запускаете снова.

- Повторяете 2-3 раза.

Это дешевле одного долгого промпта, который вы так и не запустили. Хорошие формулировки стоит сохранять — они переиспользуются.

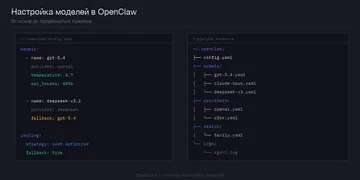

Техника 8: System prompt для специализированных задач

Если строите продукт на AI API — system prompt важнее любого одиночного запроса. Это инструкция, которая задаёт роль и контекст для всей сессии.

Разница между «ты ChatGPT» и нормально написанным system prompt — это разница между универсальным ботом и инструментом, который делает конкретную работу.

Пример для юридического ассистента:

Ты — юридический ассистент для малого бизнеса в России.

Отвечаешь на вопросы о трудовом праве, договорах, налогах для ИП и ООО.

Всегда указывай конкретную статью закона, когда ссылаешься на норму.

Если вопрос требует консультации юриста — говори об этом прямо.

Пиши простым языком без юридических клише.

Никогда не придумывай несуществующие статьи.Как разные модели работают с system prompt:

| Модель | Сильная сторона |

|---|---|

| Claude Opus 4.6 | Точно следует инструкциям, не выходит за рамки роли |

| GPT-5.4 | Хорошо работает с длинными сложными инструкциями |

| Gemini 3.1 Pro | Мощный для многошагового рассуждения в рамках роли |

| DeepSeek V3.2 | Лучший выбор по цене при высоких объёмах |

Как подключить API и начать экспериментировать

Промпт-инжиниринг — штука практическая. Читать про техники полезно, но быстрее прогрессируешь, когда можно за пять минут сравнить, как на один и тот же промпт отвечают GPT, Claude и DeepSeek.

Через OfoxAI это один ключ и один endpoint для 100+ моделей. Меняете model в запросе — никакого другого кода:

from openai import OpenAI

client = OpenAI(

base_url="https://api.ofox.ai/v1",

api_key="ваш_ключ"

)

models = [

"anthropic/claude-opus-4-6",

"openai/gpt-5.4",

"google/gemini-3.1-pro",

"deepseek/deepseek-v3.2"

]

prompt = "Ваш промпт здесь"

for model in models:

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

print(f"\n=== {model} ===")

print(response.choices[0].message.content)Запустили один раз — сразу видно, где разница существенная, а где четыре модели дают примерно одинаковый результат.

Итого

Барьеров для работы с русским языком у современных моделей нет — GPT-5.4, Claude Opus 4.6 и Gemini 3.1 Pro понимают русский уверенно. Разница в качестве ответов почти всегда объясняется качеством постановки задачи.

Из восьми техник выше большинство — это просто привычки. Начните с одной: добавьте роль и аудиторию в следующий запрос и посмотрите, изменится ли результат.