GPT-5.2 API 国内调用指南:三种方案实战对比(2026)

摘要

国内开发者调用 GPT-5.2、Claude、Gemini 等海外大模型 API,面临网络不稳定、支付门槛高、延迟大三大痛点。目前主流解决方案有三种:自建代理节点、云厂商托管服务、API 聚合平台。对于大多数开发者和中小团队,API 聚合平台是性价比最高的选择——统一接口、国内直连、人民币结算、首字节延迟低至 300ms。本文包含三种方案的完整对比、GPT / Claude / Gemini 三家原生 SDK 接入教程和实测数据,帮你 5 分钟内完成接入。

目录

- 问题背景:国内调用海外 AI API 的三大痛点

- 方案一:自建代理节点

- 方案二:云厂商托管服务

- 方案三:API 聚合平台(推荐)

- 三种方案横向对比

- 2026 主流大模型 API 价格对比

- 实战:Python 调用 GPT / Claude / Gemini 完整教程

- 常见问题(FAQ)

- 总结与行动建议

- 参考资料

问题背景:国内调用海外 AI API 的三大痛点

2026 年,GPT-5.2、Claude Opus 4.6、Gemini 3.1 Pro 等大模型已经成为开发者构建 AI 应用的标配。然而,国内开发者在寻找国内稳定 AI API 方案时,普遍遇到三个问题:

1. 网络连接不稳定,OpenAI API 连接超时频发

OpenAI、Anthropic、Google 的 API 端点部署在海外,国内直接请求经常遇到连接超时、SSL 握手失败、响应中断。尤其在 Streaming(流式输出)场景下,长连接断开直接影响用户体验。不少开发者反馈:直连 OpenAI API 的成功率不足 60%,根本无法用于生产环境。

2. 支付门槛高,无法人民币支付 AI API

OpenAI 要求绑定海外信用卡(不支持银联),Anthropic 需要海外手机号注册,Google Cloud 不支持人民币直接结算。对于个人开发者和中小团队,光是注册和充值就要折腾半天——很多人卡在支付环节直接放弃。市场上迫切需要支持支付宝充值 AI API 的解决方案。

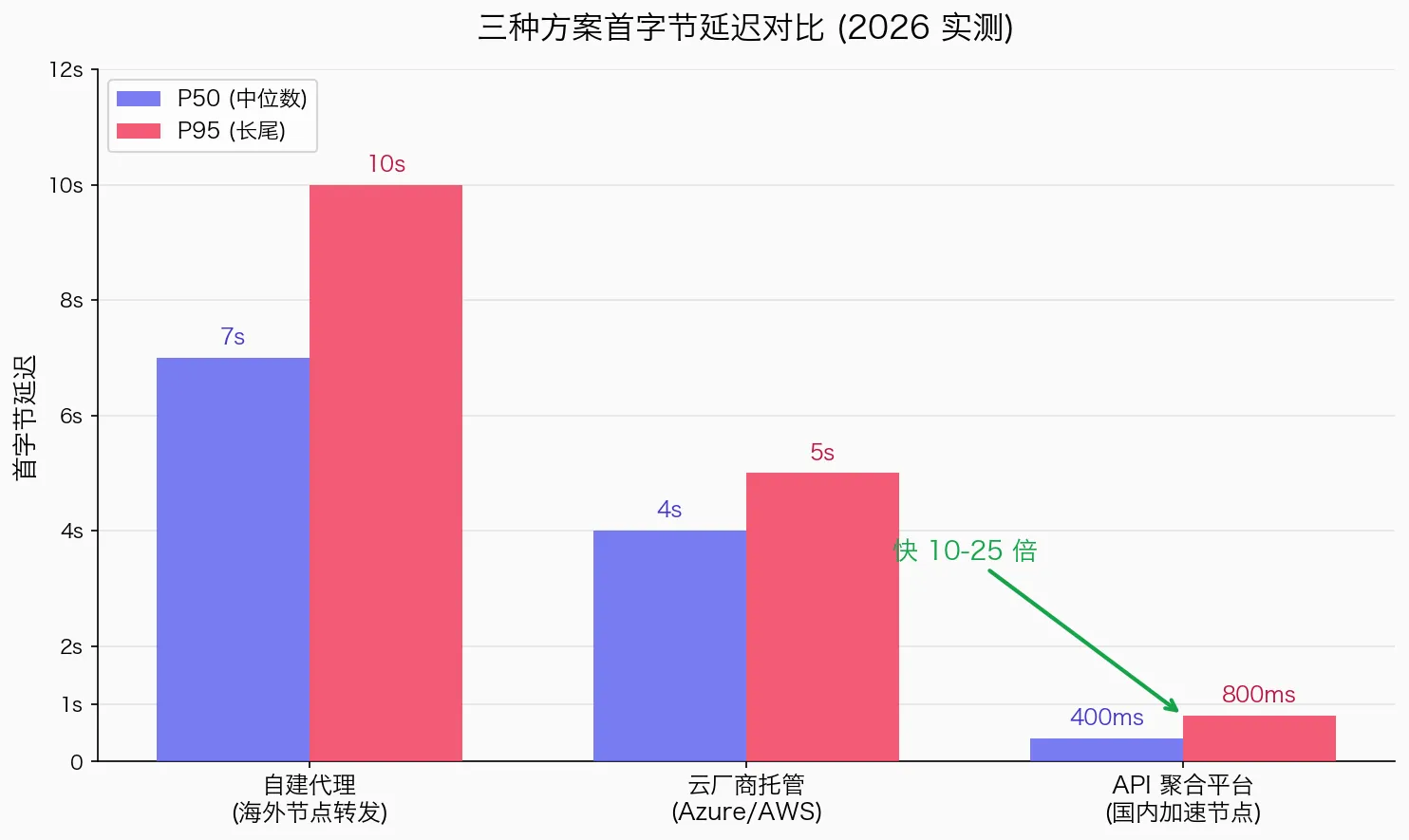

3. 延迟过高,影响产品体验

即使网络能通,国内直连海外 API 的首字节延迟通常在 3-10 秒,而经过优化的国内加速节点可以做到 300-800ms。对于实时对话、代码补全等低延迟场景,这个差距是致命的。用户等 1 秒和等 5 秒的体验天差地别。

那么,有哪些OpenAI API 替代方案?下面逐一分析三种主流思路。

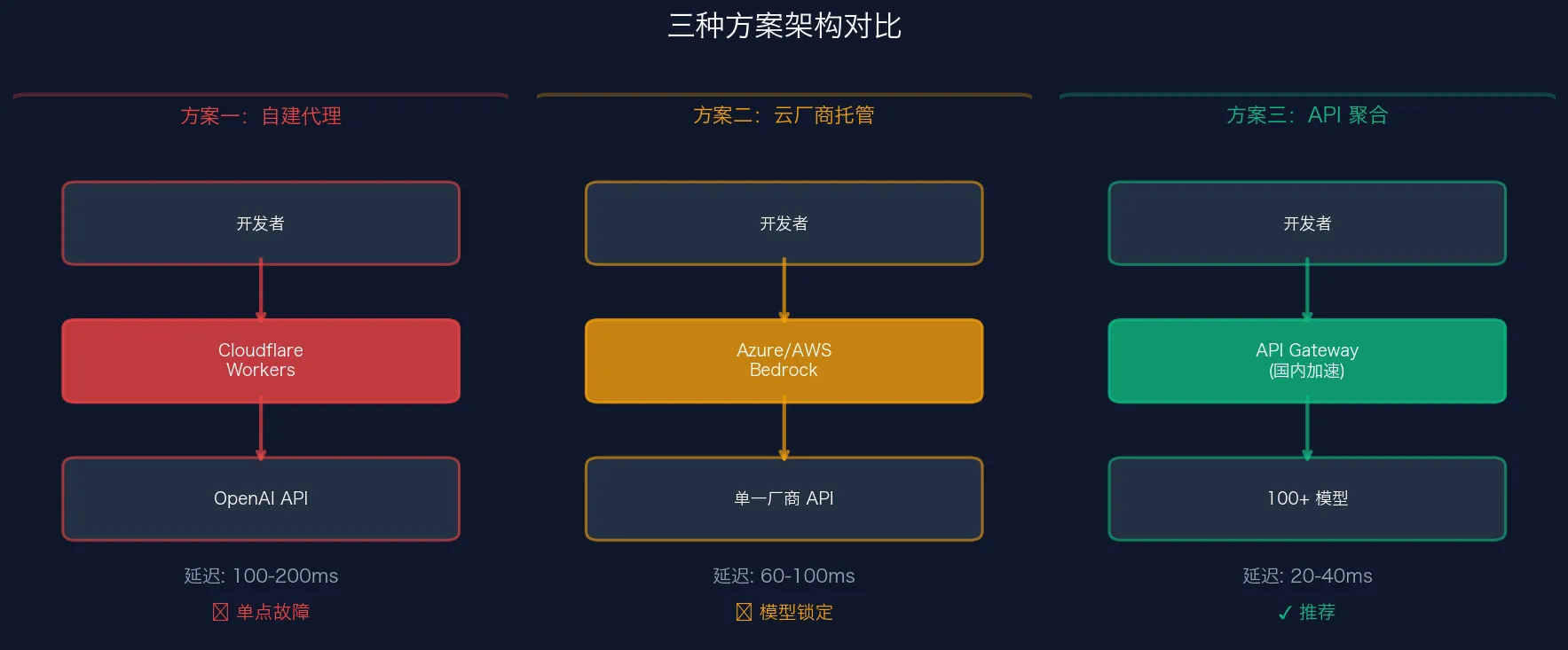

方案一:自建代理节点

原理

在海外云服务器上部署一个反向代理,将国内请求转发到 OpenAI 等 API 端点。常见方式包括 Cloudflare Workers、Nginx 反向代理等。

Cloudflare Workers 示例

// worker.js — 部署到 Cloudflare Workers

export default {

async fetch(request) {

const url = new URL(request.url);

url.hostname = 'api.openai.com';

const newRequest = new Request(url, {

method: request.method,

headers: request.headers,

body: request.body,

});

return fetch(newRequest);

}

};部署后,将 base_url 改为你的 Workers 域名即可。

优缺点分析

| 维度 | 评价 |

|---|---|

| 成本 | 低(Cloudflare Workers 免费额度 10 万次/天) |

| 延迟 | 高(经海外节点转发,首字节延迟 5-10 秒) |

| 模型覆盖 | 仅限单一厂商(每个厂商需要单独配置) |

| 维护成本 | 高(需自行处理限流、错误重试、SSL 证书) |

| 适合场景 | 个人项目、技术探索 |

风险提示

自建代理存在单点故障风险。一旦 Workers 的 IP 段被调整或上游 API 变更,服务会中断且需手动修复。此外,自建方案没有多模型切换能力——如果你同时需要 GPT-5.2 和 Claude,就得部署两套代理。

方案二:云厂商托管服务

原理

通过 Azure OpenAI Service、AWS Bedrock、Google Cloud Vertex AI 等企业级服务来调用大模型。

Azure OpenAI 示例

from openai import AzureOpenAI

client = AzureOpenAI(

azure_endpoint="https://your-resource.openai.azure.com/",

api_key="your-azure-key",

api_version="2024-12-01-preview"

)

response = client.chat.completions.create(

model="gpt-5.2", # 你在 Azure 上部署的模型名

messages=[{"role": "user", "content": "解释什么是 RAG"}]

)

print(response.choices[0].message.content)优缺点分析

| 维度 | 评价 |

|---|---|

| 成本 | 高(Azure 价格比 OpenAI 官方贵 10-30%,还有云资源费) |

| 延迟 | 中(Azure 东亚节点首字节延迟约 3-5 秒) |

| 模型覆盖 | 有限(Azure 仅 OpenAI 模型,Bedrock 仅部分 Anthropic 模型) |

| 维护成本 | 中等(需管理多个云账号和 SDK) |

| 适合场景 | 企业级项目、有合规要求的场景 |

限制

最大的问题是模型锁定。用 Azure OpenAI 就只能调 OpenAI 的模型。想同时用 Claude 和 Gemini?你需要分别开通 AWS Bedrock 和 Vertex AI,维护三套账号、三套 SDK、三套计费。复杂度指数级增长。

方案三:API 聚合平台(推荐)

原理

API 聚合平台(也叫 AI Gateway、大模型 API 中转服务)在国内部署加速节点,统一对接多家模型厂商,向开发者提供兼容 OpenAI、Anthropic、Gemini 三大协议的原生接口。只需将 SDK 的 base_url 指向平台节点,现有代码无需任何改动——这也是目前最主流的 OpenAI API 替代方案。

核心优势

- 三协议原生:OpenAI、Anthropic、Gemini 三家原生 SDK 直连,保留各家完整功能特性

- 国内直连:阿里云/火山云加速节点,无需额外网络配置即可低延迟访问

- 人民币支付:支持支付宝、微信支付,无需海外信用卡

- 低延迟:国内节点首字节延迟 300-800ms,远优于直连海外

- 团队模式:一人注册全员共享,成员消耗用量一目了然,特别适合团队协作

- 自动容错:上游 API 故障时自动切换备用通道

代码示例:三家原生 SDK 直连

以 Ofox.ai 为例,三大模型厂商的原生 SDK 均可直连,只需将 base_url 指向 Ofox:

OpenAI SDK — 调用 GPT-5.2(Responses API)

# SDK: openai v2.24.0

# 文档:https://platform.openai.com/docs/api-reference/responses

# 更新:2026-03-03

from openai import OpenAI

client = OpenAI(

base_url="https://api.ofox.ai/v1",

api_key="your-ofox-api-key" # 在 app.ofox.ai 获取

)

response = client.responses.create(

model="openai/gpt-5.2",

input="用 Python 实现一个简单的 RAG 系统",

)

print(response.output_text)Anthropic SDK — 调用 Claude Opus 4.6

# SDK: anthropic v0.84.0

# 文档:https://docs.anthropic.com/en/api/getting-started

# 更新:2026-03-03

import anthropic

client = anthropic.Anthropic(

base_url="https://api.ofox.ai/anthropic",

api_key="your-ofox-api-key"

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "用 Python 实现一个简单的 RAG 系统"}],

)

print(message.content[0].text)Google GenAI SDK — 调用 Gemini 3 Flash

# SDK: google-genai v1.65.0

# 文档:https://googleapis.github.io/python-genai/

# 更新:2026-03-03

from google import genai

client = genai.Client(

api_key="your-ofox-api-key",

http_options={"base_url": "https://api.ofox.ai/gemini"}

)

response = client.models.generate_content(

model="google/gemini-3-flash-preview",

contents="用 Python 实现一个简单的 RAG 系统",

)

print(response.text)三家 SDK 的接口完全不同(responses.create / messages.create / generate_content),但通过 Ofox 都可以国内直连、统一计费。每个 SDK 都保留了各家的完整功能特性——Claude 的 extended thinking、Gemini 的 2M 超长上下文、GPT 的 web search 等高级功能都可直接使用。

为什么开发者选择 Ofox?

- 三协议兼容:同时支持 OpenAI、Anthropic、Gemini 原生协议,业内少有

- 数据安全:全程 TLS 1.3 加密传输,不存储请求/响应内容,仅记录调用量用于计费

- 透明计费:用多少付多少,后台实时查看用量和费用明细

- 团队模式:一人注册全员共享,成员独立 API Key,用量消耗一目了然

- 企业支持:支持开具增值税发票,提供技术支持

优缺点分析

| 维度 | 评价 |

|---|---|

| 成本 | 低(通常比官方便宜,新用户有免费额度) |

| 延迟 | 低(国内加速节点,300-800ms) |

| 模型覆盖 | 广(100+ 模型,一个 Key 全搞定) |

| 维护成本 | 极低(改一行 base_url 即可) |

| 适合场景 | 个人开发者到中型团队的绝大多数场景 |

立即体验:注册 Ofox.ai,新用户有免费额度,支持支付宝/微信支付。查看开发文档 →

三种方案横向对比

| 对比维度 | 自建代理 | 云厂商托管 | API 聚合平台 |

|---|---|---|---|

| 接入难度 | 中(需部署运维) | 中(需开通多个云服务) | 极低(改 base_url) |

| 首字节延迟 | 5-10 秒 | 3-5 秒 | 300-800ms |

| 模型覆盖 | 单一厂商 | 2-3 个厂商 | 100+ 模型 |

| 支付方式 | 需海外信用卡 | 云厂商账单 | 支付宝/微信 |

| 月均成本(1M tokens) | ¥50-80 + 服务器 | ¥80-120 | ¥35-60 |

| 多模型切换 | 需多套代理 | 需多套 SDK | 三家原生 SDK 直连 |

| 运维负担 | 高 | 中 | 无 |

| 适合阶段 | 技术验证 | 企业合规 | 从原型到生产 |

从上表可以看出,2026 年的 AI API 价格对比中,API 聚合平台在几乎所有维度都占优,尤其对于追求国内稳定 AI API 的开发者来说是最优选择。

2026 主流大模型 API 价格对比

以下是 2026 年 3 月各主流大模型的 API 定价(每百万 tokens,单位:美元):

| 模型 | 输入价格 | 输出价格 | 上下文窗口 | 特点 |

|---|---|---|---|---|

| GPT-5.2 | $1.75 | $14.00 | 256K | OpenAI 最新旗舰 |

| GPT-4o | $2.50 | $10.00 | 128K | 性价比之选 |

| Claude Opus 4.6 | $15.00 | $75.00 | 200K | 最强推理能力 |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 200K | 编码利器 |

| Gemini 3.1 Pro | $2.00 | $12.00 | 2M | 超长上下文 |

| Gemini 3 Flash | $0.50 | $3.00 | 1M | 极致性价比 |

| DeepSeek V3.2 | $0.27 | $1.10 | 128K | 国产之光 |

省钱提示:通过 API 聚合平台调用,价格通常比官方直连更优惠,因为平台会利用批量采购和智能缓存来降低成本。具体定价请查看各平台官网。查看 Ofox 最新定价 →

实战:Python 调用 GPT / Claude / Gemini 完整教程

下面演示如何使用三家原生 SDK 通过 Ofox 快速接入,每个示例都包含普通调用和流式输出。在 app.ofox.ai 注册获取 API Key 后即可运行。

OpenAI SDK — GPT-5.2 Responses API

# SDK: openai v2.24.0

# 文档:https://platform.openai.com/docs/api-reference/responses

# 更新:2026-03-03

from openai import OpenAI

client = OpenAI(

base_url="https://api.ofox.ai/v1",

api_key="your-ofox-api-key"

)

# 普通调用

response = client.responses.create(

model="openai/gpt-5.2",

input="用一句话解释什么是 RAG",

)

print(response.output_text)

# 流式输出

stream = client.responses.create(

model="openai/gpt-5.2",

input="写一个 Python 装饰器实现函数缓存",

stream=True,

)

for event in stream:

if event.type == "response.output_text.delta":

print(event.delta, end="", flush=True)Anthropic SDK — Claude Opus 4.6

# SDK: anthropic v0.84.0

# 文档:https://docs.anthropic.com/en/api/getting-started

# 更新:2026-03-03

import anthropic

client = anthropic.Anthropic(

base_url="https://api.ofox.ai/anthropic",

api_key="your-ofox-api-key"

)

# 普通调用

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "用一句话解释什么是 RAG"}],

)

print(message.content[0].text)

# 流式输出

with client.messages.stream(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "写一个 Python 装饰器实现函数缓存"}],

) as stream:

for text in stream.text_stream:

print(text, end="", flush=True)Google GenAI SDK — Gemini 3 Flash

# SDK: google-genai v1.65.0

# 文档:https://googleapis.github.io/python-genai/

# 更新:2026-03-03

from google import genai

client = genai.Client(

api_key="your-ofox-api-key",

http_options={"base_url": "https://api.ofox.ai/gemini"}

)

# 普通调用

response = client.models.generate_content(

model="google/gemini-3-flash-preview",

contents="用一句话解释什么是 RAG",

)

print(response.text)

# 流式输出

for chunk in client.models.generate_content_stream(

model="google/gemini-3-flash-preview",

contents="写一个 Python 装饰器实现函数缓存",

):

print(chunk.text, end="", flush=True)三段代码展示了三家 SDK 的核心差异:接口名称、参数格式、响应结构完全不同。但通过 Ofox,它们都可以国内直连、统一计费——你无需折衷,每个 SDK 都能发挥各家的完整能力。

**跟着代码试试?**先 免费注册获取 API Key(1 分钟搞定)。完整 SDK 文档和更多语言示例请参考 Ofox 开发者文档。

常见问题(FAQ)

Q: 国内使用 GPT-5.2 API 需要额外的网络配置吗?

A: 不需要。通过 API 聚合平台接入,国内网络即可直连,无需任何额外配置。平台在阿里云/火山云部署了加速节点,你的请求会自动路由到最近的节点,首字节延迟 300-800ms。

Q: API 聚合平台的数据安全有保障吗?AI API 数据会泄露吗?

A: 正规的聚合平台采用 TLS 1.3 加密传输,不存储用户的请求和响应内容(仅记录调用量用于计费)。以 Ofox 为例,所有数据传输加密且不落盘,API Key 权限可精细控制。对于高度敏感数据的企业场景,也可以考虑 Azure OpenAI 等有合规认证的方案。

Q: 从 OpenAI 官方迁移到聚合平台需要改多少代码?

A: 通常只需改 base_url 指向 Ofox。平台同时兼容 OpenAI、Anthropic、Gemini 三家原生 SDK,各家的完整功能特性(Responses API、extended thinking、超长上下文等)均可直接使用。Streaming、JSON Mode 等高级特性也完全支持。

Q: 如何选择性价比最高的大模型 API?

A: 取决于你的使用场景。日常对话和内容生成推荐 GPT-4o 或 Claude Sonnet 4.6(性价比最佳);复杂推理和数学推荐 Claude Opus 4.6 或 GPT-5.2;超长文本处理推荐 Gemini 3.1 Pro(2M 上下文);预算敏感场景推荐 DeepSeek V3.2 或 Gemini 3 Flash。通过聚合平台,你可以在同一项目中灵活切换,找到最佳平衡点。

Q: AI API 免费额度一般有多少?

A: 大部分聚合平台提供注册赠送的免费额度,具体金额请查看各平台官网。建议先用免费额度跑通流程,确认延迟和效果满意后再正式充值。充值支持支付宝和微信支付。

Q: Ofox 有哪些核心优势?

A: Ofox 是目前少数同时支持三套原生协议的平台(OpenAI、Anthropic、Gemini),可以直接使用 Claude extended thinking、Gemini 长上下文等厂商特有功能,而不仅仅是兼容的「最大公约数」。此外 Ofox 的团队模式特别适合中小团队——管理员一人注册充值,团队成员各自使用独立 API Key,后台可查看每人的调用量和费用明细。

Q: 企业大量调用有折扣吗?

A: 有。Ofox 提供阶梯定价,月调用量越大单价越低。企业客户还可以获得专属技术支持、SLA 保障和增值税发票。具体折扣力度可在 Ofox 控制台 查看或联系商务咨询。

Q: 支持哪些编程语言的 SDK?

A: Ofox 同时兼容 OpenAI、Anthropic、Gemini 三家原生 SDK,这三家都提供 Python、TypeScript、Java、Go 等多语言官方 SDK。只需在现有 SDK 中修改 base_url 指向 Ofox 即可。各语言接入示例 →

Q: 免费额度用完后怎么充值?

A: 在 Ofox 控制台 直接充值,支持支付宝和微信支付,人民币结算,无最低消费。充值后额度实时到账,计费按实际 token 用量,后台可实时查看消费明细。

Q: 如何监控 API 使用量和费用?

A: Ofox 控制台提供实时用量仪表盘,可查看每个模型的调用次数、token 消耗、费用明细和响应延迟。还支持设置用量预警,当余额不足或日调用量异常时自动通知,方便做好 AI API 成本优化。

总结与行动建议

2026 年国内开发者调用海外大模型 API,API 聚合平台已经从「临时方案」变成了「默认基础设施」。统一接口降低了切换成本,国内直连解决了延迟问题,人民币结算消除了支付门槛。无论你是在找国内直连 GPT 的方案,还是需要一个国内稳定 AI API 服务,聚合平台都是当前最优解。

你的下一步行动:

- 注册获取 API Key:免费注册 Ofox.ai,1 分钟完成

- 改两行代码:把

base_url改为https://api.ofox.ai/v1,填入你的 API Key - 跑通第一个请求:用本文的代码示例验证连通性和延迟

- 探索更多模型:试试 Claude、Gemini、DeepSeek,找到最适合你场景的模型

- 接入生产环境:确认效果后,将线上 API 调用逐步切换

5 分钟开始使用:

- 新用户注册有免费额度

- 无需信用卡,支持支付宝/微信支付

- 兼容 OpenAI / Anthropic / Gemini 三家原生 SDK

- 100+ 模型,国内直连低延迟

推荐阅读

- Python 调用 Claude API 国内完整教程 — 从零开始接入 Claude Opus/Sonnet

- 2026 AI API 价格对比:GPT vs Claude vs Gemini — 7 大模型成本详细对比

- AI 聊天机器人开发实战:从 0 到 1 搭建智能客服 — 完整项目教程

参考资料

- OpenAI API 官方文档 — Responses API、Chat Completions 等完整接口文档,访问日期:2026-03-03

- Anthropic Claude API 文档 — Claude 系列模型接入指南,访问日期:2026-03-03

- Google Gemini API 文档 — google-genai SDK v1.65.0 官方文档,访问日期:2026-03-03

- Azure OpenAI Service 定价 — 企业级托管服务定价

- Ofox.ai 开发者文档 — 快速接入指南和多语言 SDK 示例,访问日期:2026-03-03

- LLM API Gateway 架构与成本优化全解 - 阿里云 — AI API 网关技术深度解析

验证记录

本文代码示例已于 2026-03-03 按以下标准核验:

| SDK | 包名 | 版本 | 验证方式 | 结论 |

|---|---|---|---|---|

| OpenAI | openai | v2.24.0 | PyPI + 官方文档 | responses.create + output_text 正确 ✓ |

| Anthropic | anthropic | v0.84.0 | PyPI + 官方文档 | messages.create + content[0].text 正确 ✓ |

google-genai | v1.65.0 | PyPI + Ofox 文档 | genai.Client(http_options) Ofox 支持 ✓ |

核验说明:

- 三家 SDK 各自独立,互不兼容,遵循各厂商原生协议

- Google GenAI SDK 的

http_options.base_url通过 Ofox 网关路由支持 - 模型 ID 以 Ofox 路由层命名为准(如

openai/gpt-5.2、google/gemini-3-flash-preview)