OpenRouter 使用完全指南 2026:注册、充值、API 调用,国内开发者必看

国内开发者搜 AI API 聚合平台时,OpenRouter 的名字绕不开。300+ 模型、5M+ 用户,GitHub 上随便搜 Claude 或 GPT 的项目,配置示例清一色指向 openrouter.ai。

但国内开发者用起来,体验和海外用户差别挺大。本文把注册、充值、API 调用全流程拆清楚,也会说说国内访问的真实情况。

OpenRouter 是什么

OpenRouter 是一个 AI API 中转聚合平台。用一个 API Key 和同一个 endpoint,可以调用 OpenAI、Anthropic、Google、Meta、MiniMax、DeepSeek 等 60+ 厂商的 300+ 模型。

主要用途是:如果你需要同时测多家模型,或者想在不同模型间做自动 fallback,不用去每家厂商分别申请 Key 和管理账单。

API 格式是 OpenAI 兼容标准,endpoint 是 https://openrouter.ai/api/v1,模型名称用 provider/model-name 格式,比如 anthropic/claude-sonnet-4-6、openai/gpt-5.4、google/gemini-3.1-pro-preview。改两行配置,现有 OpenAI SDK 项目基本直接跑。

注册流程

注册页面在 openrouter.ai,支持 Google 或 GitHub 账号 OAuth 一键授权,不用填邮件、不用手机验证。

注册后进入 Dashboard,在 Keys 页面创建 API Key。免费账号不填信用卡也能拿到 Key,但每天只能调用 5 次。

充值

这里是国内开发者最容易卡住的地方。

OpenRouter 支持两种充值方式:美元信用卡(Visa/Mastercard)和 USDC 加密货币,两种都收手续费。不支持支付宝、微信支付和银联,也没有人民币定价。

每次充值最低 $10,定价直通各厂商官方价格,OpenRouter 本身不加价。充值 $5 以上后,免费模型的每日调用上限从 5 次涨到 200 次。

没有国际信用卡又不想折腾加密货币,这道门槛就比较硬。后面会说替代方案。

API 调用

接入方式很直接:

import openai

client = openai.OpenAI(

base_url="https://openrouter.ai/api/v1",

api_key="sk-or-xxxxxxxx",

)

response = client.chat.completions.create(

model="anthropic/claude-sonnet-4-6",

messages=[{"role": "user", "content": "你好"}]

)模型名称必须带 provider 前缀,这是 OpenRouter 格式和 OpenAI 原生格式最主要的区别。原来用 gpt-4o 的,切到 OpenRouter 后要写 openai/gpt-5.4 或 openai/gpt-4o。

免费模型

OpenRouter 有一批免费模型,在模型列表页按价格 $0 过滤可以看全。

| 账号状态 | 每日免费调用次数 |

|---|---|

| 未充值 | 5 次 |

| 已充值 $5+ | 200 次 |

200 次/天够个人测试用,跑生产不够。免费模型的响应速度和优先级也低于付费调用。

国内访问情况

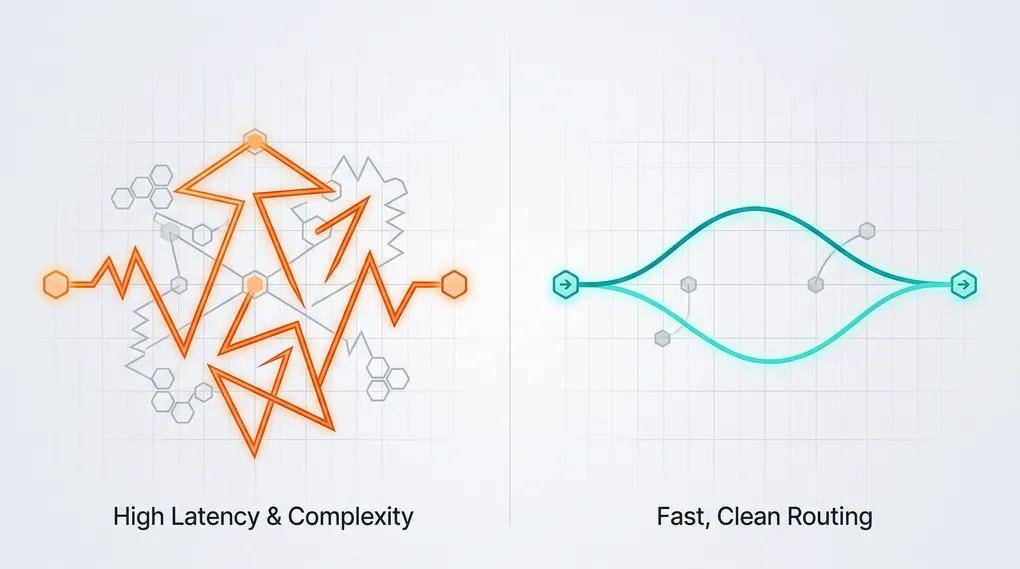

OpenRouter 服务器部署在海外,没有国内加速节点。实测首 Token 延迟(P50,Claude Sonnet 4.6):走代理大概 600–1200ms,国内直连 1500–3000ms 且不稳定。

高峰时段超时率明显。日常聊天还好,用在 Cursor、Claude Code、OpenClaw 这类 AI 编程工具里——模型调用很频繁——延迟和超时会让开发体验很糟。很多国内用户的反馈是”隔一会就断”。

批量文本处理、不要求实时响应的场景,国内用 OpenRouter 问题不大。

国内替代选项

OfoxAI 是针对国内开发场景做过优化的选项,对比如下:

| OpenRouter | OfoxAI | |

|---|---|---|

| 国内直连延迟 | 1500–3000ms | 200–500ms |

| 支付方式 | 美元信用卡 / USDC | 支付宝 / 微信 / 加密货币 |

| 模型数量 | 300+ | 100+ 主流模型 |

| OpenClaw 原生支持 | 需手动配置 | 一键集成 |

| Claude Code 原生 API | 需适配 | 原生 Anthropic 格式端点 |

OfoxAI 同样是 OpenAI 兼容格式,base_url 换成 https://api.ofox.ai/v1 就行,迁移成本基本为零。详细的功能对比和迁移步骤参考这篇:OfoxAI vs OpenRouter 功能对比与迁移指南。

两者怎么搭配用

大多数国内开发者是两个都用的,用途分得比较清:

需要 OfoxAI 没有的冷门开源模型、或者本身在海外、或者做大规模多模型横评时,用 OpenRouter。

日常 AI 编程(OpenClaw、Claude Code、Cursor、Cline)、需要人民币支付、对延迟敏感、需要 Anthropic 原生格式端点时,用 OfoxAI。

如果你用 OpenClaw 做主力工具,直接配 OfoxAI 是最省事的——初始化配置可以看这篇教程。

工具集成配置(如果选 OpenRouter)

OpenClaw:custom instructions → LLM API key 填 OpenRouter Key,base URL 填 https://openrouter.ai/api/v1,模型格式 anthropic/claude-sonnet-4-6。

Cursor:Settings → Models → OpenAI API Key 填 OpenRouter Key,Base URL 填 https://openrouter.ai/api/v1,模型 ID 同上。

Claude Code(OpenAI 兼容模式):设置环境变量 ANTHROPIC_BASE_URL=https://openrouter.ai/api/v1,但 Claude Code 默认走 Anthropic 原生协议,这个配置偶尔会有兼容问题。

国内用这几个工具搭 OpenRouter,建议全程走代理,不然超时是常态。