Как использовать Claude API из Китая? Opus 4.6 / Sonnet 4.6 — сравнение трёх способов подключения (2026)

Кратко

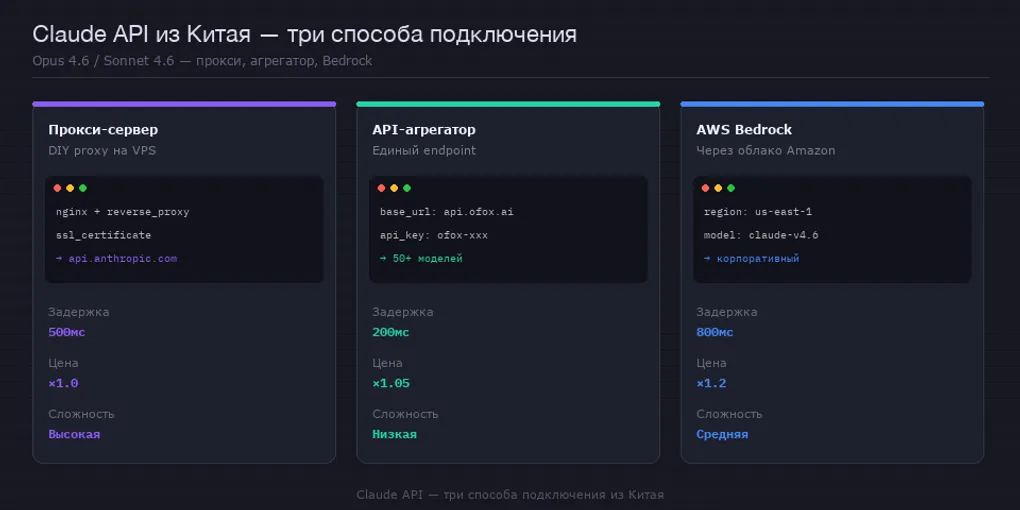

Claude API от Anthropic недоступен напрямую из Китая. В этой статье сравниваются три рабочих способа — самостоятельный прокси, платформа-агрегатор API, AWS Bedrock — с полными примерами кода и актуальной таблицей цен моделей. Подключение Claude API за 5 минут.

Актуальные модели Claude (обновление на март 2026)

| Модель | Цена ввода ($/MTok) | Цена вывода ($/MTok) | Контекст | Макс. вывод | Позиционирование |

|---|---|---|---|---|---|

| Claude Opus 4.6 | $5 | $25 | 1M | 128K | Флагман, сильнейшие рассуждения, поддержка Extended Thinking |

| Claude Sonnet 4.6 | $3 | $15 | 1M | 64K | Лучший выбор по цена/качество, лидер в коде |

| Claude Haiku 4.5 | $1 | $5 | 200K | 8K | Лёгкая и быстрая, для классификации и извлечения |

Claude Sonnet 4.6 (выпущен 17 февраля 2026) набрал 79.6% на SWE-bench Verified, в тестах пользовательских предпочтений — 70% побед над Sonnet 4.5 и 59% над Opus 4.5. Opus 4.6 и Sonnet 4.6 получили контекст 1M токенов — можно за раз обработать весь репозиторий кода. Для большинства задач по программированию и обработке текста оптимален Sonnet 4.6.

Для сравнения: GPT-5.4 (март 2026) тоже поддерживает контекст 1M, а Gemini 3.1 Flash-Lite предлагает сверхнизкую цену $0.25/$1.50 с высокой скоростью. Через агрегатор Ofox одним ключом можно переключаться между всеми этими моделями.

Способ 1: Самостоятельный прокси-сервер

Развёртывание прокси на зарубежном VPS для пересылки запросов к официальному API Anthropic.

Подходит для: команд с зарубежным сервером, которым нужен полный контроль над каналом данных.

# proxy_server.py — развёртывание на зарубежном VPS

from flask import Flask, request, Response

import requests

app = Flask(__name__)

ANTHROPIC_BASE = "https://api.anthropic.com"

@app.route("/v1/<path:path>", methods=["POST"])

def proxy(path):

resp = requests.post(

f"{ANTHROPIC_BASE}/v1/{path}",

headers={

"x-api-key": request.headers.get("x-api-key"),

"anthropic-version": "2023-06-01",

"content-type": "application/json",

},

json=request.json,

stream=True,

timeout=120,

)

return Response(

resp.iter_content(chunk_size=1024),

status=resp.status_code,

content_type=resp.headers.get("content-type"),

)Локальный вызов:

import anthropic

client = anthropic.Anthropic(

api_key="sk-ant-xxx",

base_url="http://your-server:8080/v1"

)

message = client.messages.create(

model="claude-sonnet-4-6-20250217",

max_tokens=1024,

messages=[{"role": "user", "content": "Напиши быструю сортировку на Python"}]

)

print(message.content[0].text)Важно:

- Потоковые ответы требуют корректной обработки формата SSE

- Обязателен заголовок

anthropic-version - Пропускная способность сервера влияет на скорость длинных ответов

- Нужно самостоятельно обеспечивать доступность сервиса

Способ 2: Платформа-агрегатор API (рекомендуется)

Использование платформы-агрегатора, совместимой с протоколом OpenAI — прямой доступ из Китая, без зарубежного сервера.

Подходит для: большинства разработчиков, быстрое и стабильное подключение.

from openai import OpenAI

client = OpenAI(

api_key="your-ofox-key",

base_url="https://api.ofox.ai/v1"

)

response = client.chat.completions.create(

model="anthropic/claude-sonnet-4-6",

messages=[

{"role": "system", "content": "Ты опытный Python-разработчик"},

{"role": "user", "content": "Проведи ревью безопасности этого кода"}

],

max_tokens=2048,

stream=True,

)

for chunk in response:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="")Преимущества агрегатора:

- Узлы Alibaba Cloud / Volcano Cloud в Китае, задержка первого байта 100-300 мс

- Совместим с OpenAI SDK — достаточно изменить base_url

- Один ключ для Claude, GPT-5.4, Gemini 3.1, DeepSeek и ещё 100+ моделей

- Поддержка командного режима — расход каждого участника под контролем

Соответствие ID моделей (одна платформа для Claude, GPT, Gemini):

| Модель | ID на платформе | Нативный ID |

|---|---|---|

| Claude Sonnet 4.6 | anthropic/claude-sonnet-4-6 | claude-sonnet-4-6-20250217 |

| Claude Opus 4.6 | anthropic/claude-opus-4-6 | claude-opus-4-6-20250205 |

| Claude Haiku 4.5 | anthropic/claude-haiku-4-5 | claude-haiku-4-5-20251001 |

| GPT-5.4 | openai/gpt-5.4 | gpt-5.4 |

| Gemini 3.1 Flash-Lite | google/gemini-3.1-flash-lite | gemini-3.1-flash-lite |

Способ 3: AWS Bedrock

Вызов Claude через официальный управляемый сервис AWS — подходит для компаний с имеющейся AWS-инфраструктурой.

import boto3, json

bedrock = boto3.client(

service_name="bedrock-runtime",

region_name="us-east-1",

)

response = bedrock.invoke_model(

modelId="anthropic.claude-sonnet-4-6-20250217-v1:0",

contentType="application/json",

body=json.dumps({

"anthropic_version": "bedrock-2023-05-31",

"max_tokens": 1024,

"messages": [

{"role": "user", "content": "Объясни принцип работы GIL в Python"}

]

})

)

result = json.loads(response["body"].read())

print(result["content"][0]["text"])Важно: формат ID модели и версия API в Bedrock отличаются от официальных — требуется отдельная адаптация.

Сравнение трёх способов

| Параметр | Самостоятельный прокси | Платформа-агрегатор | AWS Bedrock |

|---|---|---|---|

| Сложность подключения | Средняя (нужен сервер) | Низкая (изменить base_url) | Средняя (нужен аккаунт AWS) |

| Задержка | 300-800 мс | 100-300 мс | 200-500 мс |

| Стабильность | Зависит от сервера | Высокая (несколько узлов) | Высокая (SLA AWS) |

| Месячная стоимость (вкл. инфраструктуру) | API + $5-20 | Только API | API + AWS |

| Соответствие требованиям | Под вашим контролем | Гарантии платформы | Система соответствия AWS |

| Переключение моделей | Только Claude | Claude + GPT-5.4 + Gemini 3.1 и ещё 100+ моделей | Модели, доступные в AWS |

Практический пример: бот для код-ревью

from openai import OpenAI

import gitlab

client = OpenAI(api_key="your-key", base_url="https://api.ofox.ai/v1")

def review_merge_request(project_id, mr_iid):

gl = gitlab.Gitlab("https://gitlab.example.com", private_token="xxx")

mr = gl.projects.get(project_id).mergerequests.get(mr_iid)

changes = mr.changes()

diff_text = "\n".join(

f"--- {c['old_path']}\n+++ {c['new_path']}\n{c['diff']}"

for c in changes["changes"][:10]

)

response = client.chat.completions.create(

model="anthropic/claude-sonnet-4-6",

messages=[

{"role": "system", "content": "Проверь следующий diff кода, укажи уязвимости безопасности, проблемы производительности и нарушения стандартов."},

{"role": "user", "content": f"MR: {mr.title}\n\n{diff_text}"}

],

max_tokens=4096,

)

mr.notes.create({"body": f"**AI Review**\n\n{response.choices[0].message.content}"})Советы по оптимизации затрат

- Batch API: для задач, не требующих мгновенного ответа — скидка 50%

- Prompt Caching: кэширование повторяющегося system prompt снижает стоимость ввода на 90%

- Разделение по моделям: простые задачи — Haiku 4.5 ($1/$5), сложные — Sonnet 4.6, сверхбюджетные — Gemini 3.1 Flash-Lite ($0.25/$1.50)

- Контроль max_tokens: устанавливайте лимит вывода по необходимости

Больше советов по снижению затрат: Как снизить расходы на AI API? 7 проверенных стратегий

Типичные ошибки и диагностика

| Код ошибки | Значение | Решение |

|---|---|---|

| 401 | Invalid API Key | Проверить правильность, срок действия и наличие прав на модель |

| 429 | Rate Limit Exceeded | Ограничение частоты — добавить экспоненциальный откат или повысить квоту |

| 500 | Internal Server Error | Нестабильность Anthropic — добавить логику повтора |

| 529 | Overloaded | Перегрузка сервиса — повторить позже |

| timeout | Таймаут запроса | Проверить сеть, уменьшить max_tokens или переключиться на узел с низкой задержкой |

При использовании агрегатора повторы и отказоустойчивое переключение обрабатываются автоматически. Подробнее: Полное руководство по устранению ошибок AI API

Полезные ссылки

- Cursor, Claude Code, Cline — руководство по настройке API — подключение Claude API в популярных AI-инструментах для программирования

- OpenClaw — руководство по использованию — настройка модели Claude в AI Agent фреймворке

- Function Calling — полное руководство — создание системы вызова инструментов с Claude API

- GPT-5.2 API — руководство по использованию из Китая — сравнение способов подключения GPT

- Gemini API — руководство по использованию из Китая — способы подключения Google Gemini