Сравнение провайдеров API для OpenClaw: лучшие платформы 2026 года

Кратко

Сравнение 5 типов подключения OpenClaw к API — прямое подключение к официальным API, агрегаторы, API китайских моделей, облачные платформы, локальный деплой — по 8 критериям: задержка, цена, покрытие моделей, стабильность.

Почему выбор API так важен

Выбор провайдера API определяет качество работы Agent и стоимость. Типичные проблемы:

- Прямое подключение к зарубежным API из Китая нестабильно: Agent обрывается на полпути, потраченные токены уходят впустую

- Привязка к одной модели: при ограничении скорости со стороны провайдера Agent простаивает по полчаса

- Без разделения моделей по задачам: все запросы идут на флагманскую модель, счёт в конце месяца в 5 раз больше ожидаемого

Критерии оценки

Оценка проводилась по 8 критериям, каждый — по 10-балльной шкале:

| Критерий | Вес | Описание |

|---|---|---|

| Покрытие моделей | 15% | Количество поддерживаемых моделей, возможность переключения |

| Задержка из Китая | 15% | Время от отправки запроса до получения первого токена |

| Цена | 15% | Фактические расходы при использовании одинаковых моделей |

| Стабильность | 15% | Доступность при длительной работе, скорость восстановления |

| Совместимость протокола | 10% | Полнота реализации OpenAI-совместимого протокола |

| Удобство оплаты | 10% | Поддержка юаней, Alipay/WeChat Pay |

| Сложность настройки | 10% | Количество шагов от нуля до рабочей конфигурации |

| Дополнительные функции | 10% | Аналитика использования, бюджетный контроль, командная работа |

Все данные по задержке получены на ECS Alibaba Cloud в Шанхае, медиана (P50) по 100 запросам. Цены — по публичным тарифам на март 2026 года.

Подробный обзор пяти решений

Решение 1: Прямое подключение к официальным API

Прямое использование официальных API от OpenAI, Anthropic, Google.

Результаты тестов:

| Показатель | Результат |

|---|---|

| Покрытие моделей | Только один провайдер: у OpenAI — только GPT |

| Задержка из Китая | OpenAI: 1200–3000 мс; Anthropic: 1500–4000 мс; Google: 800–1500 мс |

| Цена | Официальная, без наценки |

| Стабильность | Из Китая нестабильно, потери пакетов 5–15% |

| Совместимость | Нативная (OpenAI) / требуется адаптация (Anthropic) |

| Оплата | Только доллары, кредитная карта |

Преимущества:

- Самая низкая цена (официальные тарифы)

- Новые модели доступны первыми

- Нет посредников, кратчайший путь данных

Проблемы:

- Нестабильная сеть из Китая — Agent регулярно обрывается при длительной работе

- Нужно регистрироваться на нескольких платформах, управлять несколькими ключами

- Оплата только в долларах — высокий барьер для разработчиков из Китая

- API Anthropic не совместим с форматом OpenAI, требуется дополнительная настройка в OpenClaw

Оценка: Покрытие 5 | Задержка 3 | Цена 9 | Стабильность 4 | Протокол 7 | Оплата 2 | Настройка 5 | Допфункции 3 | Итого: 4,8

Решение 2: Агрегатор API

Через платформы-агрегаторы вроде Ofox или OpenRouter — один интерфейс для моделей разных провайдеров. Сравниваем Ofox и OpenRouter.

Результаты тестов:

| Показатель | Ofox | OpenRouter |

|---|---|---|

| Количество моделей | 100+ | 200+ |

| Задержка из Китая | 300–800 мс (есть узлы в Китае) | 1000–2500 мс (нет узлов в Китае) |

| Цена | Официальная + 10–15% | Официальная + 10–20% |

| Доступность (7 дней) | 99,8% | 99,5% |

| Совместимость | OpenAI-совместимый, полная реализация | OpenAI-совместимый, полная реализация |

| Оплата | Юани/доллары, Alipay/WeChat | Только доллары, карта/криптовалюта |

| Командные функции | Субаккаунты, распределение квот | Базовая аналитика |

Преимущества Ofox:

- Узлы ускорения на Alibaba Cloud / Volcano Engine в Китае — задержка значительно ниже зарубежных платформ

- Оплата в юанях, пополнение через Alipay

- Развитые командные функции — субаккаунты, распределение квот, отчёты

- Полная документация и руководство по интеграции, в том числе для OpenClaw

Преимущества OpenRouter:

- Наибольшее количество моделей в отрасли

- Активное сообщество, новые модели подключаются быстро

- Поддержка маршрутизации моделей (автовыбор самой дешёвой из доступных)

Проблемы:

- На 10–20% дороже официальных API (но экономия на зарубежных платежах и управлении множеством платформ)

- Зависимость от сторонней платформы — рекомендуется настроить резервный вариант

Оценка (Ofox): Покрытие 9 | Задержка 8 | Цена 7 | Стабильность 8 | Протокол 9 | Оплата 10 | Настройка 9 | Допфункции 9 | Итого: 8,5

Оценка (OpenRouter): Покрытие 10 | Задержка 4 | Цена 7 | Стабильность 7 | Протокол 9 | Оплата 3 | Настройка 8 | Допфункции 6 | Итого: 6,8

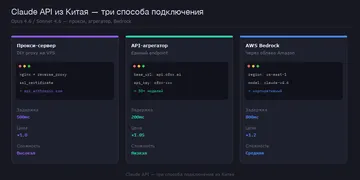

Решение 3: API китайских моделей

Прямое подключение к API китайских моделей: DeepSeek, Alibaba Qwen, Zhipu GLM.

Результаты тестов:

| Показатель | DeepSeek | Qwen (Bailian) | GLM (Zhipu) |

|---|---|---|---|

| Основная модель | V3.2 / R2 | Qwen3.5 Max/Plus | GLM-5 |

| Задержка из Китая | 100–300 мс | 100–300 мс | 150–400 мс |

| Цена (ввод / млн токенов) | ¥2 | ¥10 | ¥8 |

| Протокол | OpenAI-совместимый | OpenAI-совместимый | OpenAI-совместимый |

| Оплата | Юани | Юани | Юани |

| Бесплатный баланс | При регистрации | При регистрации | При регистрации |

Преимущества:

- Минимальная задержка — прямой доступ из Китая без сетевых проблем

- Самая низкая цена: DeepSeek V3.2 стоит в 6 раз дешевле GPT-4o

- Все поддерживают OpenAI-совместимый протокол — простая настройка в OpenClaw

- Сильные возможности на китайском языке

- Бесплатный баланс при регистрации — старт без вложений

Проблемы:

- Доступны только модели одного провайдера; смена провайдера требует изменения конфигурации

- Сложные рассуждения и задачи на английском уступают GPT/Claude

- DeepSeek в пиковые часы иногда ограничивает скорость

Оценка (DeepSeek): Покрытие 3 | Задержка 10 | Цена 10 | Стабильность 7 | Протокол 8 | Оплата 10 | Настройка 9 | Допфункции 4 | Итого: 7,6

Решение 4: Облачные платформы

Управляемый деплой через облачные сервисы: Alibaba Cloud Bailian, Volcano Engine, Tencent Cloud.

Результаты тестов:

| Показатель | Alibaba Cloud Bailian | Volcano Engine |

|---|---|---|

| Встроенные модели | Все модели Qwen + DeepSeek + зарубежные | Все модели Doubao + DeepSeek |

| Задержка | 100–500 мс | 100–500 мс |

| Дополнительные затраты | Облачный сервер + вызовы модели | Облачный сервер + вызовы модели |

| Деплой | Образ в один клик / Docker | Деплой в один клик |

| SLA | 99,9% | 99,9% |

Преимущества:

- Простейший деплой — один клик, не нужно настраивать окружение

- Корпоративный SLA

- Прямой доступ к встроенным моделям с минимальной задержкой

- Техподдержка и система тикетов

Проблемы:

- Привязка к экосистеме конкретного облачного провайдера

- Общая стоимость = аренда сервера + вызовы модели (дороже чистого API)

- Выбор моделей ограничен тем, что интегрировала платформа

- Неполная поддержка зарубежных моделей

Оценка (Alibaba Cloud Bailian): Покрытие 6 | Задержка 9 | Цена 5 | Стабильность 9 | Протокол 8 | Оплата 10 | Настройка 10 | Допфункции 8 | Итого: 7,9

Решение 5: Локальный деплой (Ollama + open-source модели)

Запуск open-source моделей (Llama 3.3, Mistral, Qwen и др.) локально через Ollama, подключение OpenClaw к локальному API.

Результаты тестов:

| Показатель | Результат |

|---|---|

| Доступные модели | Open-source (Llama 3.3 70B, Qwen2.5 72B, Mistral Large и др.) |

| Задержка | Зависит от оборудования; на M4 Max модель 7B — около 50–100 мс |

| Цена | Ноль затрат на API (только электричество и амортизация оборудования) |

| Стабильность | Зависит от локальной среды, не зависит от сети |

| Сложность настройки | Установка Ollama + загрузка модели + настройка OpenClaw |

Преимущества:

- Нулевая стоимость API — сколько угодно запросов бесплатно

- Полностью офлайн, не зависит от интернета

- Данные не покидают локальную машину — максимальная приватность

- Минимальная задержка (локальная сеть)

Проблемы:

- Малые open-source модели (7B–14B) заметно уступают GPT/Claude в вызове инструментов и многошаговых рассуждениях

- Для больших моделей (70B+) нужен мощный GPU или Apple Silicon — высокий порог входа

- Нет доступа к закрытым флагманским моделям (GPT-5, Claude Opus)

- Необходимо самостоятельно обновлять модели

Оценка: Покрытие 4 | Задержка 9 | Цена 10 | Стабильность 7 | Протокол 7 | Оплата 10 | Настройка 5 | Допфункции 2 | Итого: 6,8

Сводная таблица сравнения

| Критерий | Прямое подключение | Ofox агрегатор | OpenRouter | DeepSeek | Alibaba Cloud Bailian | Локальный Ollama |

|---|---|---|---|---|---|---|

| Покрытие моделей | Один провайдер | 100+ | 200+ | Только DS | В рамках платформы | Open-source |

| Задержка из Китая | 1200–4000 мс | 300–800 мс | 1000–2500 мс | 100–300 мс | 100–500 мс | 50–100 мс |

| Месячная стоимость (средняя) | ¥150–300 | ¥170–350 | ¥170–350 | ¥30–80 | ¥200–500 | ¥0 (электричество) |

| Стабильность | Плохая из Китая | Высокая | Средне-высокая | Средне-высокая | Высокая (SLA) | Зависит от среды |

| Совместимость OpenAI | Частичная | Полная | Полная | Полная | Полная | Полная |

| Оплата в юанях | Нет | Да | Нет | Да | Да | Не требуется |

| Командные функции | Нет | Развитые | Базовые | Базовые | Развитые | Нет |

| Шаги настройки | Регистрация на нескольких платформах | Регистрация → ввод Key | Регистрация → ввод Key | Регистрация → ввод Key | Деплой в один клик | Установка + загрузка |

| Итоговый балл | 4,8 | 8,5 | 6,8 | 7,6 | 7,9 | 6,8 |

Какое решение выбрать для вашего сценария

Нет «лучшего» решения — есть «наиболее подходящее». Рекомендации по типичным сценариям:

Индивидуальный разработчик / первое знакомство

Рекомендация: DeepSeek API

Причина: бесплатный баланс при регистрации, прямой доступ из Китая, отличное качество на китайском языке. Запустите OpenClaw целиком на DeepSeek, а потом решите, нужно ли расширяться.

# Пример конфигурации OpenClaw

api:

provider: deepseek

base_url: https://api.deepseek.com/v1

api_key: sk-xxx

model: deepseek-chatПовседневный офисный помощник / мультимодельные задачи

Рекомендация: Агрегатор Ofox

Причина: один ключ для всех моделей. Повседневные задачи — Sonnet/GPT-4o, сложные — Opus/GPT-5.4 Thinking. Настраивается один раз.

# Пример конфигурации OpenClaw

api:

provider: openai-compatible

base_url: https://api.ofox.ai/v1

api_key: sk-xxx

model: anthropic/claude-sonnet-4.6

fallback_models:

- openai/gpt-4o

- deepseek/deepseek-chatКорпоративная команда

Рекомендация: Alibaba Cloud Bailian + Ofox (двойное резервирование)

Причина: основные бизнес-задачи через Alibaba Cloud Bailian (SLA), зарубежные модели — через Ofox. Два канала взаимно резервируют друг друга.

Конфиденциальность / офлайн-сценарии

Рекомендация: Локальный Ollama + облачный резерв

Причина: простые повседневные задачи на локальной модели (нулевая стоимость, данные не уходят вовне), сложные — через облачный API.

Быстрая таблица выбора

| Сценарий | Первый выбор | Альтернатива | Ориентировочный бюджет/мес. |

|---|---|---|---|

| Первое знакомство | DeepSeek | Бесплатный баланс Ofox | ¥0–30 |

| Индивидуальное ежедневное использование | Ofox | DeepSeek + прямое подключение | ¥50–150 |

| Малая команда (3–5 человек) | Ofox Team | Alibaba Cloud Bailian | ¥200–500 |

| Корпорация (10+ человек) | Alibaba Cloud Bailian + Ofox | Собственный прокси | ¥500–2000 |

| Тяжёлый Agent (24/7) | Ofox + DeepSeek гибрид | Alibaba Cloud Bailian | ¥300–800 |

| Офлайн / приватность | Локальный Ollama | — | ¥0 |

Сравнение реальных затрат

Реальный тест: OpenClaw в типичном офисном сценарии — около 200 диалогов в день (простые вопросы, суммаризация документов, помощь с кодом). Затраты за неделю:

Условия тестирования

- Распределение задач: простые вопросы 60%, работа с документами 25%, помощь с кодом 15%

- Ежедневное потребление токенов: ~500 000 входных + 200 000 выходных

- Период: 7 дней

Фактические расходы за неделю

| Решение | Используемая модель | Неделя | Месяц (расчёт) |

|---|---|---|---|

| Прямое подключение (GPT-4o) | GPT-4o | ¥78 | ¥335 |

| Прямое подключение (Claude Sonnet) | Claude Sonnet 4.6 | ¥63 | ¥270 |

| Ofox (гибридная стратегия) | Sonnet + DeepSeek | ¥35 | ¥150 |

| DeepSeek (только китайские модели) | DeepSeek V3.2 | ¥8 | ¥34 |

| Alibaba Cloud Bailian | Qwen3.5 Plus + сервер | ¥65 (из них ¥40 сервер) | ¥280 |

| Локальный Ollama | Qwen2.5 14B | ¥0 | ¥0 |

Ключевое наблюдение: гибридная стратегия через Ofox (простые задачи — DeepSeek, сложные — Claude Sonnet) на 55% дешевле постоянного использования GPT-4o при практически идентичном качестве.

Формула оптимизации расходов

Оптимальная структура затрат для большинства разработчиков:

Общие затраты = 70% простых задач × цена DeepSeek + 25% обычных задач × цена Sonnet + 5% сложных задач × цена OpusНа примере 1 млн входных токенов в месяц:

- Всё на Opus: ¥75

- Всё на Sonnet: ¥15

- Гибридная стратегия: 70% × ¥2 + 25% × ¥15 + 5% × ¥75 = ¥1,4 + ¥3,75 + ¥3,75 = ¥8,9

Стоимость гибридной стратегии — всего 12% от постоянного использования флагманской модели.

Практическое руководство: подключение с нуля

На примере Ofox — 3 шага для настройки API в OpenClaw:

Шаг 1: Получение API Key

Зарегистрируйтесь в консоли Ofox и создайте API Key на странице API Keys.

Шаг 2: Настройка OpenClaw

Запустите openclaw onboard и на этапе настройки API:

- Provider: выберите

OpenAI Compatible - Base URL: введите

https://api.ofox.ai/v1 - API Key: введите ключ из предыдущего шага

- Model: введите

anthropic/claude-sonnet-4.6(или другую поддерживаемую модель)

Шаг 3: Проверка подключения

openclaw chat "Привет, проверка подключения"Если получили ответ — настройка завершена. Для смены модели достаточно изменить параметр model — менять ключ или адрес не нужно.

Если вы уже ознакомились с руководством OpenClaw: рекомендации по API и настройке моделей, эти шаги вам знакомы — данная статья помогает сделать выбор между несколькими вариантами.

Часто задаваемые вопросы (FAQ)

Какой API лучше для OpenClaw?

Зависит от приоритетов:

- Максимум моделей и гибкость → агрегатор API

- Минимальная цена → DeepSeek API (¥2/млн входных токенов)

- Максимальная стабильность (корпоративная) → Alibaba Cloud Bailian (SLA 99,9%)

- Данные не должны покидать машину → локальный Ollama

Чем API для Agent отличается от обычного чат-API?

Agent предъявляет более высокие требования: частота вызовов выше (автоматические циклы), необходимы function calling и streaming, обязателен fallback при сбоях, чувствительность к цене выше (объём вызовов в 10–50 раз больше). Стабильность и поддержка function calling важнее цены.

Высокая задержка API — Agent реагирует медленно?

Порядок действий: 1) переключитесь на платформу с узлами в Китае (задержка падает с 2–4 с до 300–800 мс); 2) для простых задач используйте лёгкие модели (Gemini Flash, GPT-4o-mini — в 3–5 раз быстрее); 3) включите streaming в OpenClaw; 4) сократите system prompt.

Можно ли использовать несколько провайдеров одновременно?

Да. Механизм model fallback в OpenClaw позволяет настроить несколько провайдеров:

api:

providers:

- name: aggregator

base_url: https://api.ofox.ai/v1

api_key: sk-xxx

models: [anthropic/claude-sonnet-4.6, openai/gpt-4o, anthropic/claude-opus-4.6]

- name: deepseek

base_url: https://api.deepseek.com/v1

api_key: sk-ds-xxx

models: [deepseek-chat]

fallback_order: [aggregator, deepseek]DeepSeek или GPT/Claude — что выбрать?

Гибридное использование даёт лучший результат: DeepSeek V3.2 — для диалогов на китайском и обработки информации (дёшево); GPT-4o / Claude Sonnet — для контента на английском; Claude Opus 4.6 — для сложной генерации кода; Gemini 3 Pro — для анализа длинных документов (контекст 2 млн токенов).

Итоги

- Для большинства разработчиков оптимальна комбинация «агрегатор + китайские модели»: гибридная стратегия снижает расходы на 60–80%

- Настройте минимум два провайдера с механизмом fallback в OpenClaw

- Пересматривайте выбор каждые 3–6 месяцев — рынок AI-моделей быстро меняется

Полезные ссылки

- OpenClaw — документация по настройке API — официальное руководство

- OpenClaw — GitHub-репозиторий — исходный код и обсуждения

- Ofox AI API — документация — подключение, список моделей, цены

- Ofox — руководство по интеграции с OpenClaw — специальная инструкция для OpenClaw

- DeepSeek API — документация — официальный справочник

- Alibaba Cloud Bailian — деплой OpenClaw — инструкция по развёртыванию

- OpenClaw: рекомендации по API и настройке моделей — дополнительное руководство

- Как снизить расходы на AI API — стратегии оптимизации затрат