Как настроить API в Dify? Полное руководство по подключению моделей и пользовательских API (2026)

Кратко

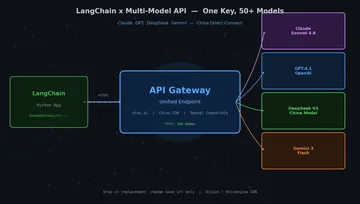

Настройка AI API в Dify возможна тремя способами: официальные поставщики (ввести Key и готово), OpenAI-совместимый пользовательский API (подключение сторонних сервисов), локальные модели (Ollama/vLLM). Для разработчиков из Китая рекомендуется платформа-агрегатор в качестве промежуточного слоя — один Key и 50+ моделей включая GPT, Claude, Gemini в Dify с низкой задержкой и высокой стабильностью.

Содержание

- Почему настройка API в Dify так важна

- Способ 1: Официальные поставщики (самый простой)

- Способ 2: OpenAI-совместимый пользовательский API (самый гибкий)

- Способ 3: Подключение локальных моделей

- Практика: подключение 50+ моделей через агрегатор

- Мультимодельная балансировка нагрузки и отказоустойчивость

- Стратегия разделения моделей в рабочих процессах

- Типичные ошибки и решения

- Часто задаваемые вопросы (FAQ)

- Итоги и план действий

- Справочные материалы

Почему настройка API в Dify так важна

Dify — самая популярная на данный момент open-source платформа для разработки AI-приложений с более чем 90 тысячами звёзд на GitHub. Она позволяет создавать AI-рабочие процессы, чат-ботов и Agent-агентов через визуальный интерфейс без написания кода.

Однако Dify сам по себе не предоставляет больших моделей — это платформа оркестрации, которой необходимо подключить внешние AI-модели через API:

- Настройка API — первый шаг: без правильной настройки модели в Dify ничего не заработает

- Выбор API определяет качество: задержка, стабильность и цена зависят от подключённого API-сервиса

- Переключение между моделями — ключевое преимущество: одна из сильнейших возможностей Dify — гибкое переключение моделей в рабочих процессах

Далее — три способа настройки, от простого к продвинутому.

Способ 1: Официальные поставщики (самый простой)

Dify имеет встроенную интеграцию с десятками поставщиков моделей — достаточно ввести API Key.

Шаги настройки

- Войдите в панель управления Dify, нажмите на аватар в правом верхнем углу - Настройки

- В левом меню выберите Поставщики моделей

- Найдите нужного поставщика (например, OpenAI), нажмите Настроить

- Введите API Key, нажмите «Сохранить»

Поддерживаемые основные поставщики

| Поставщик | Основные модели | Подходящие сценарии |

|---|---|---|

| OpenAI | GPT-4o, GPT-4o-mini, o3 | Универсальные диалоги, генерация кода |

| Anthropic | Claude Sonnet 4.6, Opus 4.6 | Анализ длинных текстов, сложные рассуждения |

| Gemini 3 Pro, Flash | Мультимодальные задачи, цена/качество | |

| DeepSeek | DeepSeek-V3, R1 | Китайский язык, генерация кода |

| Tongyi Qianwen | Qwen3.5, Qwen-Max | Развёртывание в Китае, понимание китайского |

| Azure OpenAI | GPT-4o (хостинг Azure) | Корпоративное соответствие, безопасность данных |

Важно

- API Key каждого поставщика нужно получить на его официальном сайте

- Некоторые зарубежные поставщики (OpenAI, Anthropic, Google) могут быть недоступны из Китая напрямую

- При сетевых проблемах — см. «Способ 2» ниже

Способ 2: OpenAI-совместимый пользовательский API (самый гибкий)

Одна из самых мощных функций Dify — через канал OpenAI-API-compatible можно подключить любой API-сервис, совместимый с протоколом OpenAI.

Зачем нужен пользовательский API?

- Нет прямого доступа из Китая к OpenAI / Anthropic / Google

- Хотите использовать агрегатор API для единого управления моделями

- Нужно подключить самостоятельно развёрнутый сервис (vLLM, text-generation-inference)

- В компании есть свой API-шлюз

Шаги настройки

- На странице поставщиков найдите OpenAI-API-compatible

- Нажмите Добавить модель

- Заполните данные:

Название модели: gpt-4o (или нужный ID модели)

API Key: ваш API Key

API Base URL: https://your-api-provider.com/v1- Выберите тип модели (LLM / Text Embedding / Speech2Text / TTS)

- Задайте параметры модели (длина контекста, макс. выходные токены и т.д.)

- Нажмите «Сохранить»

Описание ключевых параметров

| Параметр | Описание | Пример |

|---|---|---|

| Model Name | ID модели, должен совпадать с ID у поставщика | gpt-4o, claude-sonnet-4-6 |

| API Key | Ключ, полученный у поставщика API | sk-xxxxx |

| API Base URL | Адрес API, должен оканчиваться на /v1 | https://api.example.com/v1 |

| Context Size | Максимальное контекстное окно модели | 128000 |

| Max Tokens | Максимальный вывод за один запрос | 16384 |

| Vision Support | Поддержка ввода изображений | Включить |

| Function Calling | Поддержка вызова функций | Включить |

| Streaming | Поддержка потокового вывода | Включить |

Типичная ошибка: лишний

/в конце API Base URL может привести к сбою запросов. Правильный формат:https://api.example.com/v1, а неhttps://api.example.com/v1/.

Проверка конфигурации

После сохранения нажмите кнопку Тест рядом с названием модели и отправьте тестовое сообщение. Если получен нормальный ответ — настройка успешна.

Способ 3: Подключение локальных моделей

Если требования к конфиденциальности данных строгие или нужно бесплатно использовать open-source модели — Dify поддерживает локальные модели.

Ollama (рекомендуется)

Ollama — самый простой инструмент для локального запуска моделей:

# 1. Установка Ollama

curl -fsSL https://ollama.com/install.sh | sh

# 2. Загрузка модели

ollama pull llama3.1:8b

ollama pull qwen3.5:14b

# 3. Запуск сервиса (порт по умолчанию 11434)

ollama serveНастройка в Dify:

- Поставщики моделей - найдите Ollama

- Base URL:

http://localhost:11434(для Dify в Docker:http://host.docker.internal:11434) - Выберите загруженную модель

vLLM

Подходит для продакшена с высокой пропускной способностью:

# Запуск сервиса vLLM (режим совместимости с OpenAI)

python -m vllm.entrypoints.openai.api_server \

--model meta-llama/Llama-3.1-8B-Instruct \

--port 8000Подключение в Dify через OpenAI-API-compatible, API Base URL: http://localhost:8000/v1.

Локальное развёртывание vs облачный API

| Параметр | Локальное развёртывание | Облачный API |

|---|---|---|

| Стоимость | Разовые вложения в оборудование | Оплата по токенам |

| Задержка | Зависит от мощности GPU | Обычно <1с (первый токен) |

| Конфиденциальность | Данные не покидают устройство | Нужно доверять поставщику |

| Возможности моделей | Ограничены локальным оборудованием | Доступны флагманские модели |

| Обслуживание | Самостоятельное | Нулевое |

| Подходит для | Чувствительные данные, закрытые сети | Быстрый запуск, максимальное качество |

Практика: подключение 50+ моделей через агрегатор

Для большинства разработчиков самый реалистичный подход: один агрегатор — все модели.

Почему не использовать API каждого поставщика напрямую?

- Сетевые проблемы в Китае: API OpenAI, Anthropic, Google имеют высокую задержку или недоступны

- Сложность управления: отдельная регистрация, оплата и ключи у каждого поставщика

- Непрозрачность затрат: счета раскиданы по разным платформам

- Высокая стоимость переключения: хотите попробовать новую модель — заново проходите регистрацию

Как работает агрегатор

Ваше приложение Dify

↓ Протокол, совместимый с OpenAI

Платформа-агрегатор (единая точка входа)

↓ Умная маршрутизация

┌───────┬───────┬───────┬────────┐

│OpenAI │Claude │Gemini │DeepSeek│ ...50+ моделей

└───────┴───────┴───────┴────────┘Агрегатор предоставляет единый OpenAI-совместимый интерфейс — один API Key для всех моделей. Пример настройки через Ofox:

Примеры настройки в Dify

На странице поставщиков добавьте модель OpenAI-API-compatible:

Подключение GPT-4o:

Название модели: gpt-4o

API Key: ваш ключ агрегатора

API Base URL: https://api.ofox.ai/v1

Длина контекста: 128000

Макс. вывод: 16384

Vision Support: включено

Function Calling: включено

Streaming: включеноПодключение Claude Sonnet 4.6:

Название модели: anthropic/claude-sonnet-4-6

API Key: тот же ключ

API Base URL: https://api.ofox.ai/v1

Длина контекста: 200000

Макс. вывод: 64000

Vision Support: включено

Function Calling: включено

Streaming: включеноПодключение Gemini 3 Flash:

Название модели: google/gemini-3-flash

API Key: тот же ключ

API Base URL: https://api.ofox.ai/v1

Длина контекста: 1000000

Макс. вывод: 65536

Vision Support: включено

Function Calling: включено

Streaming: включеноКлючевое преимущество: три модели используют один API Key и один Base URL, свободное переключение в Dify.

Проверка подключения через Python

Перед настройкой Dify рекомендуется проверить API скриптом:

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.ofox.ai/v1"

)

# Тест GPT-4o

response = client.chat.completions.create(

model="gpt-4o",

messages=[{"role": "user", "content": "Привет, представься одним предложением"}],

max_tokens=100

)

print(response.choices[0].message.content)Если ответ получен — можно смело настраивать в Dify.

Мультимодельная балансировка нагрузки и отказоустойчивость

Dify поддерживает настройку нескольких наборов учётных данных для одной модели — автоматическая балансировка.

Способ настройки

- Добавьте первый набор (API Key A + Base URL A)

- Добавьте ещё один набор с тем же названием и типом модели (API Key B + Base URL B)

- Dify автоматически объединит оба набора и будет чередовать запросы

Стратегия балансировки

Запрос пользователя → Dify

↓

┌─── Набор A (50% трафика)

│ API Key: sk-aaa

│ Base URL: https://provider-a.com/v1

│

└─── Набор B (50% трафика)

API Key: sk-bbb

Base URL: https://provider-b.com/v1Сценарии использования

- Преодоление лимита частоты: RPM одного ключа недостаточно — ротация нескольких ключей

- Отказоустойчивость: при проблемах у одного поставщика — автопереключение на другого

- Оптимизация затрат: распределение нагрузки между поставщиками, использование бесплатных квот

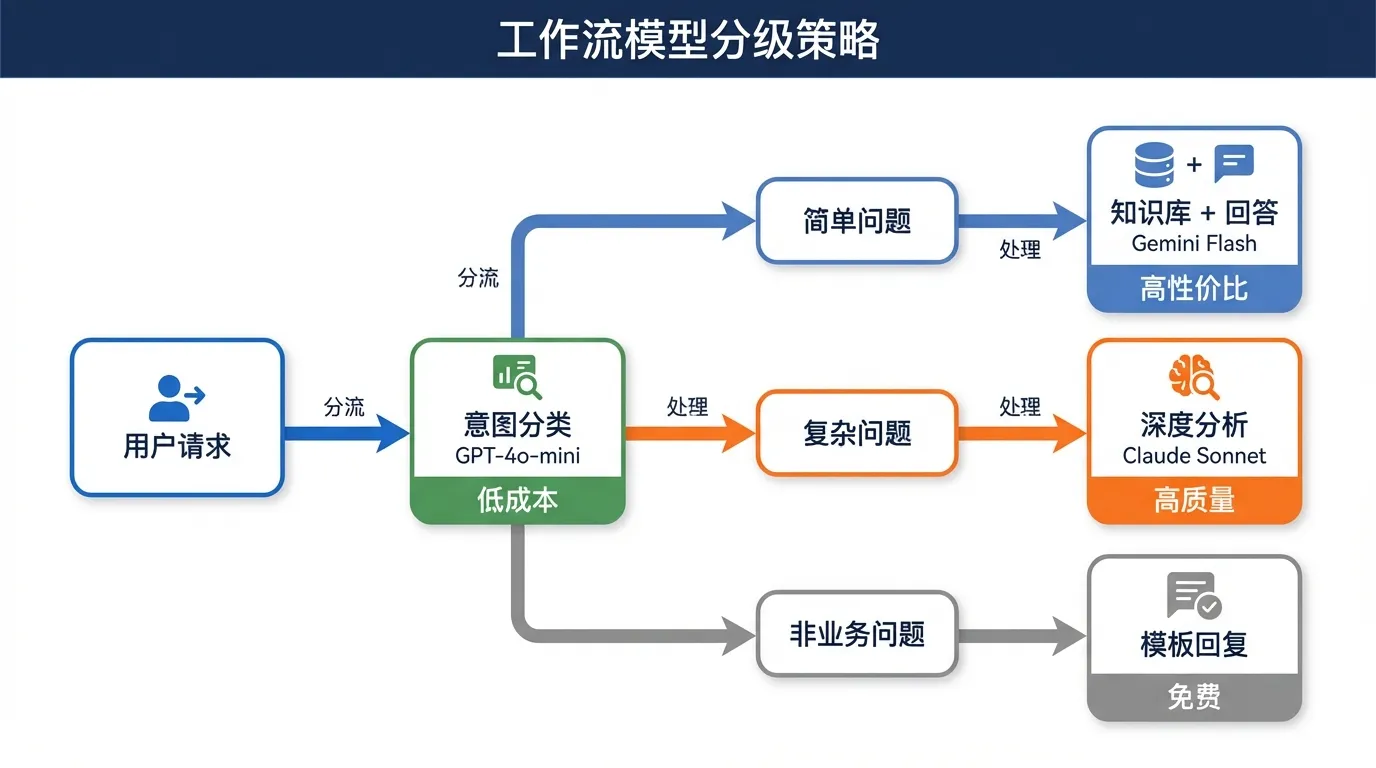

Стратегия разделения моделей в рабочих процессах

Главное преимущество рабочих процессов Dify: разные узлы могут использовать разные модели. Грамотное разделение значительно снижает затраты.

Рекомендуемая схема

| Тип задачи | Рекомендуемая модель | Цена (за млн токенов) | Пояснение |

|---|---|---|---|

| Определение намерения / классификация | GPT-4o-mini | $0.15 / $0.60 | Простые задачи, лёгкой модели достаточно |

| Суммаризация / рерайт | Gemini 3 Flash | $0.50 / $3.00 | Высокая цена/качество, быстрая |

| Сложные рассуждения / анализ | Claude Sonnet 4.6 | $3.00 / $15.00 | Сильна в длинных текстах и логике |

| Генерация кода / отладка | GPT-4o | $2.50 / $10.00 | Сильные способности в коде |

| Понимание изображений | Gemini 3 Pro | $2.00 / $12.00 | Лучший в мультимодальности |

Пример рабочего процесса

Пример рабочего процесса «Умная поддержка»:

Вопрос пользователя

↓

[Классификация намерения] ← GPT-4o-mini ($0.15/M)

↓

├── Простой вопрос → [Поиск по базе знаний + ответ] ← Gemini 3 Flash ($0.50/M)

├── Сложный вопрос → [Глубокий анализ + ответ] ← Claude Sonnet 4.6 ($3.00/M)

└── Нецелевой вопрос → [Вежливый отказ] ← Шаблонный ответ (бесплатно)При такой стратегии 80% запросов обрабатываются дешёвыми моделями, общие расходы снижаются на 70% и более по сравнению с использованием только флагманской модели.

Типичные ошибки и решения

401 Unauthorized

Error: Incorrect API key providedПричина: недействительный API Key Решение:

- Повторно скопируйте ключ — без пробелов до и после

- Убедитесь, что ключ не просрочен и не аннулирован

- При использовании пользовательского Base URL — убедитесь, что ключ соответствует платформе

404 Not Found

Error: The model 'xxx' does not existПричина: неверный ID модели Решение:

- Проверьте написание (с учётом регистра)

- Убедитесь, что ваш тариф включает данную модель

- Обратитесь к документации поставщика за правильным ID

429 Too Many Requests

Error: Rate limit reachedПричина: превышение лимита частоты Решение:

- Снизить количество параллельных запросов

- Настроить балансировку с несколькими API Key

- Использовать агрегатор — обычно с более высокими лимитами

Таймаут подключения

Error: Connection timeoutПричина: сетевые проблемы, типично при прямом подключении из Китая Решение:

- Использовать узлы ускорения агрегатора в Китае

- Проверить настройки файрвола и прокси

- При развёртывании Dify в Docker — проверить сетевой режим

В Docker-окружении Dify не может подключиться к локальной модели

Error: Connection refused (localhost:11434)Причина: localhost внутри Docker-контейнера — это не хост-машина

Решение: измените адрес Ollama на http://host.docker.internal:11434 (macOS/Windows) или реальный IP хост-машины (Linux).

Часто задаваемые вопросы (FAQ)

В: Есть ли разница в настройке API между Community Edition и Cloud Edition Dify?

О: Функционально практически идентичны. В Community Edition (самостоятельное развёртывание) все API Key готовите сами; Cloud Edition (dify.ai) дополнительно предлагает собственного поставщика с встроенными квотами. Процесс настройки пользовательского API полностью одинаков.

В: Безопасно ли хранение API Key в Dify?

О: В Community Edition ключи хранятся в зашифрованном виде в вашей собственной базе данных. В Cloud Edition — на серверах Dify. Если безопасность в приоритете — рекомендуется самостоятельное развёртывание.

В: Настроил модель, но не могу выбрать в рабочем процессе — что делать?

О: Проверьте три момента: 1) Тип модели совпадает (узел LLM может использовать только модели типа LLM); 2) Статус модели — прошла ли проверку; 3) Обновите страницу или откройте редактор рабочего процесса заново.

В: Как настроить модель Embedding?

О: Аналогично через OpenAI-API-compatible, тип модели — Text Embedding, название модели: text-embedding-3-small или text-embedding-ada-002. Модели Embedding нужны для индексирования и поиска в базе знаний.

В: Можно ли использовать Rerank-модели в Dify?

О: Да. Добавьте Rerank-модель в поставщиках (например, Cohere rerank-v3.5 или bge-reranker), затем включите Rerank в настройках поиска по базе знаний — это существенно повысит точность поиска.

Итоги и план действий

Три шага настройки API в Dify

- Оцените потребности: какие модели нужны, есть ли сетевые ограничения

- Выберите способ подключения:

- Прямой доступ есть - используйте официальных поставщиков, самый простой вариант

- Из Китая - OpenAI-совместимый API + агрегатор

- Высокие требования к конфиденциальности - локальное развёртывание через Ollama

- Оптимизируйте конфигурацию:

- Настройте несколько наборов учётных данных для балансировки

- Разделите модели по задачам в рабочих процессах

- Регулярно проверяйте расход API и частоту ошибок

Рекомендуемый подход

Для большинства разработчиков из Китая самое удобное решение:

Платформа-агрегатор + канал OpenAI-API-compatible в Dify. Один Key, один Base URL — свободное переключение между 50+ моделями, прямой доступ из Китая с низкой задержкой.

Если у вас ещё нет подходящего агрегатора — попробуйте Ofox: единый OpenAI-совместимый интерфейс, бесплатный баланс при регистрации, поддержка GPT, Claude, Gemini, DeepSeek и других популярных моделей.