AI API 报错排查完全指南:429、401、500 错误码一文搞定(2026)

摘要

调 AI API 遇到报错是家常便饭——429 限流、401 鉴权失败、500 服务端炸了,每个都能让你卡半天。本文系统梳理了 OpenAI GPT-5.4、Anthropic Claude、Google Gemini 三大主流 AI API 的常见错误码,给出可复制的排查步骤和生产级代码方案。重点:90% 的 429 错误可以用指数退避 + 请求队列彻底解决,剩下 10% 是额度问题。如果你在用 Cursor、Claude Code 等 AI 编程工具或者搭建 AI Agent,本文的错误处理方案同样适用。

目录

- 问题背景:为什么 AI API 报错这么多?

- 429 Too Many Requests:限流错误排查

- 401/403 认证与权限错误

- 400 请求参数错误

- 500/502/503 服务端错误

- 408/504 超时错误:API 调用太慢怎么办

- 生产环境最佳实践:一劳永逸的错误处理

- 各平台错误码速查表

- 常见问题(FAQ)

- 总结与行动建议

- 参考资料

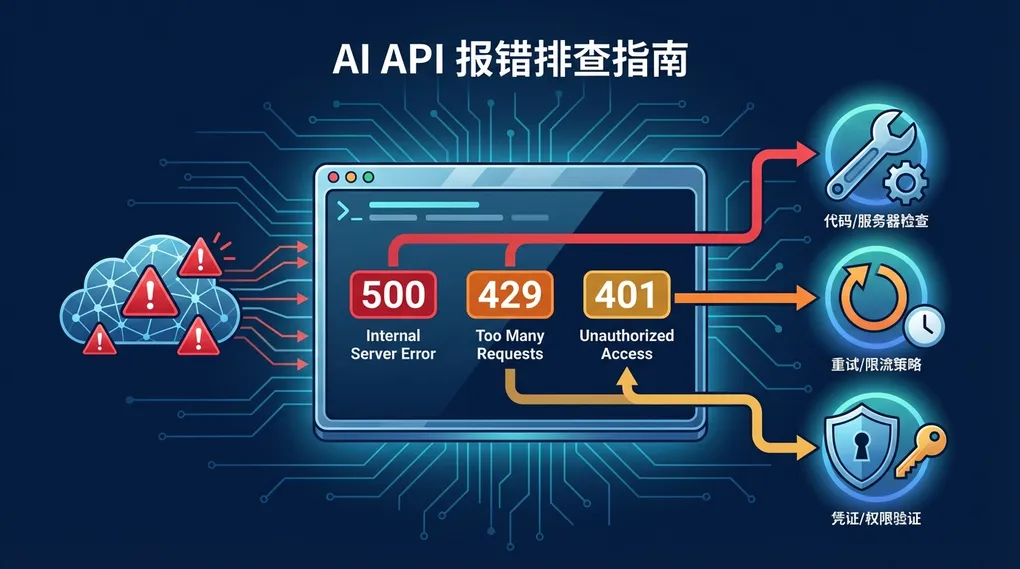

问题背景:为什么 AI API 报错这么多?

如果你用过 OpenAI、Claude 或 Gemini 的 API,大概率遇到过各种报错。不是 429 限流就是 500 崩溃,偶尔还来个 401 让你怀疑人生。2026 年 3 月,随着 GPT-5.4 和 Gemini 3.1 Flash-Lite 的发布,API 生态更加丰富,但报错类型也随之增多。

这不是你的问题。AI API 的报错率天然比传统 API 高,原因有三:

- 资源密集:每次请求都要占用 GPU 算力,服务端对并发极其敏感

- 多级限流:RPM(每分钟请求数)、TPM(每分钟 Token 数)、RPD(每日请求数)三重限制叠加

- 服务不稳定:大模型推理服务的可用性通常在 99.5%-99.9%,比传统 API 的 99.99% 低一个数量级

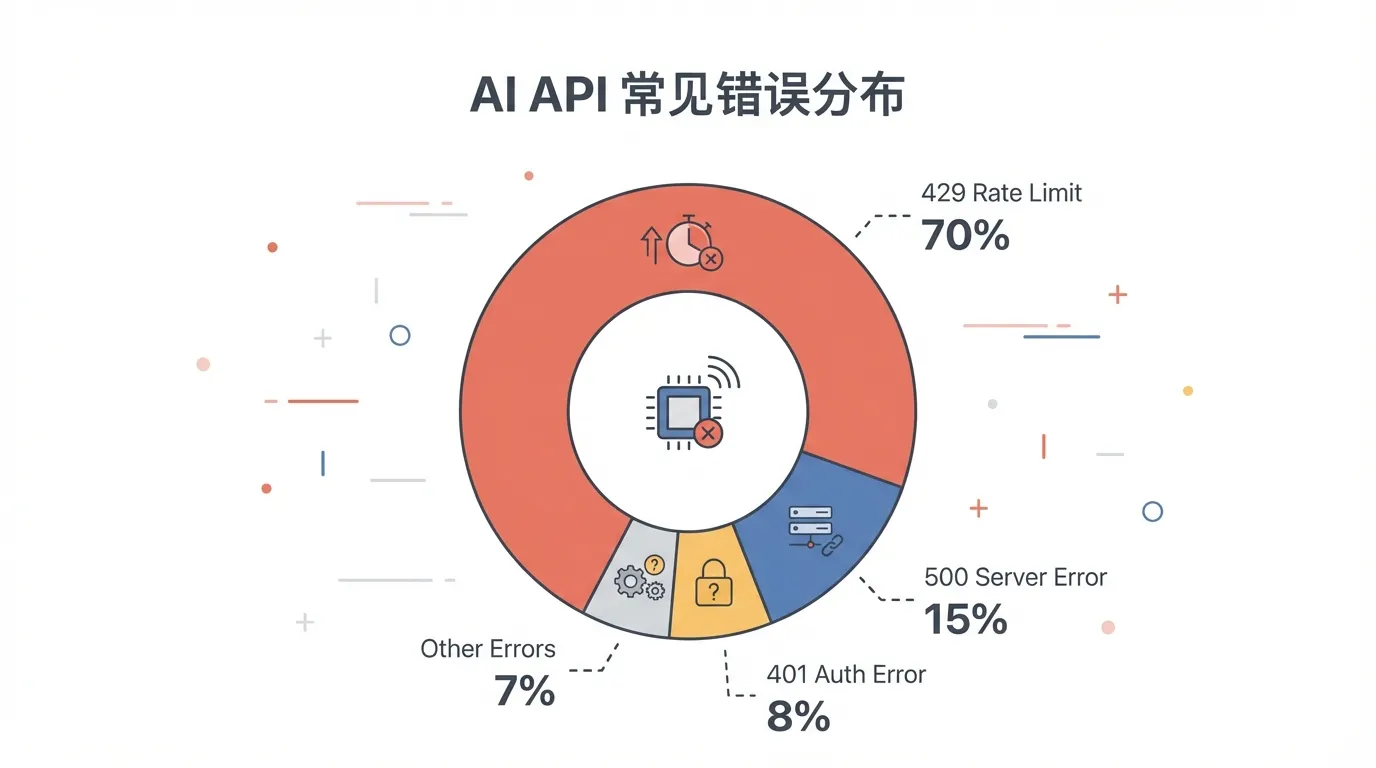

根据社区统计,AI API 报错中 429 限流占 70%,500 系列服务端错误占 15%,认证问题占 8%,其余 7% 是参数错误。

下面按出现频率从高到低,逐一拆解。

429 Too Many Requests:限流错误排查

429 是 AI API 开发者的”老朋友”了,意味着你的请求频率超过了平台限制。

为什么会触发 429?

| 触发原因 | 说明 | 常见场景 |

|---|---|---|

| RPM 超限 | 每分钟请求次数超出配额 | 批量调用、并发测试 |

| TPM 超限 | 每分钟 Token 消耗超出配额 | 长文本处理、大量上下文 |

| 日配额用尽 | 当天请求总量达到上限 | 免费层级用户 |

| 账户余额不足 | 预付费额度用完 | 忘记充值 |

| 组织级限流 | 同一组织下多个项目共享配额 | 团队协作场景 |

排查三步走

第一步:确认是哪种限流

OpenAI 的 429 响应体会告诉你具体原因:

{

"error": {

"message": "Rate limit reached for gpt-4o on tokens per min (TPM): Limit 30000, Used 28000, Requested 5000.",

"type": "tokens",

"code": "rate_limit_exceeded"

}

}关键看 type 字段——tokens 是 TPM 超限,requests 是 RPM 超限。同时注意 429 响应的 Retry-After 头,它会告诉你需要等待多少秒才能发起下一次请求。

第二步:检查当前配额

各平台查看配额的方式:

- OpenAI:platform.openai.com/account/limits

- Anthropic:console.anthropic.com/settings/limits

- Google:aistudio.google.com/apikey

第三步:对症下药

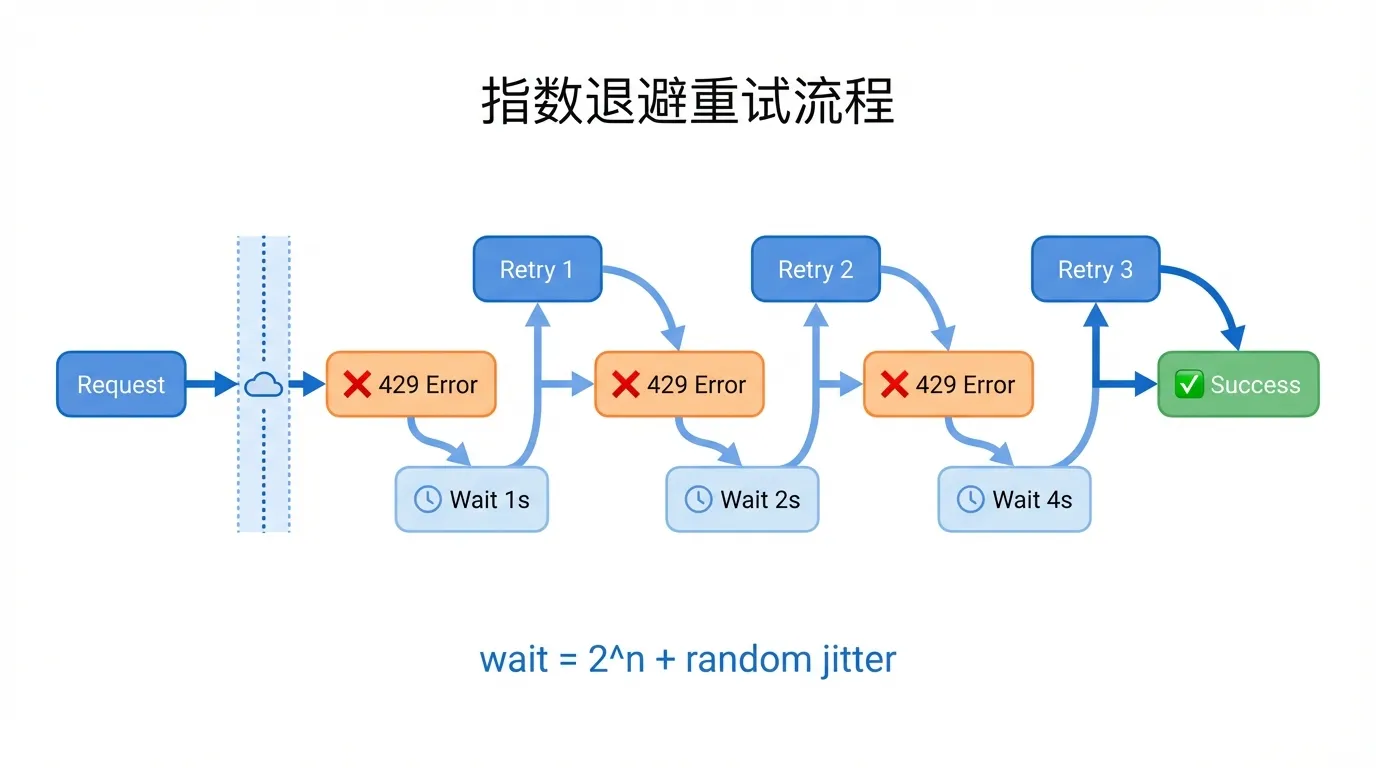

方案一:指数退避重试(必备)

这是处理 429 的标准做法,任何生产环境都必须实现:

import time

import random

from openai import OpenAI

client = OpenAI()

def call_with_retry(messages, max_retries=5):

"""指数退避重试,处理 429 限流"""

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model="gpt-4o",

messages=messages

)

return response

except Exception as e:

if "429" in str(e) and attempt < max_retries - 1:

# 指数退避 + 随机抖动

wait = (2 ** attempt) + random.uniform(0, 1)

print(f"限流了,等待 {wait:.1f}s 后重试(第 {attempt+1} 次)")

time.sleep(wait)

else:

raise方案二:请求队列 + 令牌桶限速

当你需要批量处理时,主动限速比被动重试更优雅:

import asyncio

from asyncio import Semaphore

class RateLimiter:

"""令牌桶限速器"""

def __init__(self, rpm=50, tpm=40000):

self.rpm_semaphore = Semaphore(rpm)

self.tpm_limit = tpm

self.tpm_used = 0

async def acquire(self, estimated_tokens=500):

await self.rpm_semaphore.acquire()

while self.tpm_used + estimated_tokens > self.tpm_limit:

await asyncio.sleep(1)

self.tpm_used += estimated_tokens

def release(self):

self.rpm_semaphore.release()

# TPM 每分钟重置(简化实现)

limiter = RateLimiter(rpm=50, tpm=40000)

async def rate_limited_call(messages):

await limiter.acquire()

try:

response = await aclient.chat.completions.create(

model="gpt-4o",

messages=messages

)

return response

finally:

limiter.release()方案三:升级 Usage Tier

如果业务量确实需要更高配额,最直接的方式是升级:

| OpenAI Tier | 月消费门槛 | GPT-4o RPM | GPT-4o TPM |

|---|---|---|---|

| Free | $0 | 3 | 40,000 |

| Tier 1 | $5 | 500 | 30,000 |

| Tier 2 | $50 | 5,000 | 450,000 |

| Tier 3 | $100 | 5,000 | 800,000 |

| Tier 4 | $250 | 10,000 | 2,000,000 |

| Tier 5 | $1,000 | 10,000 | 30,000,000 |

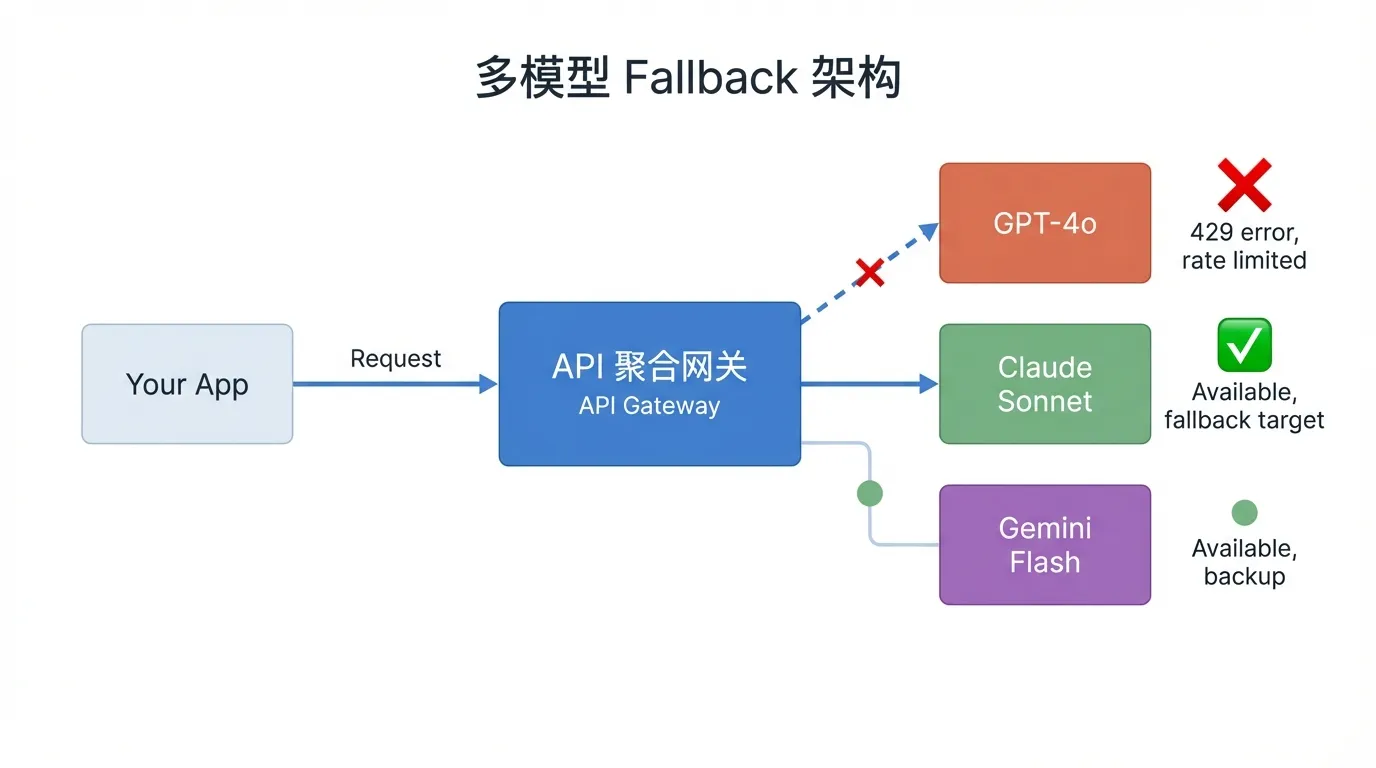

方案四:多模型负载均衡

当单一 API 的配额不够用时,可以通过聚合多个模型来分散压力。比如用 Ofox.ai 这样的 API 聚合网关,一个接口同时接入 GPT、Claude、Gemini 等 50+ 模型,自动在多个上游之间做负载均衡:

from openai import OpenAI

# 兼容 OpenAI SDK,切换 base_url 即可

client = OpenAI(

api_key="your-ofox-key",

base_url="https://api.ofox.ai/v1"

)

# 主模型限流时自动 fallback 到备选模型

models = ["gpt-5.4", "claude-sonnet-4-20250514", "gemini-2.5-flash"]

def call_with_fallback(messages):

for model in models:

try:

return client.chat.completions.create(

model=model,

messages=messages

)

except Exception as e:

if "429" in str(e):

continue

raise

raise Exception("所有模型都限流了")这种方式在中国区还有额外优势——通过阿里云/火山云加速节点,延迟比直连海外 API 低 50% 以上。

401/403 认证与权限错误

401 Unauthorized

最常见的原因就三个:

- API Key 写错了:复制时多了空格、少了字符

- Key 被吊销:泄露到 GitHub 后被平台自动禁用

- Key 过期:部分平台的 Key 有有效期

快速排查:

# 测试 OpenAI Key 是否有效

curl https://api.openai.com/v1/models \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-s | head -20

# 测试 Anthropic Key

curl https://api.anthropic.com/v1/messages \

-H "x-api-key: $ANTHROPIC_API_KEY" \

-H "content-type: application/json" \

-H "anthropic-version: 2023-06-01" \

-d '{"model":"claude-sonnet-4-20250514","max_tokens":10,"messages":[{"role":"user","content":"hi"}]}' \

-s | head -20403 Forbidden

403 和 401 的区别:401 是”你是谁?“,403 是”我知道你是谁,但你没权限”。

常见原因:

- 模型访问权限不足:比如 GPT-4 需要 Tier 1 以上

- 区域限制:部分模型不对某些地区开放

- 组织权限:Key 所属的组织没有开通对应服务

解决方案:检查 API Key 对应的组织权限设置,确认模型访问列表。如果你在使用 Claude API,可以参考 Claude API 国内使用指南 了解完整的权限配置流程。

400 请求参数错误

400 错误意味着你的请求格式有问题。常见的坑:

JSON 格式问题

# ❌ 错误:messages 格式不对

response = client.chat.completions.create(

model="gpt-4o",

messages="请帮我写代码" # 应该是列表

)

# ✅ 正确

response = client.chat.completions.create(

model="gpt-4o",

messages=[{"role": "user", "content": "请帮我写代码"}]

)模型名称错误

# ❌ 这些都会报 400

model = "gpt4o" # 少了横杠

model = "gpt-4-o" # 多了横杠

model = "claude-3.5" # 版本号格式错

# ✅ 正确的模型名称(2026 年 3 月最新)

model = "gpt-4o"

model = "gpt-5.4" # 2026.3 最新

model = "claude-sonnet-4-20250514"

model = "gemini-2.5-flash"

model = "gemini-3.1-flash-lite" # 2026.3 最新Token 超限

每个模型有最大上下文长度限制。当你的 input + max_tokens 超过限制时会报 400:

| 模型 | 最大上下文 | 最大输出 |

|---|---|---|

| GPT-4o | 128K | 16K |

| GPT-5.4 Thinking | 1M | 32K |

| Claude Sonnet 4 | 200K | 64K |

| Gemini 2.5 Flash | 1M | 65K |

| Gemini 3.1 Flash-Lite | 1M | 65K |

解决方法:在发送前估算 Token 数,必要时截断上下文。

500/502/503 服务端错误

服务端错误不是你的问题,但你得优雅地处理它。

500 Internal Server Error

服务端内部错误,通常是临时的。处理策略:

import time

def handle_server_error(func, max_retries=3):

"""服务端错误重试(不退避太久,因为不是限流)"""

for attempt in range(max_retries):

try:

return func()

except Exception as e:

error_code = getattr(e, 'status_code', 0)

if error_code in (500, 502, 503) and attempt < max_retries - 1:

time.sleep(2 * (attempt + 1)) # 线性退避

continue

raise502 Bad Gateway

通常是上游服务器过载。在高峰期(如 GPT 新版本发布后)特别常见。

503 Service Unavailable

模型正在维护或过载。Anthropic Claude 在高负载时会返回 529 Overloaded(非标准状态码),处理方式等同 503。

实用技巧:关注各平台的状态页:

- OpenAI:status.openai.com

- Anthropic:status.anthropic.com

- Google AI:status.cloud.google.com

408/504 超时错误:API 调用太慢怎么办

AI API 调用慢是开发者最头疼的问题之一。一次 GPT-4o 请求平均耗时 3-8 秒,复杂任务可能超过 30 秒。

延迟优化六板斧

1. 开启 Streaming(最有效)

Streaming 不会减少总生成时间,但能把首字节响应时间(TTFT)压缩到 1 秒以内:

stream = client.chat.completions.create(

model="gpt-4o",

messages=[{"role": "user", "content": "写一段代码"}],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="")2. 控制输出长度

每个 output token 增加几毫秒到几十毫秒的延迟。明确限制输出长度:

response = client.chat.completions.create(

model="gpt-4o",

messages=messages,

max_tokens=500, # 限制输出

temperature=0 # 确定性输出,略微减少延迟

)3. 用小模型替代大模型

不是所有任务都需要最强模型:

| 场景 | 推荐模型 | 平均延迟 |

|---|---|---|

| 简单分类/提取 | GPT-4o-mini / Gemini 3.1 Flash-Lite | <1s |

| 代码生成 | Claude Sonnet 4 / GPT-4o | 2-5s |

| 复杂推理 | GPT-5.4 Thinking / Claude Opus 4 | 5-15s |

4. 精简 Prompt

减少 input tokens 直接降低处理时间。去掉冗余的 system prompt,用结构化指令替代长篇描述。

5. 并行请求

如果有多个独立的 AI 任务,不要串行执行:

import asyncio

async def parallel_calls(prompts):

tasks = [

aclient.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": p}]

)

for p in prompts

]

return await asyncio.gather(*tasks)6. 就近接入

API 请求的网络延迟在中国区尤其明显。直连 OpenAI 的网络往返时间(RTT)通常在 300-500ms,而通过国内云加速节点可以降到 50-100ms。像 Ofox.ai 的阿里云/火山云加速节点,能把网络延迟压缩 80% 以上,对 streaming 场景效果尤其明显——每个 chunk 都少 200ms 的等待。

生产环境最佳实践:一劳永逸的错误处理

把上面所有方案整合成一个生产级的 API 客户端:

import time

import random

import logging

from openai import OpenAI

logger = logging.getLogger(__name__)

class RobustAIClient:

"""生产级 AI API 客户端,内置错误处理"""

def __init__(self, api_key, base_url="https://api.openai.com/v1"):

self.client = OpenAI(api_key=api_key, base_url=base_url)

def chat(self, messages, model="gpt-4o", max_retries=5, **kwargs):

for attempt in range(max_retries):

try:

return self.client.chat.completions.create(

model=model,

messages=messages,

**kwargs

)

except Exception as e:

status = getattr(e, 'status_code', 0)

error_msg = str(e)

# 429 限流:指数退避

if status == 429 or "429" in error_msg:

wait = min(2 ** attempt + random.uniform(0, 1), 60)

logger.warning(f"限流,等待 {wait:.1f}s(第{attempt+1}次)")

time.sleep(wait)

continue

# 500/502/503 服务端错误:短暂重试

if status in (500, 502, 503, 529):

wait = 2 * (attempt + 1)

logger.warning(f"服务端错误 {status},等待 {wait}s")

time.sleep(wait)

continue

# 400/401/403 客户端错误:不重试,直接抛出

if 400 <= status < 500:

logger.error(f"客户端错误 {status}: {error_msg}")

raise

# 未知错误

if attempt == max_retries - 1:

raise

time.sleep(1)

raise Exception(f"重试 {max_retries} 次后仍然失败")

# 使用示例

client = RobustAIClient(

api_key="your-key",

base_url="https://api.ofox.ai/v1" # 可选:用聚合网关

)

response = client.chat(

messages=[{"role": "user", "content": "Hello"}],

model="gpt-4o"

)各平台错误码速查表

| 错误码 | OpenAI | Claude | Gemini | 含义 | 处理方式 |

|---|---|---|---|---|---|

| 400 | ✅ | ✅ | ✅ | 参数错误 | 检查请求格式 |

| 401 | ✅ | ✅ | ✅ | 认证失败 | 检查 API Key |

| 403 | ✅ | ✅ | ✅ | 权限不足 | 检查模型/区域权限 |

| 404 | ✅ | ✅ | ✅ | 资源不存在 | 检查模型名/端点 |

| 408 | ✅ | — | — | 请求超时 | 减少 Token/开 Stream |

| 429 | ✅ | ✅ | ✅ | 限流 | 指数退避 + 升级配额 |

| 500 | ✅ | ✅ | ✅ | 服务端错误 | 重试 |

| 502 | ✅ | ✅ | — | 网关错误 | 重试 |

| 503 | ✅ | ✅ | ✅ | 服务不可用 | 等待 + 重试 |

| 529 | — | ✅ | — | 过载 | 等待 + 重试 |

常见问题(FAQ)

Q:GPT API 一直报 429,充了钱还是不行怎么办?

充值后需要等待系统自动升级 Usage Tier,通常几分钟到几小时不等。你可以在 OpenAI 后台的 Limits 页面查看当前 Tier。如果确认 Tier 已升级但还是 429,检查是否是 TPM(Token 限流)而不是 RPM——长 prompt 很容易打满 TPM。

Q:AI API 调用太慢,有没有不换模型就能提速的方法?

有三个立竿见影的方法:① 开启 streaming 模式,首字节延迟从 3-5 秒降到 <1 秒;② 减少 prompt 长度和 max_tokens;③ 使用就近加速节点,国内开发者通过云加速可以减少 200-400ms 网络延迟。

Q:API Key 泄露到 GitHub 了怎么办?

立即到对应平台后台删除该 Key 并重新生成。OpenAI 和 Google 都有自动检测机制,发现 Key 出现在公开代码库后会自动吊销。以后建议用环境变量管理 Key,绝不硬编码到代码中。

Q:开发时用哪个 AI API 平台性价比最高?

取决于用量和场景。如果你需要同时用多个模型(比如 GPT 做生成、Claude 做分析、Gemini 做多模态),API 聚合平台比较省事——一个 Key 接入所有模型,统一计费,还能自动 fallback。比如 Ofox.ai 支持 50+ 模型,中国区有加速节点,适合国内开发者。

Q:生产环境需要实现哪些错误处理?

至少需要:① 所有请求实现指数退避重试;② 区分客户端错误(4xx 不重试)和服务端错误(5xx 重试);③ 设置合理的超时时间(建议 30-60 秒);④ 记录错误日志,包含请求 ID 方便排查;⑤ 关键路径设置 fallback 模型。

总结与行动建议

AI API 报错不可怕,可怕的是没有系统化的处理策略。建议你按这个优先级落地:

- 立即做:给所有 API 调用加上指数退避重试(30 分钟搞定)

- 本周做:实现一个统一的错误处理封装(参考上面的

RobustAIClient) - 长期做:搭建监控告警——记录每次 API 调用的延迟、错误率、Token 消耗

如果你在中国区开发,强烈建议用带加速节点的 API 网关,网络延迟的差距是实打实的。可以到 Ofox.ai 开发文档 了解接入方式,注册即可体验。

延伸阅读:如果你在搭建更复杂的 AI 应用,这些指南可能也有帮助:

- Function Calling 完全指南:GPT/Claude API 函数调用实战

- AI API 降本增效指南:省 50% 费用的实战策略

- Embedding + RAG 开发指南

- Dify API 配置指南