字节豆包 Doubao Seed 2.0 完全指南:Pro/Code/Lite/Mini 怎么选、怎么用(2026)

字节跳动的 AI 棋局,开发者该怎么下

抖音、TikTok 之外,字节跳动把大量资源押注在大模型上。豆包大模型团队规模不小,Seed 系列是他们最新的成果——不只用在自家 App 里,而是作为 API 开放给外部开发者。

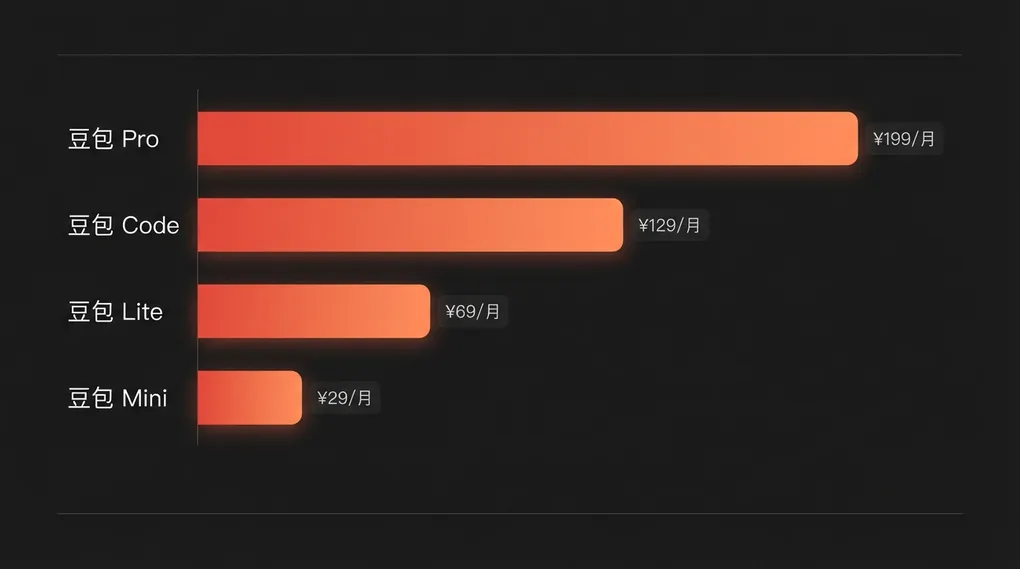

Seed 2.0 系列一共四个变体:Pro、Code、Lite、Mini,外加一个图像生成模型 Seedream 5.0 Lite。定价从 $0.06/M 到 $0.67/M 不等,上下文都是 256K,支持视觉输入、函数调用、推理模式。

问题来了:四个版本,到底选哪个?

Seed 2.0 全系一览

| 模型 | 模型 ID | 输入价格 | 输出价格 | 擅长场景 |

|---|---|---|---|---|

| Seed 2.0 Pro | volcengine/doubao-seed-2.0-pro | $0.67/M | $3.36/M | 通用旗舰、长文本、复杂推理 |

| Seed 2.0 Code | volcengine/doubao-seed-2.0-code | $0.67/M | $3.36/M | 代码生成、调试、技术问答 |

| Seed 2.0 Lite | volcengine/doubao-seed-2.0-lite | $0.13/M | $0.76/M | 日常对话、轻量分析 |

| Seed 2.0 Mini | volcengine/doubao-seed-2.0-mini | $0.06/M | $0.56/M | 批量任务、格式提取、高并发 |

| Seedream 5.0 Lite | volcengine/doubao-seedream-5.0-lite | — | $0.035/张 | 图像生成 |

四款文本模型都支持 256K 上下文、视觉输入、函数调用和推理模式,缓存也有做。这一点比不少厂商的低价档位厚道——Lite 和 Mini 虽然便宜,基础能力没有缩水太多。

Pro:通用场景的默认选择

Seed 2.0 Pro 是这个系列的旗舰。字节跳动内部大量产品用的就是这一档,包括豆包 App 的主要功能。

256K 的上下文在国产模型里不算小,一份完整的法律合同、一个季度的财报、一本技术手册,塞进去不费力。Pro 版在多步骤问题上比 Lite/Mini 更稳——竞争分析、需求文档、方案设计这类需要「想一想」的任务,完成质量更接近 Claude Sonnet 4.6 这个档位。结合函数调用和推理模式,也适合做多步骤 Agent 工作流的编排。

跟 Claude Sonnet 4.6 比的话:Pro 版定价便宜不少(Sonnet 4.6 输入 $3/M),但在指令遵循和长上下文质量上还是有差距。客户会直接看到 AI 回复的场景,Claude 更保险;内部工具和辅助性任务,Pro 的性价比更高。

关于横向选型,2026 大模型排行榜与选型指南里有更全面的模型能力对比。

Code:程序员专属的隐藏版本

Seed 2.0 Code 和 Pro 定价完全一样,但针对编程任务单独优化过。

字节跳动内部的代码助手、Trae 编辑器(字节的 AI IDE)背后用的就是这个版本。优化方向是理解代码仓库上下文、生成符合项目规范的代码、给出精准的调试建议。函数补全和模块重构上,Code 生成的代码逻辑更连贯;代码审查时能发现一些 Pro 会忽略的逻辑漏洞;技术文档生成,从代码到注释、README 的转化质量更高。

但 Code 不代表「编程领域全面领先」。极度复杂的算法题、底层 C/Rust 系统编程,Claude Code + Opus 4.6 依然更可靠。Code 的优势是在常见工程场景下够用、响应快、不贵。

如果你在用 OpenClaw、Cursor 或 Cline,OpenClaw 模型推荐排行榜里有详细的工具配合实测。

Lite:日常用量的主力

Lite 是价格跳水的分水岭:$0.13/M 输入,$0.76/M 输出,不到 Pro 的 1/5。

这个价格点有竞争力。GLM-4.7-FlashX($0.072/M)更便宜,但 Lite 能力更强;MiniMax M2.5($0.3/M)能力相近,但 Lite 更便宜。

聊天机器人的常规对话轮次、文档问答、知识库检索辅助、内容分类和标签生成——这些场景用 Lite 绰绰有余。天花板在于深度推理和创意输出,让它写复杂的分析报告,输出会比较平。

粗估一下成本:一个月调用 Lite 处理 10 万条短消息,每条平均 500 tokens,月消耗约 5000 万 tokens,大约 $6.5,一杯咖啡的价钱。

Mini:批量任务的价格底线

Mini 是整个系列里最便宜的:$0.06/M 输入、$0.56/M 输出。

便宜不代表没用。Mini 的定位是高并发、批量、格式化任务——这些场景量很大,但不需要顶级输出质量。

最典型的用法是对话路由分发:先用 Mini 判断用户请求属于哪个类别(咨询、投诉、技术问题),再把流量分发给对应的专属模型。这一步 Mini 够用,没必要用 Pro。几十万条非结构化文本要批量提取字段?Mini 处理速度快、价格低。或者让它做第一层内容安全筛选,不合格的直接过滤,通过的再送给更贵的模型精处理。

多轮对话质量不稳定,推理深度有限——简单回复没问题,但别期望它在复杂问题上有清晰的逻辑。

Seedream 5.0 Lite:图像生成的附加价值

这个模型和 Seed 2.0 文本系列不同类,但值得一提。

Seedream 是字节跳动自研的图像生成模型,5.0 Lite 在 OfoxAI 上是 $0.035/张,按张计费比 token 计费更直观。产品有轻量图片生成需求(封面图、插画、产品展示图)的话,Seedream 5.0 Lite 可以作为 DALL-E 3 或 Flux 的国产替代,省去处理 OpenAI 账号的麻烦。

通过 OfoxAI 接入:为什么不走官方渠道

豆包模型的官方渠道是火山引擎(volcengine.com),但对个人开发者不太友好:需要企业认证才能正式商用,支付必须走企业账户。

通过 OfoxAI 接入就省事得多。一个 API Key 同时调用 Doubao、Claude、GPT、Gemini,不需要管理七八个账号;api.ofox.ai 国内直连不需要代理,延迟稳定;支持支付宝和微信,不需要处理美元汇率和信用卡;新用户有赠送额度,可以先测试模型效果再决定是否充值。

调用方式和所有 OpenAI 兼容平台一样,改两个参数:base_url 指向 https://api.ofox.ai/v1,model 用上面表格里的模型 ID(比如 volcengine/doubao-seed-2.0-pro)。从其他平台迁移的话,参考各 AI 工具的 API 配置指南。

选哪个?一张决策图

如果还拿不准,用这个逻辑走一遍:主要任务是编程或代码相关,选 Code。需要处理复杂推理、长文本、对话质量要求高,选 Pro。预算有限,常规对话或轻量分析,选 Lite。批量处理、高并发、格式化提取,选 Mini。需要生成图片,选 Seedream 5.0 Lite。

实际上很多项目会同时用两个层级:Mini 做路由和预处理,Pro 或 Code 做核心生成。这种分层策略在不降低关键环节质量的前提下能把成本压下去不少。如何设计这种架构,企业 AI API 选型避坑指南里有更详细的讨论。

最后

字节跳动在大模型市场的入场比较低调,Seed 2.0 没引发太多媒体轰动,但四档定价覆盖从 $0.06/M 到 $0.67/M,Code 版针对编程场景单独优化,Seedream 5.0 Lite 把图像生成也打包进来——该有的都有了,值得给个位置在你的模型工具箱里。

通过 OfoxAI 接入 Doubao 系列,在模型列表里搜 volcengine 可以看到全部版本和实时定价。