公司项目接入 AI API 要避开哪些坑?2026 企业选型实战经验

公司项目要接 AI API,技术负责人面对的第一个问题不是「怎么调」,而是「怎么选、怎么不踩坑」。

过去一年帮不少团队做过接入,踩坑的模式高度一致。不是技术能力不够,是决策环节缺信息。模型选错了烧钱,网络没考虑好延迟飙升,供应商绑死了想换换不掉。

下面是我们见过的 7 个高频坑,每个附上判断标准和应对方案。

坑一:选错模型,花了冤枉钱

最普遍的问题。很多团队一上来就选最贵的旗舰模型,GPT-5.4 或 Claude Opus 4.6,然后发现 80% 的调用场景根本用不到这个级别。

我见过一个电商团队用 Claude Opus 4.6 做商品描述生成,每月 token 费用超过 8000 元。后来换成 GPT-5.4 mini,效果几乎一样,月费降到 600 元以下。差了十几倍。

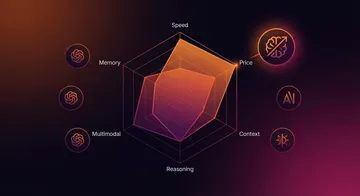

问自己一个问题:你的任务需要深度推理、长链条逻辑吗?如果只是分类、摘要、格式化,小模型完全够用。

建议先列出所有调用场景,按复杂度分档。简单任务(分类、提取)用 GPT-5.4 mini / nano 或 DeepSeek V4,中等任务(摘要、改写)用 Claude Sonnet 4.6,只有复杂推理和创作才需要上旗舰。别靠直觉判断,拿 100 条真实数据跑 A/B 测试,结果经常出乎意料。

模型分层策略的详细拆解在《如何降低 AI API 成本?7 个实测有效的优化策略》里。各模型的实测表现差异可以看《2026 大模型排行榜与选型指南》。

坑二:没考虑国内网络环境

技术调研时在自己电脑上测,延迟 200ms,觉得挺快。上线后用户反馈慢得不行。原因很简单:你的电脑可能走了代理,但国内服务器直连海外 API 是另一回事。

OpenAI、Anthropic、Google 的 API 都在海外。国内服务器直调,平均延迟 800ms-2s,高峰期直接超时。做客服或搜索增强的话,这个延迟根本没法用。

走 API 聚合平台中转是最直接的办法,优化线路能把延迟压到 300-500ms。如果场景对延迟不敏感(批量处理、后台分析),异步调用 + 队列也行。另外别忘了国产模型这条路:Kimi K2.5、MiniMax M2.7、DeepSeek V4、Qwen3 Max 在国内有节点,天然延迟低,适合做兜底方案。

更多延迟优化手段可以看《AI API 调用太慢怎么办?》。

坑三:成本失控,token 烧得比预算快

「试用阶段花了 50 块,觉得便宜,上线第一周就烧了 5000。」

太常见了。钱是怎么烧掉的?一般就三种情况:上线前没估算过每次调用的 token 数和日均调用量;system prompt 写了 2000 字,每次请求白白多一大截输入费用;没给接口设调用上限,某个用户一天刷完了全月预算。

应对起来也不复杂。上线前先算一笔账:平均输入 token × 调用次数 × 单价,得出月度预期开销。然后给每个用户和接口设 token 上限和频率限制。prompt caching(OfoxAI 和主流平台都支持)能让重复的 system prompt 只计费一次,这个省得很明显。上线之后每周看一次账单,异常波动及时排查。

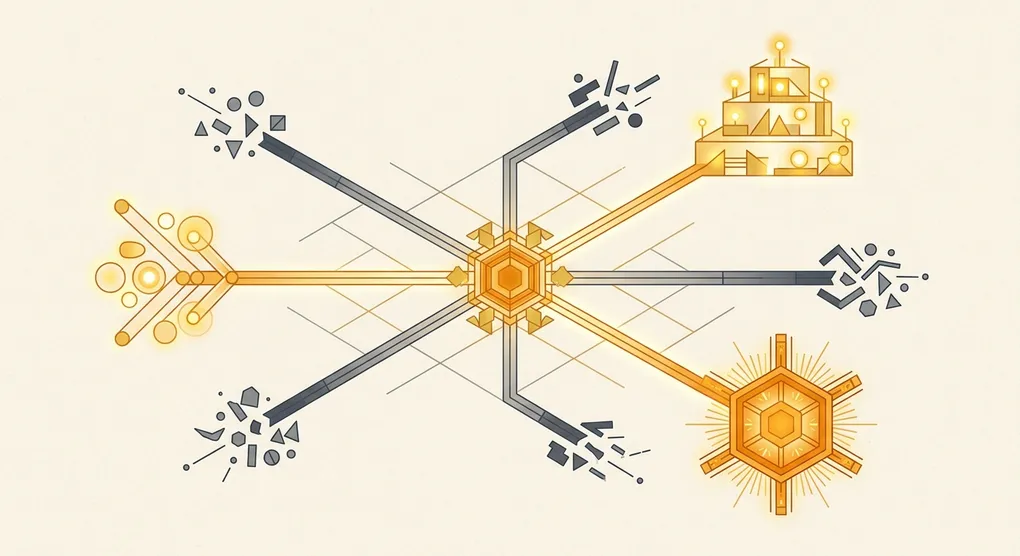

坑四:绑死单一供应商

只接了 OpenAI 的 API,某天 OpenAI 调价、限速、或者你的账号出了问题,整个服务就停了。

2025 年这事发生过不止一次。OpenAI 大面积限速,下游服务跟着降级;Anthropic 维护导致 API 不可用数小时。只有一条线路,就只能干等。

架构上要做模型抽象——业务代码不要直接写死某个模型的 SDK,通过一个统一接口层来调度。至少准备两家供应商互备,比如主力用 Claude,备用走 GPT 或国产模型。API 聚合平台在这方面有天然优势:一个 Key 背后接了几十个模型,切换改个参数就行。

多模型路由的实现思路可以看《多模型路由策略实战》。

坑五:忽略稳定性和容错

调 API 不是调数据库,不能假设每次都成功。

AI API 的响应时间很不稳定,200ms 到 30s 都有。偶尔返回 429(限速)或 500(服务端错误),长文本生成还可能中途断流。不做重试和降级处理,用户看到的就是白屏或者超时报错。

每个调用都设超时(建议 30s,流式放宽到 60s)。429 错误做指数退避重试:等 1s、2s、4s 依次重试。500 或超时就自动切备用模型。流式响应要处理中途断流,缓存已有结果方便续传。

错误码的完整对照表和处理方式在《AI API 报错排查完全指南》里。

坑六:安全合规没当回事

在国内做 AI 应用,合规不是可选项。

用户数据发送到海外模型服务器,就涉及数据跨境传输,要评估是否符合《个人信息保护法》和《数据出境安全评估办法》。AI 生成的内容需要安全过滤,防止输出违规内容。API Key 绝对不能硬编码在前端代码里,必须走后端代理。企业项目还需要审计日志,记录谁在什么时间调了什么模型。

敏感业务优先考虑国产模型,数据不出境。搭后端代理层,前端不接触 Key。内容审核接阿里云或腾讯云的现成服务就行。日志至少保留 90 天。

坑七:团队协作和权限管理缺失

一个人用 API 没问题,一个团队用就乱了。

所有人共用一个 API Key,分不清谁用了多少 token。某个开发在测试环境疯狂跑调用,把预算花光了。离职员工的 Key 没人回收,三个月后才发现。

解决办法:每人或每个项目分配独立的 Key,API 网关层面做用量统计和告警。Key 定期轮换,离职当天回收。测试环境和生产环境用不同的 Key 和额度,这个很容易忘但很重要。

企业 AI API 选型清单

把上面 7 个坑翻转过来,就是选型时应该逐项确认的清单:

| 维度 | 确认事项 |

|---|---|

| 模型匹配 | 是否针对不同场景选了合适级别的模型? |

| 网络延迟 | 国内服务器调用海外 API 的延迟是否可接受? |

| 成本可控 | 是否做过月度 token 预算?有没有设上限? |

| 供应商冗余 | 是否有备用模型和供应商? |

| 容错机制 | 是否有超时、重试、降级逻辑? |

| 合规审查 | 数据出境、内容审核、Key 管理是否到位? |

| 团队管理 | Key 是否独立分配?用量是否可追踪? |

每项打个勾,全绿了再上线。

聚合平台能帮你省掉多少麻烦?

上面 7 个坑,有一半以上可以通过选对 API 聚合平台来规避。

拿 OfoxAI 来说,它提供统一的 OpenAI 兼容接口,背后接了 100 多个模型(GPT-5.4、Claude Opus 4.6、Gemini 3.1 Pro、Kimi K2.5、MiniMax M2.7、DeepSeek V4 等),切换模型改个参数就行,不用动代码。

对企业比较有用的几点:国内直连不用自己搭代理;支持微信和支付宝付款;按量计费,旗舰模型价格大约是官方的 1/8;模型超时自动 fallback 到备用;每个项目可以独立分配 Key 和监控用量。

当然不是说一定要用聚合平台。但如果你的团队没有专门做基础架构的人来维护多套 API 对接,聚合平台能省掉很多重复建设的工作。

按场景展开的接入细节在《企业 AI 落地:7 个高 ROI 场景及模型选型实战经验》里,国内支付方案可以看《不用信用卡也能用 AI API》。

写在后面

7 个坑里,模型选错和成本失控最普遍,但供应商锁定和合规问题后果最严重。前两个亏的是钱,后两个可能影响业务连续性和法律合规。

我的建议是先在测试环境用小规模数据把效果和成本跑通,然后逐步放量。别想一步到位。