AI API 调用不稳定怎么办?高可用方案全解:fallback、负载均衡与故障切换

上线第一天一切正常,第二天用户开始投诉响应慢了一倍。查日志,发现 20% 的 API 请求超时,5% 直接 5xx。

调通接口容易,保持稳定难。这是 AI API 接入里最常被低估的那道坎。

官方 API 没有问题。它只是没有为你的业务场景做兜底。任何一层出问题,网络抖动、模型过载、限速,后果都落在用户头上。

为什么 AI API 比普通 API 更难保稳定

普通 API 如果慢,加一台机器就能水平扩展。AI API 不一样,它有几个结构性的不稳定来源。

推理本身就有抖动。同一个请求,响应时间可以从 500ms 到 5s,取决于模型当前负载。这不是 bug,是大语言模型推理的固有特性:token 逐个生成,长输出天然慢。

官方在高峰期主动限速。OpenAI、Anthropic 都有 RPM(每分钟请求数)和 TPM(每分钟 token 数)双维度限制。账号 tier 越低,限额越严。到了限额直接 429,没有排队机制,请求就丢掉了。

国内网络路径复杂。海外 API 国内直连,OpenAI 平均 800ms-2s 首 token,Google AI 更差。这个基础延迟叠加上模型本身的抖动,用户侧感知很差。关于如何解决延迟问题,《AI API 调用太慢?7 种实测有效的延迟优化方案》有详细拆解。

还有一个容易忽视的放大效应:单次调用 95% 成功率看起来不错,但如果你的 Agent 要连续调用 10 次,整体成功率变成 0.95^10 ≈ 60%。任务越复杂,失败概率越高。

高可用方案一:自动 fallback

fallback 是最直接的兜底机制:主模型失败了,自动换备用模型。

实现层面要定义几件事:触发条件、fallback 链、用户侧体验。

触发条件不是越宽越好。主要场景:超时(主模型 10s 没响应)、限速(429)、服务错误(5xx)、特定错误码(比如 Claude 的 529 overloaded)。业务逻辑错误(内容被拒绝)通常不该 fallback,换个模型结果一样。

fallback 链应该按成本和质量梯度设计,不是随机选:

| 级别 | 场景 | 模型示例 |

|---|---|---|

| 主模型 | 正常调用 | Claude Opus 4.6 |

| 同质备用 | 主模型超时/过载 | GPT-5.4 |

| 轻量降级 | 两个旗舰都限速 | Claude Sonnet 4.6 / GPT-5.4 mini |

| 最后兜底 | 极端情况 | DeepSeek V4(国内直连,响应稳定) |

越往后越轻量,但至少能给用户一个响应。

降级调用要决定是否让用户感知。透明处理更难,要求备用模型输出质量和主模型差距不大。如果差距明显,加一行提示”当前使用备用模型,结果仅供参考”反而更诚实。

各模型在实际场景下的稳定性差异,《2026 大模型排行榜与选型指南》里有收录。

高可用方案二:请求级负载均衡

fallback 解决的是”单个请求失败了怎么办”,负载均衡解决的是”怎么不让请求集中打死一个 API”。

最常见的做法是多 Key 轮询:持有多个 API Key,请求来了随机或轮流分配。这样同一时间窗口内的并发流量分散到多个账号,每个账号被触发限速的概率大幅下降。

更精细的做法是加权路由:给每个 Key 记录当前的剩余配额和近期错误率,优先把请求分到余量大、错误率低的 Key。这种做法需要维护状态,但效果比简单轮询好很多。

还有一种被忽视的优化:读写分离。如果你的场景同时有实时问答(低延迟敏感)和批量处理(容忍高延迟),把这两类请求分到不同的 API Key 或不同的模型,避免批量任务抢占实时任务的配额。

高可用方案三:熔断与限速保护

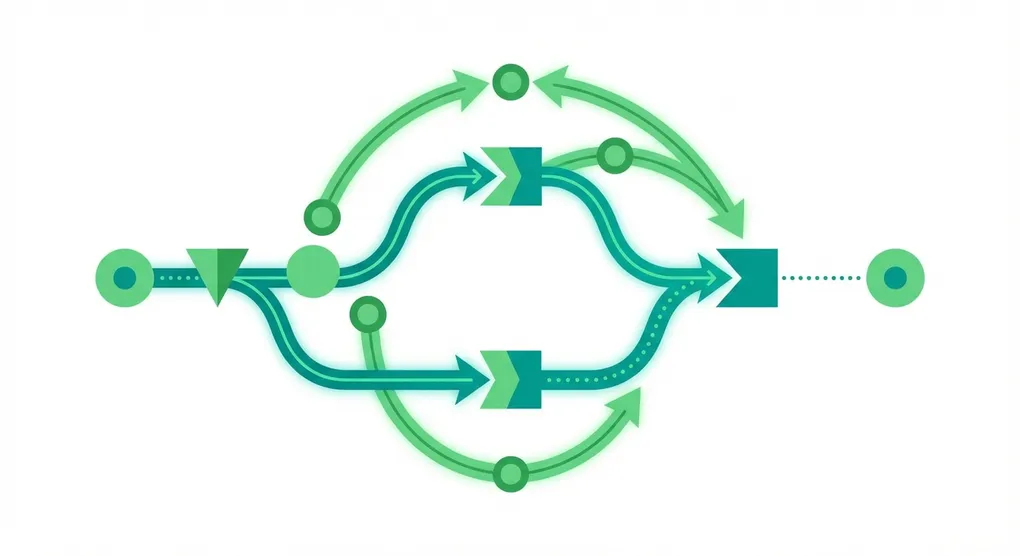

熔断是防止故障扩散的保护机制。检测到某个 API 在一段时间内连续失败,熔断器打开,后续请求直接走备用路径,不再等待超时。等故障恢复后,熔断器半开,用小流量探测,确认正常再关闭。

这个机制的价值在于它是主动的,不是等超时。一个 10s 超时的请求占用了用户的等待时间,熔断打开后后续请求立刻走备用,用户感知完全不同。

客户端限速保护是另一面:在调用 API 之前,先做本地的请求频率控制,保证发出去的请求不超过 API 的限额。这比被 429 了再重试更高效,429 本身消耗了一次请求,还要等退避窗口。

具体的报错码含义和重试策略,《AI API 报错大全:50+ 错误码完全排查手册》里有详细说明。

高可用方案四:指数退避重试

重试是必要的,但重试要有策略,不然容易把故障打成雪崩。

先分清哪些错误可以重试、哪些不行。可以重试的:429、503、超时、网络错误。不该重试的:400(参数错误)、401(认证失败)、内容违规。

用指数退避,不要固定间隔。固定间隔重试的问题是,100 个客户端同时在 1s 后重试,还是会打成一个流量尖峰。指数退避加随机抖动(jitter)能把重试流量打散:第一次等 1s + 随机抖动,第二次等 2s + 随机抖动,以此类推。

最大重试次数设 3-5 次,超出后返回错误给上层,由业务层决定要不要降级或告知用户。无限重试只是在推迟失败,还在占用系统资源。

高可用方案五:用聚合平台做兜底

前面四种方案都需要自己实现,对小团队来说维护成本不低。更轻量的选择是使用 API 聚合平台,把这套高可用逻辑外包出去。

聚合平台在入口层统一处理 fallback、负载均衡、限速保护。对业务代码来说,只需要调一个接口,后面的逻辑是透明的。出问题时,平台侧处理,不穿透到你的应用。

Ofox.ai 是其中一个选项,聚合了 100+ 模型,入口统一在 api.ofox.ai,OpenAI 兼容接口无缝切换。对于不想自己维护 fallback 逻辑、需要快速接入多家模型的团队,聚合平台能省掉大量基础设施工作。关于平台对比,《OpenRouter 替代方案:OfoxAI vs OpenRouter 对比》里有详细的功能和价格对比。

几种场景的推荐配置

实时对话产品,用户交互频繁:主模型设短超时(3-5s),快速 fallback 到轻量模型;不建议用户等待超过 5s,宁可降级也不等;加流式输出(streaming),首 token 出来就开始渲染。

批量处理任务,非实时,吞吐量重要:多 Key 轮询,摊薄限速压力;设较长超时(30-60s),优先质量而非速度;失败后加入重试队列,不影响主流程。

企业 AI 网关,多团队共用:必须做请求路由和配额隔离,一个团队的暴力调用不能影响其他团队;加完整的日志和告警,异常请求率超阈值立即通知。

更多企业级接入的坑和解法,可以看《公司项目接入 AI API 要避开哪些坑?》。

什么情况下 99.9% SLA 可以实现

不少团队问能不能保证 99.9% 可用性。答案是:单靠官方 API 不行,但加上应用层兜底是可以做到的。

99.9% 意味着一个月内允许宕机约 43 分钟。主流 AI API 官方承诺的 SLA 通常在 99-99.5% 之间,高峰期还有计划外抖动。如果你的业务要求更高:

- 主备模型覆盖不同厂商,一家宕机不影响另一家

- 至少有一个国内直连的模型作为最终兜底,延迟稳定,不受海外网络影响

- 监控 API 可用率,异常时自动切换,不依赖人工干预

这三条叠起来,应用侧的可用性能推到 99.9% 以上。某家 API 短暂故障,用户基本感知不到。

稳定性问题开始靠运气扛,规模上去之后就是纯工程问题了。fallback 链、负载均衡、熔断,每一层都在把故障的影响范围往小了压。越早做,后来救火的成本就越低。