AI API 中转站推荐 2026:主流平台对比评测,哪家最靠谱?

先说结论

2026 年值得认真对比的 AI API 中转站,就这四家:ofox.ai、302.ai、硅基流动(SiliconFlow)、灵芽 AI。

没有一家能吃所有场景。各有侧重,选错了确实会掉坑。

四家平台核心指标对比

| 维度 | ofox.ai | 302.ai | 硅基流动 | 灵芽 AI |

|---|---|---|---|---|

| 模型数量 | 81 个主流模型 | 500+ 模型 | 80+ 开源模型 | 50+ 模型 |

| Claude 支持 | 原生 Anthropic 格式 | 支持 | 弱 | 支持 |

| GPT-5.4 | 完整支持,$2.5/M 输入 | 支持 | 不支持 | 支持 |

| Gemini 3.1 | 支持 | 支持 | 不支持 | 支持 |

| 开源模型 | Qwen、DeepSeek 主流 | 广泛覆盖 | 最全 | 一般 |

| 国内直连 | 稳定 | 稳定 | 稳定 | 稳定 |

| 支付方式 | 支付宝、微信、USDT | 支付宝、微信 | 微信、支付宝 | 支付宝、微信 |

| OpenClaw 集成 | 原生支持 | 手动配置 | 手动配置 | 手动配置 |

| Claude Code | 原生 Anthropic 端点 | 有限支持 | 不支持 | 有限支持 |

| API 格式 | OpenAI + Anthropic 双格式 | OpenAI 兼容 | OpenAI 兼容 | OpenAI 兼容 |

| 免费试用 | 新用户赠送测试额度 | 有免费模型 | 部分模型免费 | 有免费额度 |

ofox.ai

如果你用 Claude Code、OpenClaw、Cursor 或 Cline,ofox.ai 是配置最省事的选项,没有之一。

原因很具体:OpenClaw 的 Onboard 向导里直接有 ofox.ai 选项,选完填 Key 就行,不需要手动写 base_url。Claude Code 用的是 Anthropic SDK 格式,ofox.ai 同时支持 OpenAI 和 Anthropic 两种接口,省了一层适配。这类细节别的平台没做到。

模型方面当前 81 个,覆盖 GPT-5.4($2.5/M 输入)、GPT-5.4 Mini($0.75/M,400K 上下文)、GPT-5.4 Nano($0.2/M)、Claude 全系、Gemini 3.1 系列,以及 MiniMax M2.5/M2.7、DeepSeek V4、GLM-5、Qwen3.6 Plus、Grok 4.1。

适合:用 AI 编程工具的开发者;需要稳定调用 Claude 和 GPT 旗舰模型;不想折腾信用卡。

302.ai

模型数量最多,500+ 个,包括大量社区微调版本和实验性模型。需要快速测试多种模型、做横向对比的研究者会比较喜欢。

不过模型多不代表质量整齐。主流模型(GPT-5.4、Claude 系列)调用正常,部分小众模型的可用性和延迟参差不齐。OpenClaw、Claude Code 集成需要手动配置,没有 ofox.ai 那么开箱即用。

适合:需要广泛测试多种模型;对小众或实验性模型有需求。

硅基流动(SiliconFlow)

开源模型覆盖最全,DeepSeek 系列、Qwen 系列、Llama 系列基本都有,而且价格往往比其他平台低。很多模型在 SiliconFlow 甚至可以免费调用(有限速)。

缺点明确:不支持 Claude 和 GPT-5.4。如果项目核心依赖这两类模型,SiliconFlow 满足不了。

适合:开源模型为主的项目;成本敏感型应用;对 Claude/GPT 无硬性依赖。

灵芽 AI

国内较早做 AI API 中转的平台,有一定用户基础,模型覆盖 50+ 个,主流模型基本齐全。

文档和社区资源相对少,新手上手体验不如前面几家。对于已经在用且运行稳定的用户,没有特别理由主动迁移。

按场景选

用 Claude Code / OpenClaw 做 AI 编程 → ofox.ai。原生集成,省去所有配置麻烦。

研究多种模型,需要广泛测试 → 302.ai 模型选择最多;专攻开源模型就选 SiliconFlow。

开源模型应用,注重成本 → SiliconFlow,价格和覆盖都是最优。

主流闭源模型 + 国内支付 + 低延迟 → ofox.ai。

几条选择中转站的务实建议

价格差异在真正上规模前影响有限。稳定性、延迟、工具兼容性才是日常开发中的实际障碍,这些优先于 $0.1/M 的差价。

按需充值,账户不要预充太多。主流平台跑路风险极低,但保持合理余额是正常习惯。

大多数平台都提供免费额度,用自己真实的典型 prompt 跑一遍,比看评测文章准得多。

相关文章

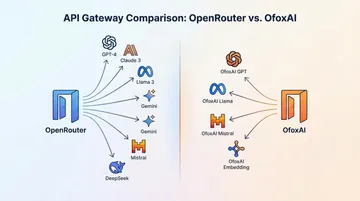

- OpenRouter 使用完全指南 2026:从 OpenRouter 过来的,这篇有详细迁移步骤

- OpenClaw 初始化配置完全指南:OpenClaw + ofox.ai 的最快配置路径

- AI API 报错大全:切换平台后遇到的常见报错

- OpenRouter 替代方案:OfoxAI vs OpenRouter:专门针对 OpenRouter 用户的迁移指南