Grok 4.1 API 国内接入指南:2M 上下文 + 多智能体协作,xAI 全线模型实战体验(2026)

为什么现在该关注 Grok

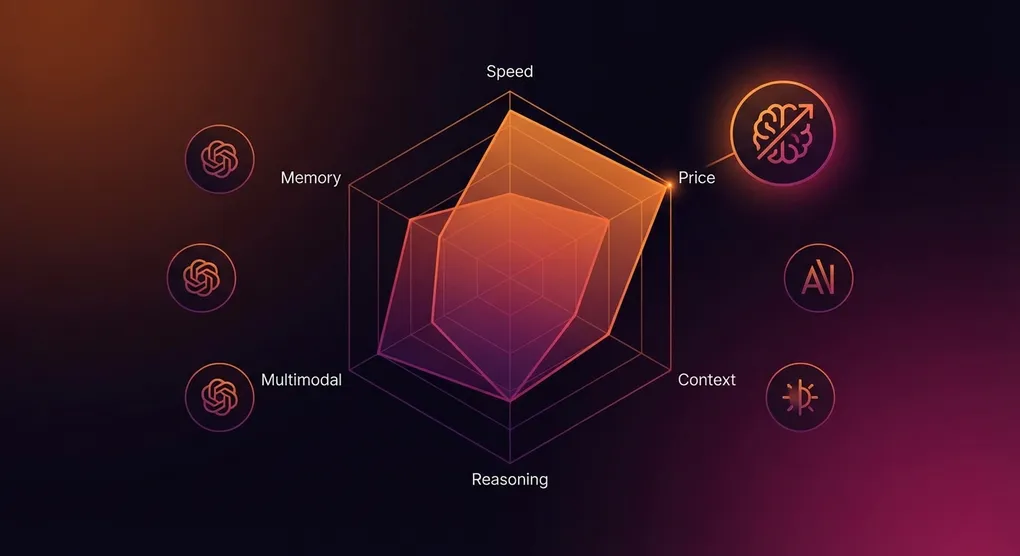

去年说起 Grok,大多数人的印象还停留在「Elon Musk 的 Twitter 玩具」。今年不一样了。Grok 4.1 在 LMArena 文本竞技场推理模式排名第一,幻觉率降了 65%,上下文窗口 2M tokens,是 GPT-5.4(128K)的 15 倍多。

然后是 Grok 4.20 Beta。这东西不是一个模型,是四个。你调一次 API,背后有四个角色在分头干活再汇总结果。API 层面直接暴露多智能体架构,不用你自己搭编排框架。

下面说清楚 Grok 全线模型有什么能力、怎么接 API、国内开发者怎么用。

Grok 全线模型一览

xAI 目前的产品线分三块:文本、图片、视频。

| 模型 | 定位 | 输入价格 | 输出价格 | 上下文 | 说明 |

|---|---|---|---|---|---|

| grok-4-1-fast | 日常主力 | $0.20/M | $0.50/M | 2M | 便宜,速度快 |

| grok-4.20 | 旗舰推理 | $2.00/M | $6.00/M | 2M | 深度思考模式 |

| grok-4.20-multi-agent | 多智能体 | $2.00/M | $6.00/M | 2M | 4 Agent 协同 |

| grok-imagine-image-pro | 图片生成 | $0.07/张 | - | - | 文本生图、图片编辑 |

| grok-imagine-video | 视频生成 | $0.05/秒 | - | - | 文本/图片转视频 |

语言模型全部支持 function calling、structured output、图片输入。缓存命中时输入价格低至 $0.05/M,省 75% 以上。

Grok 4.1 Fast:$0.20 价位能买到什么

输入 $0.20/M,比 GPT-5.4-mini 还便宜,但上下文窗口是它的 15 倍。几个值得说的能力:

reasoning 和 non-reasoning 两种模式可以切换。通过 X 平台集成能拿到实时数据,这点其他模型做不到,知识截止日期的限制在 Grok 这里不存在。工具调用方面,Web Search、X Search、Code Execution、Document Search 四种内置工具,每千次 $2.50-$5。缓存是自动的,不用你配置,重复前缀自动命中。

同价位($0.20 级别)的模型里,Grok 4.1 Fast 的上下文窗口最大,还带实时搜索。这两点加一起,在 RAG 和实时问答场景下很有吸引力。

Grok 4.20 Multi-Agent:四个角色分头干活

目前市面上唯一在 API 层面直接暴露多智能体架构的模型。你调一次,背后四个角色在跑:

- Grok 负责协调,理解你要什么,把任务拆给其他三个

- Harper 做信息检索和事实核查

- Benjamin 处理数学和逻辑推理

- Lucas 专门唱反调,挑刺、提反面论点,减少幻觉

实际用下来,做市场调研和技术选型时效果比单模型好一截。你不用自己设计多轮 prompt 去模拟不同视角,模型层面就帮你做了。

价格 $2.00/$6.00,比 4.1 Fast 贵 10 倍。日常任务不值得,但在需要高准确性的分析场景,这个溢价能接受。

和其他模型比,Grok 贵不贵

把主要模型的价格拉在一起:

| 模型 | 输入 $/M | 输出 $/M | 上下文 | SWE-Bench | 适合场景 |

|---|---|---|---|---|---|

| Grok 4.1 Fast | 0.20 | 0.50 | 2M | ~70% | 日常编程、RAG、实时搜索 |

| GPT-5.4-mini | 0.75 | 3.00 | 128K | 54% | 轻量级任务 |

| DeepSeek V4 | 0.30 | 0.50 | 1M | 81% | 编程、长文本 |

| Claude Sonnet 4.6 | 3.00 | 15.00 | 200K | 65% | 编程、写作 |

| Grok 4.20 | 2.00 | 6.00 | 2M | - | 复杂推理、多角度分析 |

| Claude Opus 4.6 | 15.00 | 75.00 | 200K | 62% | 极致质量 |

| Gemini 3.1 Pro | 1.25 | 5.00 | 2M | 55% | 超长文档、多模态 |

几个直观感受:

Grok 4.1 Fast 和 DeepSeek V4 是最便宜的两个,但 Grok 上下文窗口是 DeepSeek 的 2 倍。如果你的场景需要处理长文档,这个差距很实在。Grok 4.20 Multi-Agent 的多智能体架构目前没有第二家在 API 层面做。另外别忽略缓存:Grok 缓存命中只要 $0.05/M,如果你的 system prompt 很长且固定不变,实际成本会比表面价格低很多。

国内接入方案

国内开发者调 Grok API 面临两个问题:网络访问和支付方式。以下是三条路径,按推荐度排序。

方案一:API 聚合平台中转(推荐)

通过 OfoxAI 等聚合平台中转,走 OpenAI 兼容协议,改 base_url 就能用。支持支付宝/微信,人民币结算,国内直连不需要额外网络配置。同一个 API Key 能调 Grok、Claude、GPT 等 100+ 模型。

接入三步:

- 在 ofox.ai 注册账号,获取 API Key

- 设置

base_url为https://api.ofox.ai/v1 model参数填grok-4-1-fast(或其他 Grok 模型名)

用 OpenAI SDK 调用的核心配置:

client = OpenAI(

api_key="你的-ofox-api-key",

base_url="https://api.ofox.ai/v1"

)

response = client.chat.completions.create(

model="grok-4-1-fast",

messages=[{"role": "user", "content": "你好"}]

)如果你之前用过 GPT 或 Claude 的 OpenAI 兼容接口,切到 Grok 就是改一个 model 参数的事。想了解更多 API 聚合平台的对比,可以参考这篇 OpenRouter 替代方案分析。

方案二:xAI 官方直连

如果你有海外信用卡和稳定的网络环境:

- 到 x.ai/api 注册,新用户送 $25 额度

- 参与数据共享计划(Data Sharing Program)每月额外 $150

- 直接调用

https://api.x.ai/v1端点

官方的优势是模型更新最快、支持 Live Search 和 X Search 等独家功能。但对国内用户来说,网络稳定性和支付方式是硬伤。

方案三:OpenRouter 等第三方中转

OpenRouter 等平台也提供 Grok 模型的中转服务,但对国内用户来说同样存在支付和网络问题,不如方案一方便。

Grok 适合什么场景

参数说完了,聊聊实际干活的体验。

实时信息检索

Grok 通过 X 平台拿到了实时数据。你问它「今天 A 股怎么样」,它能给你当天的信息。其他模型的知识截止日期是固定的,这一点 Grok 确实不一样。做新闻聚合、舆情监控、实时问答类应用的时候,少了一层「先搜索再塞进 prompt」的操作。

超长文档处理

2M 上下文窗口,约 150 万汉字。整个代码仓库、完整的法律合同、几十万字的调研报告,一次性塞进去就行。不用做分块检索(chunking),不用担心切分时丢关键信息。代码审查和文档分析的体验比 128K 的模型好很多,这没什么好争的。

技术选型和竞品调研

Grok 4.20 Multi-Agent 的四智能体架构在这类场景表现不错。一次调用能拿到正方观点、反方质疑、事实核查的结果,不用自己写多轮 prompt 模拟不同视角。当然价格也是 4.1 Fast 的 10 倍,看场景决定。

AI 编程

如果你在用 OpenClaw 之类的工具,可以直接把 Grok 4.1 Fast 配为后端模型。配置方法见 OpenClaw 模型配置教程。2M 上下文处理大型项目时不用手动筛选相关文件,整个 repo 放进去就好。更多 AI 编程工具的对比可以看这篇横评。

图片和视频生成

xAI 也有多媒体生成 API。grok-imagine-image-pro $0.07 一张,grok-imagine-image $0.02 一张(轻量版),grok-imagine-video $0.05 一秒。价格在同类里不算贵。如果你在比较图片生成方案,可以看看 AI 图片生成 API 对比 这篇,Gemini、DALL·E、Flux 都有覆盖。

Grok API 常见问题排查

调用过程中可能遇到的几个典型问题:

429 Too Many Requests:Grok 默认限速 10M TPM + 1,800 RPM。如果频繁触发,考虑加 retry + exponential backoff,或者通过聚合平台的负载均衡绕过单端点限制。更多 API 报错处理方案见 AI API 报错排查手册。

响应延迟高:Grok 4.20 Multi-Agent 因为要协调四个 Agent,首字延迟(TTFT)会比 4.1 Fast 高不少。如果对延迟敏感,日常任务用 4.1 Fast,只在需要深度分析时切 4.20。

缓存没生效:Grok 的缓存是自动的,但只对 prompt 前缀匹配有效。确保 system prompt 放在最前面且内容不变,对话历史追加在后面。检查 API 响应的 usage 字段里的 cached_tokens 确认缓存是否命中。

总结一下

4.1 Fast 在 $0.20 价位给了最大的上下文窗口和实时搜索,4.20 Multi-Agent 是目前唯一在 API 层暴露多智能体协作的产品。值不值得用,取决于你的场景。

国内接入走 OfoxAI 中转最省事,OpenAI 兼容协议,支付宝/微信付款,改个参数就能切模型。注册地址:ofox.ai。

其他模型的接入可以看这几篇: