Kimi 2.6 发布:256K 上下文 + 视频理解,benchmark 超越 Claude Opus 4.6,ofox 第一时间接入

TL;DR — Kimi K2.6 今天发布,256K 上下文、原生视频输入、长程编码稳定性全面升级,benchmark 超过 Claude Opus 4.6。ofox 第一时间接入,模型 ID moonshotai/kimi-k2.6,现有 Key 直接可用。

Kimi 2.6 是什么

月之暗面今天发布了 K2.6,K2.5 的直接升级版。官方重点说了两件事:长程代码编写更稳,指令遵循更准。

距离 K2.5 发布不到两个月。月之暗面这个迭代节奏,不让人睡觉。

核心参数

| 能力 | K2.6 |

|---|---|

| 上下文窗口 | 256K tokens(全系列统一) |

| 多模态输入 | 文本 + 图片 + 视频 |

| 推理模式 | Thinking / Non-thinking |

| Agent 支持 | 多步工具调用,自主执行 |

| 编程语言 | Rust、Go、Python、前端、DevOps |

256K 上下文,但这次是真的稳

256K tokens 大概是 20 万汉字,够把一个中型项目的源码、文档、测试文件全塞进去。

K2.5 也支持 256K,但 K2.6 改的不是窗口大小,是在长上下文下的稳定性。能放多少是一回事,放了之后模型还能不能保持指令遵循和代码质量是另一回事。长程编码任务里最容易翻车的就是这里。

原生多模态:视频也能理解了

K2.6 是原生多模态架构,不是后期拼上去的视觉模块。

图片支持 png、jpeg、webp、gif,建议不超过 4K。视频输入支持(具体格式和限制见 platform.moonshot.ai 官方文档),token 按关键帧动态计算。大文件走文件上传接口,不受请求体大小限制。

分析录屏、走查 UI、看演示视频,这些场景现在可以直接扔给 K2.6。

长程编码:Rust/Go/Python

官方点名了 Rust、Go、Python,加上前端和 DevOps。这几个方向对长程推理要求最高:

Rust 的所有权和生命周期,一个错误可能牵连十几处修改。Go 的并发模式需要全局一致性。Dockerfile 和 CI/CD 配置上下文依赖强,改一处要看全局。

K2.6 在这些场景下的稳定性提升,是对实际工程需求的直接回应,不是 benchmark 刷分。

Thinking 模式

两种模式按需选:

Non-thinking 直接输出,速度快,适合简单问答和代码补全。Thinking 模式先内部推理再输出,适合复杂逻辑、数学、多步骤代码生成。

开启 Thinking 时工具调用有限制,根据任务类型选。

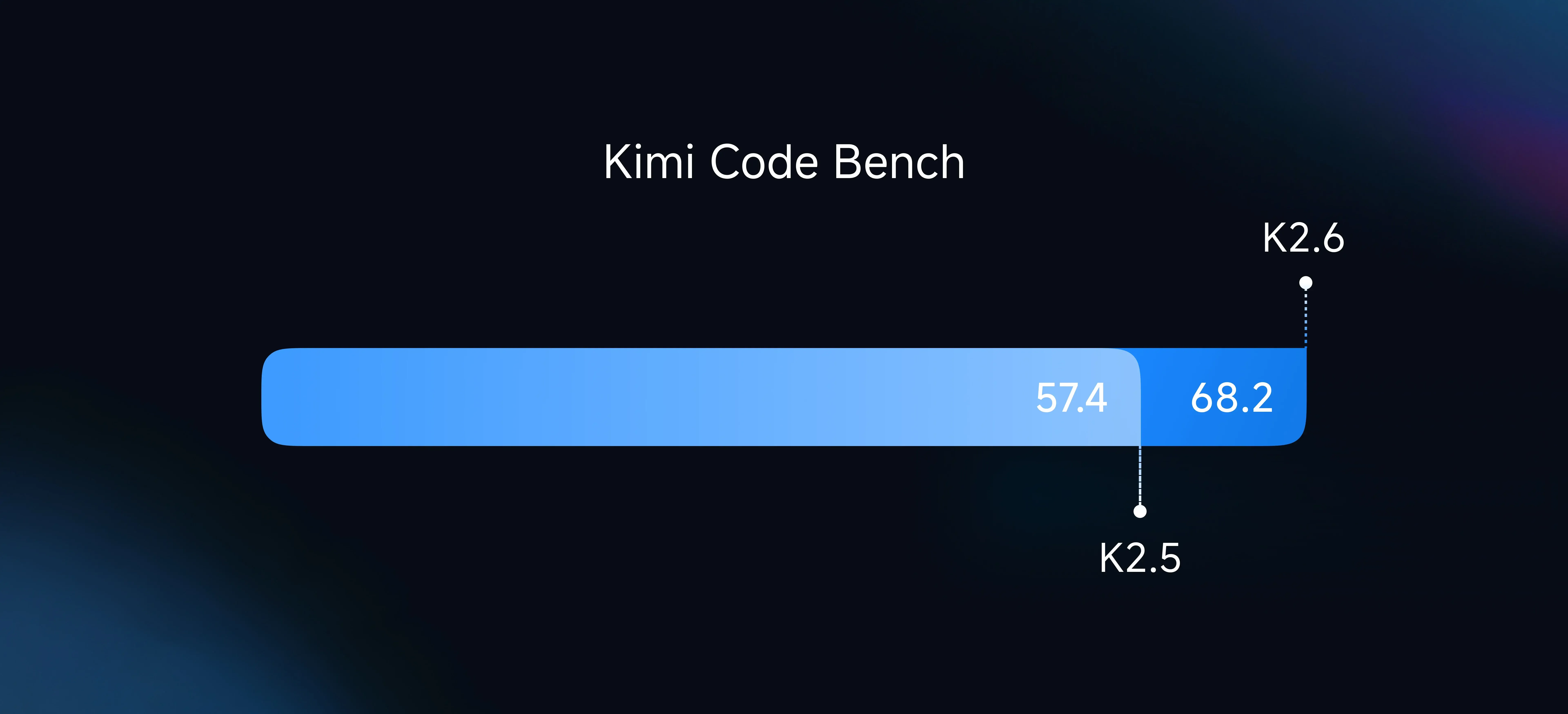

Benchmark:超过 Claude Opus 4.6

月之暗面官方发布了完整的 benchmark 对比数据,K2.6 在编码和 Agent 任务上明显领先 Claude Opus 4.6:

| Benchmark | K2.6 | Claude Opus 4.6 | GPT-5.4 |

|---|---|---|---|

| SWE-Bench Pro | 58.6 | 53.4 | 57.7 |

| Terminal-Bench 2.0 | 66.7 | 65.4 | 65.4 |

| DeepSearchQA (f1) | 92.5 | 91.3 | 78.6 |

| HLE-Full w/ tools | 54.0 | 53.0 | 52.1 |

| LiveCodeBench v6 | 89.6 | 88.8 | — |

| AIME 2026 | 96.4 | 96.7 | 99.2 |

编码核心指标 SWE-Bench Pro(真实代码库修复任务)K2.6 以 58.6 超过 Opus 4.6 的 53.4,差距明显。

来源:Kimi 官方 benchmark,2026-04-21

通过 ofox 接入

ofox 第一时间接入了 K2.6。已经在用 ofox 的话,改一行 model 就行:

from openai import OpenAI

client = OpenAI(

api_key="your-ofox-key",

base_url="https://api.ofox.ai/v1"

)

response = client.chat.completions.create(

model="moonshotai/kimi-k2.6",

messages=[{"role": "user", "content": "用 Rust 写一个并发文件处理器"}]

)

print(response.choices[0].message.content)开启 Thinking 模式:

response = client.chat.completions.create(

model="moonshotai/kimi-k2.6",

messages=[{"role": "user", "content": "分析这段代码的性能瓶颈并给出优化方案"}],

extra_body={"thinking": {"type": "enabled"}}

)还没有 ofox Key 的话,去 ofox.ai 注册,一个 Key 接入 Claude、GPT、Gemini、Kimi、MiniMax 等所有主流模型。

K2.5 还是 K2.6

现在在用 K2.5,要不要切?

长程编码任务(超过 50K tokens 上下文、多文件修改)建议切 K2.6,稳定性提升明显。简单问答和短代码补全,两者差异不大,按价格选。需要视频理解就必须用 K2.6,K2.5 不支持。Agent 工作流的话,K2.6 的多步工具调用更稳。

K2.6 的 token 定价与 moonshot-v1 系列保持一致,具体价格看 ofox 模型页。