Qwen3.6-27B vs Claude Opus 4.6 写代码:本地 27B 模型能替代 $25/M 的 API 吗?

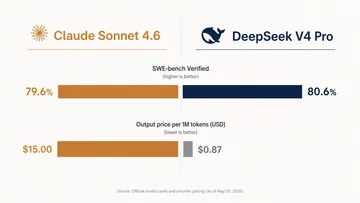

TL;DR — Qwen3.6-27B 在 SWE-bench Verified 上拿到 77.2,Claude Opus 4.6 是 80.8,差距不到 4 个百分点;但前者 Apache 2.0 开源、一张 RTX 4090 就能跑,后者输出 token 卖 $25/M。本地跑 vs 走 API 怎么选,主要看你每月写多少代码、要不要 1M 上下文、能不能容忍 GPU 启动成本。本文用真实定价和 benchmark 数据算一遍账。

两个模型,一句话定位

Claude Opus 4.6 是 Anthropic 当前主力编程模型,只走闭源 API,SWE-bench Verified 拿 80.8%,输入 $5/M、输出 $25/M(Anthropic 官方定价),原生 1M token 上下文。

Qwen3.6-27B 是阿里 2026-04-22 放出来的 27B dense 模型,Apache 2.0 开源,SWE-bench Verified 77.2%,原生 262K 上下文(YaRN 能扩到 ~1M),文本+图像+视频三模态。Q4_K_M 量化后约 16.8 GB,一张 RTX 4090 就够(来源)。

题外话:网上很多帖子说”Opus 是 $15/M token”,那是 Opus 4.1 的老价。从 4.5 起降到了 $5/$25,本文以此为准。

一、benchmark 差几个点,到底意味着什么

先把核心数据摆齐:

| 指标 | Qwen3.6-27B | Claude Opus 4.6 |

|---|---|---|

| SWE-bench Verified | 77.2 | 80.8 |

| SWE-bench Pro | 53.5 | 未公开 |

| Terminal-Bench 2.0 | 59.3 | 未公开 |

| 原生上下文 | 262K | 1M |

| 输入价 / M token | 本地免费 | $5 |

| 输出价 / M token | 本地免费 | $25 |

| 多模态 | 文+图+视频 | 文+图 |

| 协议 | Apache 2.0 | 商业 API |

Qwen 官方说的”27B 击败 397B”意思是超过自家上一代 MoE 旗舰 Qwen3.5-397B-A17B,不是说它超过了 Opus 4.6。两件事不要混淆。

实际感受:在最严格的多文件、跨仓库重构场景下,那 3.6 个百分点的差距会被放大——大概是 100 个真实 PR 里,Qwen 修不动而 Opus 能修的,比 Opus 修不动而 Qwen 修得动的多 3-4 个。

但反过来想,77.2 这个数字本身已经能干掉两年前所有商业旗舰。GPT-4 Turbo 的 SWE-bench Verified 才 38。十八个月时间,开源模型走了一大段路。

二、成本账:一个重度开发者一个月花多少

假设一个典型的 AI Coding 重度用户:每天 100 万 input + 30 万 output token(用 Cursor / Claude Code / Roo Code 写代码、读 codebase、生成测试),一个月 22 个工作日。

走 Claude Opus 4.6 API:

input : 22 × 1.0M × $5 = $110

output : 22 × 0.3M × $25 = $165

月成本 : $275 ≈ ¥1,990

年成本 : ¥23,880本地跑 Qwen3.6-27B(RTX 4090 24GB):

显卡 : RTX 4090 二手 ¥10,000-12,000(按 ¥11,000 算)

电费 : 全负载 450W × 8h × 22 天 = 79.2 度,按 ¥0.6/度 ≈ ¥48/月

月成本 : ¥48

回本期 : 11,000 / (1990 - 48) ≈ 5.7 个月如果你愿意走 ofox 这种聚合 API(同时支持 Claude 和开源模型),把重活给 Opus、把补全和测试给国产开源模型,可以再压一档。

混合方案估算(80% 用 Qwen-class 模型、20% 用 Opus):

80% × 国产开源 API(约 $0.6/$3.6)= 22 × 0.8M × 0.6 + 22 × 0.24M × 3.6 ≈ $30

20% × Opus 4.6 = 22 × 0.2M × 5 + 22 × 0.06M × 25 ≈ $55

月成本 : ~$85 ≈ ¥615大部分团队最后都会落到类似方案:不买显卡、不维护推理服务,只在硬骨头上烧贵 token。一样的思路在 Claude Opus 4.6 vs Sonnet 4.6 的选型拆解 里也讲过。

三、本地部署清单:一张 4090,半小时跑通

Qwen3.6-27B 量化后的显存需求(数据来源:Unsloth GGUF + 社区实测):

| 量化 | 显存 | 建议显卡 |

|---|---|---|

| Q4_K_M | 17.5 GB | RTX 4090 24GB(舒服)/ M4 Pro 24GB+(4080 16GB 装不下) |

| Q5_K_M | 20.5 GB | RTX 4090 24GB / M4 Max 36GB |

| Q6_K | 23.2 GB | RTX 4090 24GB(紧)/ RTX 5090 32GB |

| Q8_0 | 28.7 GB | RTX 5090 32GB / M4 Max 36GB+ |

KV cache 默认上下文再加 1-3 GB;如果要把上下文撑到 256K 以上,留 8-12 GB 余量。

推荐路径:先 Q4_K_M 起步,体验差不多再上 Q6_K。

llama.cpp 最小启动命令:

# 下载 GGUF(约 17.5 GB)

huggingface-cli download bartowski/Qwen_Qwen3.6-27B-GGUF \

--include "Qwen_Qwen3.6-27B-Q4_K_M.gguf" --local-dir ./models

# 启动 server(OpenAI 兼容 API)

./llama-server -m ./models/Qwen_Qwen3.6-27B-Q4_K_M.gguf \

-c 32768 --host 0.0.0.0 --port 8080注意一个坑:截至 2026-05,Ollama 还没原生支持 Qwen3.6 用到的独立 mmproj 视觉文件。要用多模态能力,请走 llama.cpp、LM Studio、vLLM ≥0.19.0 或 SGLang ≥0.5.10。

Cursor / Roo Code / Cline 接入:把 API Base URL 指向 http://localhost:8080/v1,Key 随便填,Model 写 qwen3.6-27b,就能像调 OpenAI 一样调本地模型。具体步骤参考 Roo Code API 配置完整教程。

四、什么场景下 Opus 4.6 仍然换不掉

Qwen3.6-27B 已经很能打,但有几类活我还是会优先扔给 Opus 4.6:

跨整个 monorepo 的大规模重构。 Opus 4.6 原生 1M 上下文,一次性把一个中等仓库塞进去就行。Qwen 虽然 YaRN 也能撑到接近 1M,但 KV cache 会膨胀到 20-40 GB,单卡装不下,要么上多卡,要么把上下文砍半,体验立刻打折。

Vision 任务。 Qwen3.6-27B 确实多模态,但在 UI 截图理解、复杂图表抽取、PDF OCR 后的语义重建这几件事上,Opus 还是稳一档。同样的策略选择在国产模型里也成立,可参考 MiniMax M2.7 vs Claude Opus 编程对比。

多步骤 agent 编排。 Opus 4.6 在 tool use 链路里参数纠错、自我修正都更老练。这套机制本身怎么用,function calling / tool use 完全教程 讲得比较细。

不想做运维。 本地模型意味着你要管驱动版本、CUDA 兼容、量化精度、KV cache 显存、并发队列。这些时间值多少钱,自己拍。

五、什么场景 Qwen3.6-27B 是更优解

隐私 / 合规 / 离线。 金融、医疗、政企客户的 codebase 不能出公司网,本地模型基本是唯一答案。Apache 2.0 商用零顾虑,比某些”开源但商用要授权”的模型省心。

高频但简单的任务。 代码补全、单测生成、commit message、变量重命名、日志解析、SQL 翻译。这种活一天发生几百次,用 Opus 跑就是在烧钱;本地模型边际成本几乎为零,跑就完事。

大规模批量改写。 5000 个老 JavaScript 文件批改 TypeScript、2 万个函数补 docstring、整个项目注释翻译——挂上本地推理,下班前提交脚本,第二天早上来看结果,API 账单零。

做研究 / 想折腾权重本身。 fine-tune、看 logits、hack prompt template、做对齐实验,这些事开源权重让你能做的比闭源 API 多一个数量级。想看更宏观的开源 vs 闭源选型,戳 2026 大模型排行榜与选型指南。

六、混合方案:本地 + API 互补

务实的团队基本不会二选一,而是按任务难度做路由:

# 一个最小可用的路由示例

def pick_model(task_type: str, file_count: int, total_loc: int):

if task_type in ("autocomplete", "rename", "format", "lint_fix"):

return "qwen3.6-27b-local" # 本地,零成本

if file_count > 20 or total_loc > 50_000:

return "claude-opus-4-6" # 大上下文 + 强推理

if task_type == "test_generation":

return "qwen3.6-27b-local"

if task_type in ("debug_complex", "architect", "review"):

return "claude-opus-4-6"

return "qwen3.6-27b-local" # 默认走便宜的用 ofox.ai 这类聚合 API 平台的好处是:一个 Key、一个 OpenAI 兼容接口同时挂 Claude、Qwen、GPT、Gemini,路由层不用维护多份 SDK。Claude 系列在国内不翻墙怎么用,Claude Code 国内使用 + Opus 4.6 编程体验 写过完整路径。

类似地,Cursor 3 自定义 API 配置教程 演示过怎么让一个 Cursor 同时挂本地模型和云端 API,按文件类型切。

一句话结论

Qwen3.6-27B 在 80% 的日常编码场景已经能替代 Opus 4.6,剩下 20% 的硬骨头留高端 API 兜底就行。

- 个人开发者:年用量低于 $300 选 API;超过 $1500 考虑本地

- 企业:合规要求是硬约束,其他都是成本表上的数字

- 不想纠结:用聚合 API,按调用按量付费,等用量稳定下来再决定要不要自建

ofox.ai 是一站式 AI API 聚合平台,统一 OpenAI 兼容接口,Claude、GPT、Gemini、Qwen、Kimi 等主流模型一个 Key 全调。不想给每家模型注册账号、不想为美元付款发愁、又想灵活切模型省 token 的,可以去 ofox.ai 看看。

参考资料:

- Qwen3.6-27B 官方发布:qwen.ai/blog?id=qwen3.6-27b

- Qwen3.6-27B Hugging Face:huggingface.co/Qwen/Qwen3.6-27B

- Claude Opus 4.6 官方定价:platform.claude.com/docs/en/about-claude/pricing

- Claude Opus 4.6 System Card(2026-02):Anthropic 官方 PDF

- SWE-bench Verified Leaderboard:swebench.com