2026 免费 LLM API 额度横评:Gemini / xAI / DeepSeek / AWS Bedrock,哪家真能写代码?

TL;DR — 四家免费额度逻辑完全不同:Gemini 永久免费但 RPM/RPD 锁得紧,适合长期小规模玩;xAI Grok 首月最多 $175 但 $150 那部分要数据共享,写商业代码慎用;DeepSeek 新户 500 万 token 一次性赠送,加上 V4 Pro 五月底前 75% off,是密集开发期性价比最高的选择;AWS Bedrock 通过 $200 通用 starter credits 间接覆盖 Claude/Nova,但 6 个月过期且要走 IAM/区域配置。下面把四家的”能跑多少代码”算清楚。

为什么”免费额度”不能只看美元数字

每家厂商定义”免费”的方式不一样。看四个关键变量:

- 时间窗口:永久免费 / 一次性赠送 / N 个月内有效

- 限速形式:按 RPM/RPD 限速 / 按累计 token 配额 / 按金额 credit

- 隐私代价:要不要数据共享 / 内容会不会被用于训练

- 真实可用 token 量:换算成”写一个完整 CRUD 项目能跑几遍”才有意义

只看”$25 vs $200”会误判。$200 一次性、6 个月过期的 credit,和”每天 1500 次 Flash 调用”是两种完全不同的产品形态。

Gemini API:永久免费 + 没有信用卡门槛

Google AI Studio 的免费层是四家里最特殊的一个:不需要绑定信用卡,永久有效,但限速很死。

限额怎么看

Google 在 2025 年底改了规则,不再公开一张静态的免费层限额表。官方文档只说”限额因模型、用量层级、项目、地区而异,请到 AI Studio 仪表盘查看”。

先说一个容易踩的坑:Gemini 3.1 Pro Preview 是付费独占模型,没有免费层。Google 官方 pricing 页面对 3.1 Pro 的 Free tier 显示「Not available」。免费层主要覆盖 2.5 Flash、2.5 Flash-Lite、2.5 Pro 三个稳定版,加上 3.1 Flash-Lite(同样标注 free tier 可用)。

社区和第三方观测到的大致区间(以 AI Studio 实际显示为准):

| 模型 | RPM | RPD | TPM |

|---|---|---|---|

| Gemini 2.5 Flash | 约 15 | 约 1,500 | ~1M |

| Gemini 2.5 Flash-Lite | 约 15 | 约 1,000 | ~1M |

| Gemini 2.5 Pro | 约 5 | 约 50 | ~250K |

| Gemini 3.1 Flash-Lite | 免费可用,限额以仪表盘为准 | — | — |

2.5 Pro 的 50 RPD 真的紧,平均一天 50 次对话就上限了。Flash 类的 1500 RPD 在个人项目里基本够用。想用 3.1 Pro 必须升级到付费 tier。

写代码场景能跑多远

假设一个典型的 AI 编程会话:每轮对话约 3K 输入 token、1K 输出 token。

- 2.5 Flash:1500 RPD ≈ 1500 轮对话 / 天,按 4K token 算累计 600 万 token / 天

- 2.5 Pro:50 RPD ≈ 50 轮对话 / 天,累计 20 万 token / 天

写一个中等复杂度的项目,用 Flash 跑一整天调试 + 重构是足够的;2.5 Pro 一天 50 次只能挑关键节点用。想要 3.x 代的体验只能升付费。

实际坑点

免费层默认会把你的请求内容拿去改进产品,付费层才不参与。商业代码慎用这个层。

限额按 GCP 项目维度统计,不是按 API Key。同一个项目里建多个 key 不能叠加配额,想多薅一份得新开项目。

15 RPM 在 IDE 插件场景容易卡。Cursor、Continue 这类工具一次操作可能并发发 3-5 个请求,免费层很容易触发 429。

适合:个人学习、原型验证、低频调用的小工具。

xAI Grok:首月最多 $175,但要付代价

xAI 的免费方案分两层:注册赠送 + 数据共享激励。

钱怎么拿

- 新账户注册:$25 一次性 credits

- 数据共享计划:每月 $150 credits,最多累计 $150(不滚存)

- 加入数据共享的前提:账户已经实际付费消费至少 $5

也就是说,新用户最便利的路径是:先充值 $5 走起步流程,再开通数据共享拿 $150,加上注册的 $25,首月可用 $175。第二个月开始数据共享继续给 $150,但前提是数据共享开关一直保持开启。

数据共享意味着什么

xAI 的数据共享条款明确:开启后,你发送给 API 的请求内容和模型返回的响应都会进入 xAI 的训练管道,用于改进 Grok 模型。

写代码场景里,这件事的影响视情况而定:

- 写自家产品的核心业务逻辑、含 NDA 的客户代码、未公开的算法 → 不要开

- 写公开教程、个人玩具项目、Open Source 项目 → 可以开

- 处理用户个人数据(PII) → 法律和合规上有风险,不要开

$25 注册 credit 没有这个限制,但用完就没了,无法续。注意现在的旗舰模型是 Grok 4.3($1.25/M 输入、$2.50/M 输出,xAI 官方文档),旧版 Grok 4 / Grok 4.1 Fast 在 2026 年 5 月 15 日下线。按 Grok 4.3 价格折算,$25 大约能跑 2000 万输入 token,够做一两个完整的小项目。

写代码场景能跑多远

按 Grok 4.3 当前 $1.25/$2.50 价格计(5:1 输入输出比):

- $25 credits:约 1400 万输入 + 280 万输出 token(纯输入折算约 2000 万)

- $175 一个月(含数据共享):约 1 亿输入 + 2000 万输出 token

数据共享额度对个人开发者来说算得上”巨额”,但前提是你能接受隐私代价。

适合:不在意数据训练的玩家、写公开项目的开发者、跑评测和 benchmark 的研究者。

DeepSeek:500 万 token 一次性 + V4 Pro 75% off 折扣窗口

DeepSeek 的免费策略是”一次性大额赠送 + 长期低价”。

免费额度

新账户注册即送 500 万 token 余额,可用于任意 DeepSeek 模型。自注册日起 30 天内有效,过期未用完会清零。

按 V4 Flash 价格折算:500 万 token 大约等于 $0.7 的赠送价值。听起来不多,但 V4 Flash 本身就便宜:$0.14/M 输入、$0.28/M 输出。

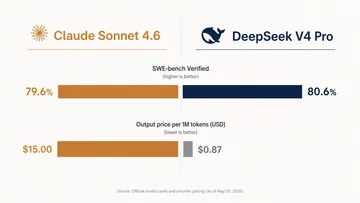

V4 Pro 五月底前还有 75% off

DeepSeek V4 Pro 在 2026 年 5 月 31 日 15:59 UTC 之前都是 75% off 折扣价:

| 模型 | 输入(cache miss) | 输出 | Cache hit |

|---|---|---|---|

| V4 Flash | $0.14/M | $0.28/M | $0.0028/M |

| V4 Pro(折扣中) | $0.435/M | $0.87/M | $0.003625/M |

cache hit 价格自 2026 年 4 月 26 日起调到 launch 价的 1/10。换算到现行价格,V4 Flash cache hit 只要 cache miss 的 1/50,V4 Pro cache hit 更夸张——折扣价基础上还能压两个数量级,写代码场景里 system prompt 命中缓存的情况能直接把成本打到几乎免费。

写代码场景能跑多远

仅用 500 万赠送 token 跑 V4 Pro(折扣价):

- 按 4:1 输入输出比折算,大约能跑 400 万输入 + 100 万输出 token

- 等价于约 1000 轮中等长度对话

- 完整开发一个小项目(含调试)够用

赠送用完后充 $10 还能跑 V4 Pro 约 2300 万输入 token,这个单价在所有头部模型里是最低的。

适合:短期密集开发期、做大量 batch 处理、对单价敏感的个人开发者。

AWS Bedrock:$200 通用 credits,6 个月窗口

AWS 没有 Bedrock 专属免费层,但通过 AWS 通用免费体系间接覆盖 Bedrock 上的 Claude、Nova、Llama 等模型。

Credits 怎么拿

- 新 AWS 账户注册:$100 starter credit(2025 年 7 月 15 日之后新户)

- 完成 AWS 引导任务(部署 EC2/RDS/Lambda/Bedrock 等示例):再拿 $100

合计 $200,可用于 Bedrock 在内的 200+ AWS 服务,6 个月过期不展期。

写代码场景能跑多远

Bedrock 上 Claude / Nova 的价格和直连 Anthropic API 完全一致:

| 模型 | 输入价格 | 输出价格 |

|---|---|---|

| Claude Sonnet 4.6 | $3/M | $15/M |

| Claude Opus 4.7 | $15/M | $75/M |

| Amazon Nova Pro | $0.8/M | $3.2/M |

| Amazon Nova Lite | $0.06/M | $0.24/M |

用 $200 credit 跑 Claude Sonnet 4.6(按 3:1 输入输出比):约 3300 万输入 + 1100 万输出 token,能撑住一个中等规模项目几个月的密集开发。

但有几个坑:

- 要走 IAM 配置 + region 选择 + model access 申请,不是注册即用

- 6 个月窗口是从注册日算,不是从激活 Bedrock 算。先用 Bedrock 越早越好

- Claude 模型不是所有 region 都有,us-east-1 / us-west-2 覆盖最全

- 没有”试用余额”提醒,credit 烧完后会直接按市价计费

适合:已经在 AWS 上做 IaC、对企业级合规有要求、需要 Bedrock Guardrails 等周边能力的团队。

四家横评:同样 $0 起步,能跑出多少代码

把”能写多少代码”作为单一维度,给一个粗略对比(按 Cursor / Aider 这类 IDE 场景估算):

| 维度 | Gemini 2.5 Flash 免费层 | xAI Grok 4.3($25 注册) | xAI Grok 4.3($175 含数据共享) | DeepSeek(500 万 token) | AWS Bedrock($200 credit) |

|---|---|---|---|---|---|

| 期限 | 永久 | 一次性 | 月度(需保持数据共享) | 30 天 | 6 个月 |

| 隐私代价 | 内容会用于改进产品 | 无 | 数据用于训练 | 无 | 无 |

| 实际 token 量 | 约 600 万 / 天 | 约 1400-2000 万输入 | 约 1 亿输入 | 约 400-500 万 | 约 3300 万 token(Sonnet 4.6) |

| 完整项目数量 | 长期可写无限多个 | 2-3 个 | 10+ 个 | 1 个完整项目 | 3-5 个 |

| 配置门槛 | 最低(API key 即用) | 低(注册即用) | 中(需先充值 $5) | 最低 | 高(IAM + region) |

| 信用卡 | 不需要 | 需要 | 需要 | 不需要 | 需要 |

按场景给建议

个人学习、长期跑小工具 → Gemini 2.5 Flash 永久免费层(想要 3.1 Pro 体验得升付费)。1500 RPD 配额对个人开发者基本够用,也不用管什么时候过期。

短期一次性集中开发一个项目 → DeepSeek 新账户 500 万 token 加上 V4 Pro 五月底折扣。这两个叠起来在 2026 年 5 月底前是头部模型里最便宜的方案。

写公开项目、Open Source、不在意请求被用于训练 → xAI 数据共享方案,每月 $150 的 token 量碾压其他三家,前提是你能接受数据代价。

已经在 AWS 生态、有企业合规要求 → Bedrock 的 $200 通用 credits。要赶在 6 个月窗口内用完,但好处是可以顺便覆盖 Lambda、S3 这些周边服务。

通过 ofox 统一调用三家(Bedrock 除外)

四家里 Gemini、xAI、DeepSeek 三家都在 ofox.ai 上架,可以用同一个 OpenAI 兼容 API 切换:

from openai import OpenAI

client = OpenAI(

api_key="your-ofox-api-key",

base_url="https://api.ofox.ai/v1"

)

# Gemini 3.1 Pro Preview

resp = client.chat.completions.create(

model="google/gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "..."}]

)

# Grok 4.20

resp = client.chat.completions.create(

model="x-ai/grok-4.20",

messages=[{"role": "user", "content": "..."}]

)

# DeepSeek V4 Pro

resp = client.chat.completions.create(

model="deepseek/deepseek-v4-pro",

messages=[{"role": "user", "content": "..."}]

)AWS Bedrock 不上架,因为 Bedrock 的卖点本来就是 AWS 生态绑定,单独走代理意义不大。

ofox 长期价格:旗舰模型享 20% off,开源类模型最高享 70% off,没有月费,支持支付宝充值。

模型清单和实时价格见 ofox.ai/zh/models。

怎么把免费额度榨干

四家都试一遍后,有几个共通的省钱技巧值得提一下。

Gemini 免费层按 GCP 项目维度限速,不同项目可以独立叠加配额。DeepSeek 没有家庭账号检测,但要求手机号唯一。AWS 新户 credit 不允许通过新建账户重复领取,违规会封号 — 别折腾这个。

DeepSeek 的 cache hit 价是 cache miss 的 2%(V4 Flash)或更低(V4 Pro 折扣价基础上再压两个数量级),写代码场景里 system prompt 和文件上下文经常命中,开 caching 能把成本直接降到接近免费。Gemini Pro 也支持 implicit caching,默认开启。

不是所有任务都得用 Pro。Gemini Flash-Lite 比 Flash 的 RPM 翻倍且价格更低,写自动化脚本完全够用。DeepSeek V4 Flash 写脚手架代码也没问题,遇到真需要推理的关键决策再切 V4 Pro。

Gemini 免费层在欧美时区高峰(UTC 14:00 到 22:00)容易触发额外的服务端限流,跑批的话错峰会顺很多。