Windsurf AI 编程完全教程:配置 ofox API 接入所有模型(2026)

TL;DR — Windsurf 2026 版支持 BYOK 自定义 API,填入 ofox.ai 的 Base URL 和 Key 就能调用 GPT-5.4、Claude Opus 4.7 等全模型,绕过 credits 限制且成本更低。本文从安装到实战配置完整走一遍。

Windsurf 被 Cognition 收购后已经不是原来那个 Codeium 了。Cascade Agent 会自己扫描代码库、列计划、改文件,不是那种你问一句它答一句的聊天机器人。2026 年 2 月它拿了 LogRocket AI 开发工具排行榜第一,ARR 干到 8200 万美元。没试过的可以看看,试过但卡在 API 配置上的,这篇文章帮你搞定。

安装与初体验

Windsurf 支持 macOS、Windows 和 Linux。去官网下载安装包,或者直接用 Homebrew:

brew install --cask windsurf第一次启动会引导你登录 Codeium 账号。免费版每月 25 个 credits,够跑几个小任务感受下 Cascade 的能力。建议直接找个真实项目打开,不要只在 demo 里玩——Cascade 的优势在大型代码库里才明显。

打开项目后,左侧边栏找到 Cascade 图标(一个闪电符号),点击就能开始对话。默认用的是 Windsurf 托管的模型,credits 从这里开始扣。

为什么要配自定义 API

Windsurf 的 credits 体系用起来有点糟心。同一个请求,有时候扣 1 个 credit,有时候扣 3 个,规则不透明。Pro 版 $20/月的额度,重度用户两周就烧完,剩下半个月干瞪眼。更烦的是模型选择受限,GPT-5.4 或 Claude Opus 4.7 这种最新的不一定给你用。

BYOK(Bring Your Own Key)就是拿自己的 API Key 接进去,按实际 token 付费,模型随便换,成本通常比 Windsurf 的 credits 低 30%-50%。

配置 ofox API:三步搞定

ofox.ai 是 OpenAI 兼容的 API 网关,一个 Key 就能调用 GPT-5.4、Claude Opus 4.7、Gemini 3.1 Pro、DeepSeek V4 等 100+ 模型。Windsurf 里配置很简单。

第一步:获取 ofox API Key

去 ofox.ai 注册账号,进入控制台复制 API Key。新用户有免费额度,可以先跑起来再决定充不充值。

第二步:打开 Windsurf 自定义 API 设置

快捷键 Cmd + ,(macOS)或 Ctrl + ,(Windows/Linux)打开设置,搜索 “Custom API” 或 “BYOK”。找到以下三个字段:

- Base URL:填

https://api.ofox.ai/v1 - API Key:填你从 ofox 控制台复制的 Key

- Model:填你想用的模型 ID

ofox 支持的模型 ID 与官方一致,常用的几个:

| 模型 | ofox 模型 ID | 适合场景 |

|---|---|---|

| GPT-5.4 | openai/gpt-5.4 | 通用代码生成、复杂逻辑 |

| Claude Opus 4.7 | anthropic/claude-opus-4.7 | 大型重构、架构设计 |

| Claude Sonnet 4.6 | anthropic/claude-sonnet-4.6 | 日常编码、快速迭代 |

| Gemini 3.1 Pro | google/gemini-3.1-pro-preview | 长上下文、多模态任务 |

| DeepSeek V4 | deepseek/deepseek-v4-pro | 数学推理、算法题 |

模型 ID 可以在 ofox 控制台的模型列表页查看,选错了会报 model not found 错误。

第三步:验证连接

配置完点保存,然后在 Cascade 里发一条简单消息,比如 “解释一下这个文件的作用”,把光标放在任意代码文件上。如果看到正常回复而不是报错,说明配置成功。

常见的配置错误:

- Base URL 末尾少了

/v1。ofox 的 API 兼容 OpenAI 格式,路径必须是https://api.ofox.ai/v1,不是https://api.ofox.ai - 模型 ID 拼写错误。比如把

anthropic/claude-opus-4.7写成claude-opus-4.7(少了 provider 前缀) - Key 复制不全。有些终端会截断长字符串,建议直接从 ofox 控制台点击复制按钮

遇到报错可以参考《AI API 报错排查完全指南》,里面覆盖了 429、401、500 等常见错误码的排查方法。

多模型切换实战

配好 ofox API 之后,模型切换基本零成本。不同任务换不同模型,效率差很多。

场景一:日常编码用 Claude Sonnet 4.6

Sonnet 4.6 的速度和代码质量平衡得最好,适合写新功能、修 bug、写测试。在 Windsurf 设置里把 Model 改成 anthropic/claude-sonnet-4.6,Cascade 的回复会快很多。

场景二:大型重构用 Claude Opus 4.7

Opus 4.7 的上下文窗口和推理能力更强,做跨文件重构时不容易”改了 A 忘了 B”。把 Model 改成 anthropic/claude-opus-4.7,然后给 Cascade 一个复杂指令,比如:

把项目里的所有回调函数改成 async/await,包括错误处理逻辑

Opus 4.7 会扫描整个代码库,列出修改计划,逐个文件执行,最后检查遗漏。

场景三:算法和数学用 DeepSeek V4

DeepSeek V4 在数学推理和算法题上表现突出。遇到需要复杂计算或算法设计的任务,切到 deepseek/deepseek-v4-pro,结果通常比通用模型更靠谱。

场景四:长文档处理用 Gemini 3.1 Pro

Gemini 3.1 Pro 的上下文窗口达到 1M tokens,适合处理大型日志文件、批量代码审查、或者把整个代码库丢进去做架构分析。模型 ID 是 google/gemini-3.1-pro-preview。

切换模型不用重新配 Key,改个 Model 字段保存就行。比在 OpenAI、Anthropic、Google 之间来回切方便太多。

Cascade Agent 进阶用法

API 配好了,Cascade 还有几个功能值得挖一下。

Flow Awareness(流感知)

Cascade 会追踪你的编辑历史和光标位置。比如你刚改完一个组件的 props 定义,它会主动提示你更新所有引用这个组件的地方。不需要你手动搜索,Cascade 已经知道”你刚做了什么”。

Memories(记忆系统)

在项目根目录创建 .windsurfrules 文件,告诉 Cascade 你的项目规范:

- 使用 TypeScript,严格模式

- 组件命名用大驼峰

- API 调用统一放在 services/ 目录

- 优先使用 async/await,避免回调Cascade 会记住这些规则,后续的建议都会按这个风格来。用得越久,建议越贴合你的项目。

MCP 扩展

2026 年初 Windsurf 加了 MCP(Model Context Protocol)支持,可以连接外部工具。比如连上数据库 MCP,Cascade 不仅能改代码,还能直接查数据库验证修改是否正确。连上 API MCP,可以自动测试接口。

MCP 的配置在设置里找到 “MCP Servers”,添加 server 的 URL 和认证信息。如果你在用 OpenClaw,它的 MCP 生态很丰富,可以直接对接。

成本对比:BYOK vs Windsurf Pro

算笔账。Windsurf Pro $20/月,credits 烧完要么等下个月,要么再掏钱。BYOK 按实际 token 付费,用多少付多少。

中等强度开发者,每天 200 次调用,平均每次 2K tokens:

| 方案 | 月费用 | 模型选择 | 超出后 |

|---|---|---|---|

| Windsurf Pro | $20 | 有限 | 额外付费或停等 |

| ofox BYOK | ~$12-18 | 100+ 模型 | 继续用,按量扣 |

BYOK 还有个不容易注意到的好处:自动故障转移。ofox 有多个上游节点,某个模型挂了会自动切到备用节点,不耽误事。直连官方 API 的话,OpenAI 或 Anthropic 抽风你就只能等着。

常见问题

Q:配置 BYOK 后 Windsurf 的 credits 还扣吗? A:不扣。BYOK 模式下所有 API 调用走你自己的 Key,Windsurf 的 credits 只在你用托管模型时消耗。

Q:ofox 的延迟怎么样? A:ofox 在国内有直连节点,延迟通常比直连 OpenAI/Anthropic 低 50% 以上。具体速度取决于你所在的网络环境。

Q:可以同时配置多个模型吗? A:Windsurf 目前一次只能设置一个自定义模型,但切换很快——改个 Model 字段保存就行,不需要重新填 Key。

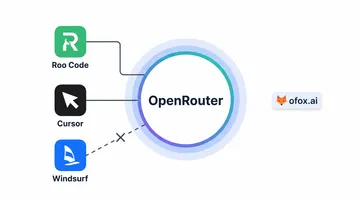

Q:和 Cursor 的 BYOK 有什么区别? A:两者都支持 BYOK,但 Windsurf 的 Cascade Agent 在自主规划上更强,Cursor 的 Tab 补全更即时。API 配置方式几乎一样,参考《Cursor、Claude Code、Cline 自定义 API 配置教程》。

总结

Windsurf 的 Cascade Agent 确实好用,但 credits 限制和模型选择受限让人头疼。配了 ofox API 之后,100+ 模型随便换,按量付费成本可控,国内节点延迟也更低。

已经在用 Windsurf 的,花 5 分钟配个 BYOK,体验明显提升。还在 Cursor 和 Windsurf 之间犹豫的,我的建议是两个都装——写新代码用 Cursor,大规模重构切 Windsurf Cascade,所有工具共用同一个 ofox Key,模型想换就换。关于 AI 编程工作流怎么搭,可以看《Vibe Coding 完全指南》。