OpenRouter 接入 Cursor/Windsurf/Roo Code 完全教程(2026)

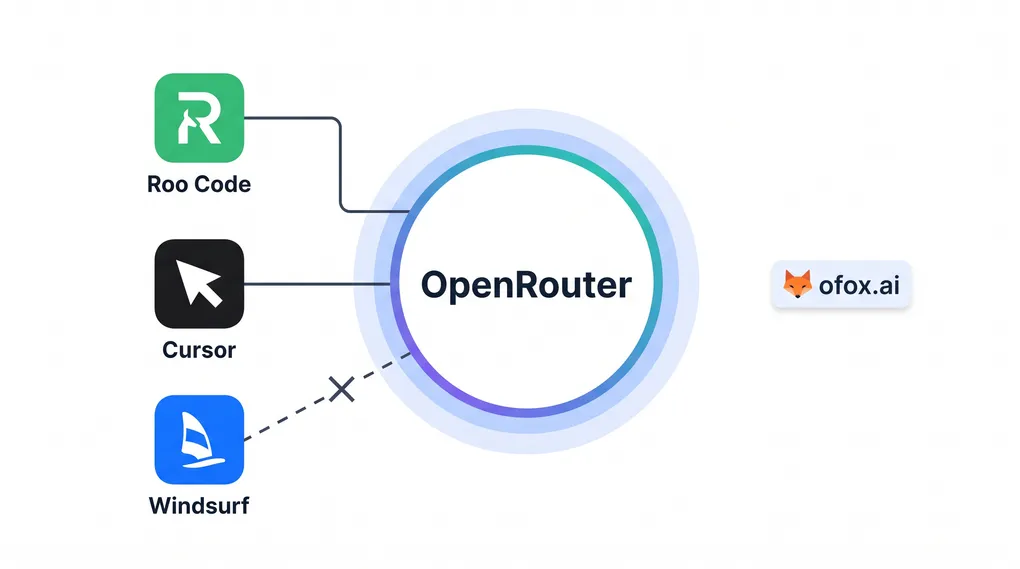

TL;DR — Roo Code 原生支持 OpenRouter,三步完成配置;Cursor 需要手动覆盖 base URL,Agent 模式有 BYOK 限制;Windsurf 目前不支持 OpenRouter,只能用 Anthropic BYOK。对延迟和支付方式有要求的开发者,ofox.ai 是更顺手的替代选择。

三款工具的 OpenRouter 支持情况

用 OpenRouter 接入 AI 编程工具,目的很简单:一个 Key 调所有模型,不用给每家厂商单独注册账号。但三款工具的支持程度差很多:

| 工具 | OpenRouter 支持 | 配置难度 | Agent 模式限制 |

|---|---|---|---|

| Roo Code | ✅ 原生支持 | 低 | 无 |

| Cursor | ✅ 手动配置 | 中 | 有(BYOK 限制) |

| Windsurf | ❌ 不支持 | — | — |

三款工具的对比见下表,下面逐一说配置方法。如果你在选工具,可以先看 Vibe Coding 工具横评。

Roo Code 接入 OpenRouter

Roo Code 内置了 OpenRouter 作为 API Provider 选项,不需要手动填 base URL,是三款里最省事的。

步骤:

- 点击 Roo Code 面板右上角的齿轮图标,打开设置

- 在 “API Provider” 下拉菜单里选 OpenRouter

- 把 OpenRouter API Key 粘贴到 “OpenRouter API Key” 字段

- 在 “Model” 下拉菜单里选目标模型

配置完成后 Roo Code 会自动拉取模型列表。支持 prompt caching 的模型(Claude Sonnet 3.7、Haiku 4.5 等)会自动启用缓存。Gemini 系列需要在 provider 设置里手动勾选 “Enable Prompt Caching”,否则响应会变慢。

更多 Roo Code 配置细节参考 Roo Code API 配置完整教程。

Cursor 接入 OpenRouter

Cursor 没有内置 OpenRouter 选项,但支持覆盖 OpenAI 的 base URL,可以接入任何 OpenAI 兼容的 API。

步骤:

- 打开 Cursor 设置(

Ctrl+Shift+J或点击右上角齿轮图标) - 找到 “OpenAI API Key” 区域,开启并填入你的 OpenRouter API Key

- 开启 “Override OpenAI Base URL”,填入:

https://openrouter.ai/api/v1 - 点击 ”+ Add Custom Model”,输入 OpenRouter 的模型 ID,格式是

provider/model-name,例如:anthropic/claude-sonnet-4.6 moonshotai/kimi-k2.6 deepseek/deepseek-v3.2 - 在 Chat(

Ctrl+L)或 Composer(Ctrl+I)里选刚添加的模型

Cursor 3 的 Agent 模式对 BYOK 有限制,Worktree、Design Mode 等功能在用自定义 Key 时可能无法正常工作。如果你主要用 Agent 模式,参考 Cursor 3 自定义 API 配置完全指南 里的应对方案。

Windsurf:目前不支持 OpenRouter

Windsurf 的 BYOK 功能目前只支持 Anthropic 的四个 Claude 模型(Claude 4 Sonnet、Claude 4 Sonnet Thinking、Claude 4 Opus、Claude 4 Opus Thinking),配置入口在 windsurf.com/subscription/provider-api-keys。

OpenRouter 不在支持列表里。如果你想在 Windsurf 里用 GPT、Gemini、DeepSeek 或 Kimi 等模型,目前没有官方途径。

Windsurf 的详细使用方法可以参考 Windsurf AI 编程完全教程。

用 ofox.ai 替代 OpenRouter

对于 Windsurf 用户,以及对 OpenRouter 延迟不满意的 Cursor/Roo Code 用户,ofox.ai 是个更直接的选择。

ofox.ai 使用 OpenAI 兼容格式,base URL 为 https://api.ofox.ai/v1,支持 80+ 模型,包括 Claude Opus 4.7、GPT-5.4、Gemini 3.1 Pro、DeepSeek V3.2、Kimi K2.6、MiniMax M2.7 等。

在 Roo Code 里配置 ofox.ai:

- API Provider 选 “OpenAI Compatible”

- Base URL 填

https://api.ofox.ai/v1 - API Key 填 ofox.ai 的 Key

- 模型 ID 格式:

anthropic/claude-sonnet-4.6(与 ofox.ai 模型列表一致)

在 Cursor 里配置 ofox.ai:

步骤和接入 OpenRouter 一样,把 base URL 换成 https://api.ofox.ai/v1,API Key 换成 ofox.ai 的 Key。

在 Windsurf 里配置 ofox.ai:

Windsurf 不支持自定义 base URL,无法直接接入 ofox.ai 或 OpenRouter。目前只能用 Windsurf 内置的 Cascade 模型,或通过 BYOK 使用 Claude 模型。

延迟方面,ofox.ai 通常在 200-500ms,OpenRouter 直连延迟在 1500ms 以上。支付方面,ofox.ai 支持支付宝/微信,OpenRouter 只支持外币信用卡。详细对比参考 OpenRouter 替代方案:OfoxAI vs OpenRouter 对比。

常见报错排查

Cursor 提示 “Invalid API Key”: 检查 base URL 是否正确覆盖。OpenRouter Key 格式是 sk-or-v1-xxx,不要和 OpenAI Key 混淆。

Roo Code 提示 “401 Unauthorized”: Key 可能已过期或额度耗尽,去 openrouter.ai 控制台重新生成一个。

模型 ID 不对导致 404: OpenRouter 的模型 ID 格式是 provider/model-name,完整列表在 openrouter.ai/models。Cursor 里添加自定义模型时要填完整 ID,不能只填模型名。

更多 API 报错排查参考 AI API 报错大全。

小结

Roo Code 配 OpenRouter 最省事,Cursor 需要手动覆盖 base URL 但 Agent 模式有限制,Windsurf 目前不支持 OpenRouter。

如果你需要在多款工具里统一用一个 Key 调所有模型,ofox.ai 的 OpenAI 兼容接口在 Cursor 和 Roo Code 里都能用,延迟和支付方式对国内开发者更友好。OpenRouter 的优势是模型数量(400+),适合需要测试冷门模型的场景。

关于 OpenRouter 的完整使用方法,参考 OpenRouter 使用完全指南。