Images API

エンドポイントは2つ:生成(テキスト → 画像)、編集(画像 + テキスト → 画像)。レスポンスはいずれも OpenAI 標準構造の data[0].b64_json です。

Gemini 系列の画像モデル(google/gemini-3.1-flash-image-preview など)は、このエンドポイントでは生成のみ可能で、編集はできません。編集する場合は Gemini ネイティブプロトコル をご利用ください。

画像を生成

POST https://api.ofox.ai/v1/images/generationsgpt-image-2 を使う

Python

import base64

from openai import OpenAI

client = OpenAI(api_key="YOUR_OFOX_API_KEY", base_url="https://api.ofox.ai/v1")

resp = client.images.generate(

model="openai/gpt-image-2",

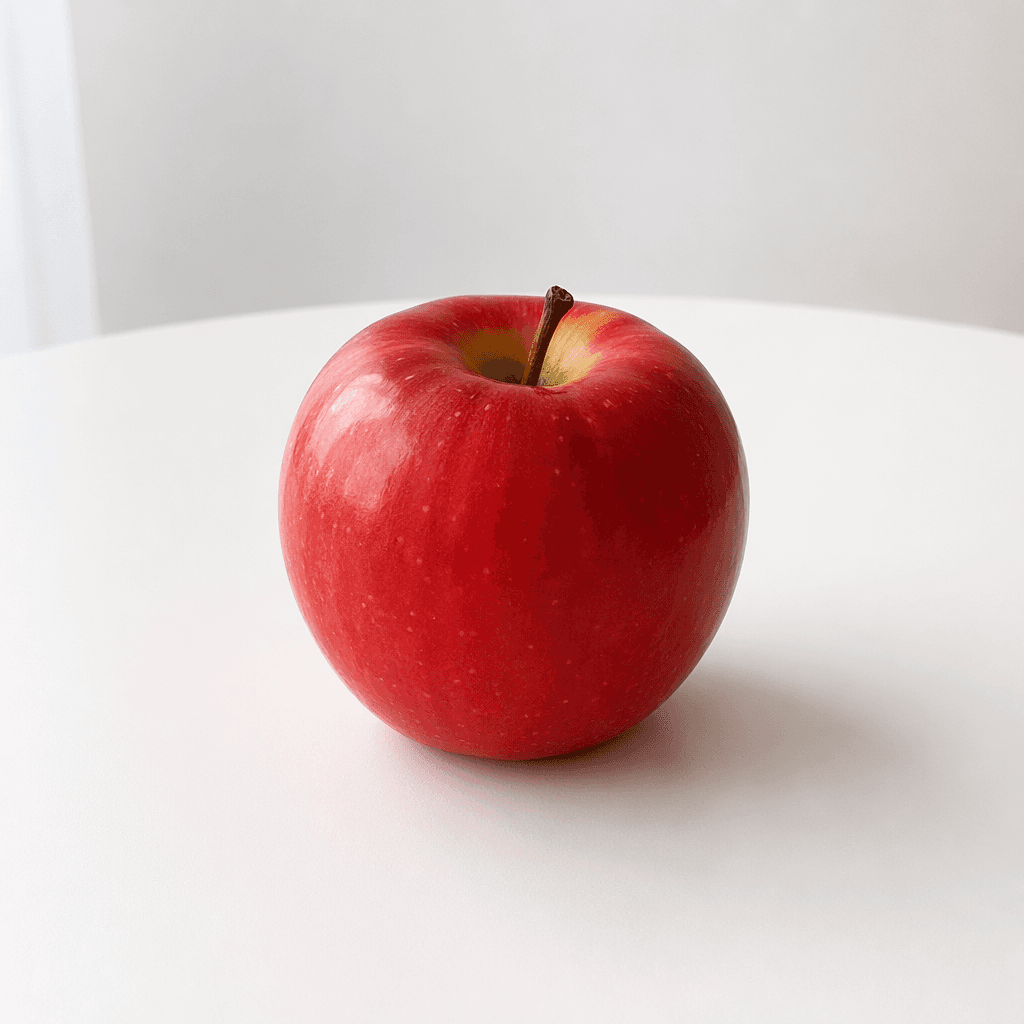

prompt="A simple red apple on a white table",

size="1024x1024",

quality="low",

output_format="png",

)

with open("output.png", "wb") as f:

f.write(base64.b64decode(resp.data[0].b64_json))実際の出力:

gemini-3.1-flash-image-preview を使う

同じエンドポイントは Gemini 画像モデルにも対応します。n を渡してはいけません——ゲートウェイが n を numberOfImages フィールドへ誤マッピングして 400 エラーになります。1リクエストにつき固定で 1 枚生成されます。

Python

import base64

from openai import OpenAI

client = OpenAI(api_key="YOUR_OFOX_API_KEY", base_url="https://api.ofox.ai/v1")

resp = client.images.generate(

model="google/gemini-3.1-flash-image-preview",

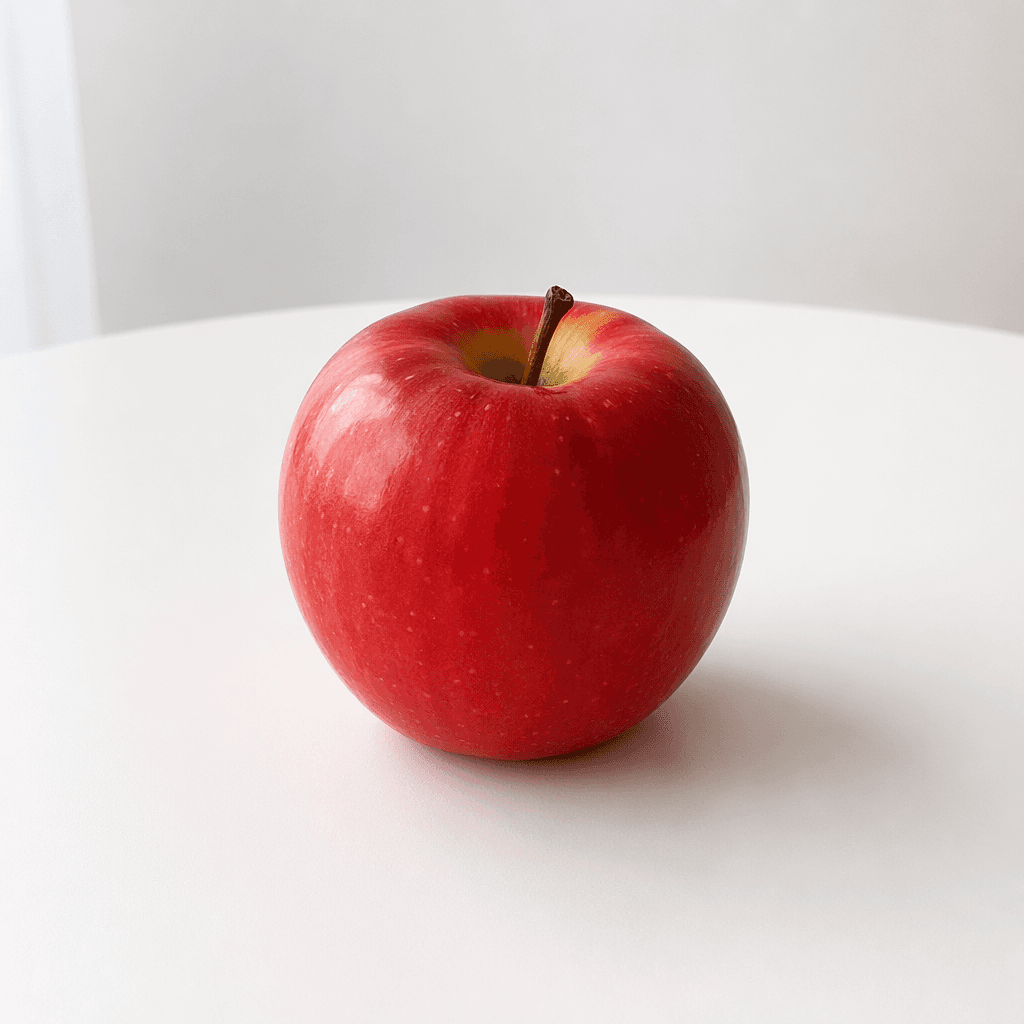

prompt="A simple red apple on a white table, photorealistic",

size="1024x1024",

quality="low",

output_format="png",

)

with open("output.png", "wb") as f:

f.write(base64.b64decode(resp.data[0].b64_json))実際の出力:

パラメータ

| パラメータ | 型 | 必須 | 説明 |

|---|---|---|---|

model | string | ✅ | openai/gpt-image-2、google/gemini-3.1-flash-image-preview |

prompt | string | ✅ | 自然言語による説明 |

quality | string | ✅ | auto / low / medium / high / standard / hd |

n | number | — | 1〜10、デフォルト 1。Gemini モデルは非対応 |

size | string | — | auto / 1024x1024 / 1536x1024 / 1024x1536 / 256x256 / 512x512 / 1792x1024 / 1024x1792 |

output_format | string | — | png / jpeg / webp |

background | string | — | transparent / opaque / auto |

stream | boolean | — | デフォルト false |

レスポンス

{

"created": 1777385517,

"data": [

{ "b64_json": "<画像 Base64>", "index": 0 }

],

"model": "openai/gpt-image-2",

"size": "1024x1024",

"quality": "low",

"usage": {

"input_tokens": 14,

"input_tokens_details": { "text_tokens": 14 },

"output_tokens": 208,

"total_tokens": 222

}

}画像は data[0].b64_json に格納されているので、Base64 デコードして保存してください。

画像を編集

POST https://api.ofox.ai/v1/images/editsmultipart/form-data で、画像ファイルのアップロードが必要です。

このエンドポイントは OpenAI / Azure OpenAI モデルのみ対応です。google/gemini-3.1-flash-image-preview を呼び出すと Image editing is not supported for model が返ります——Gemini ネイティブプロトコルでの画像編集 に切り替えてください。

呼び出し

Python

import base64

from openai import OpenAI

client = OpenAI(api_key="YOUR_OFOX_API_KEY", base_url="https://api.ofox.ai/v1")

with open("apple.png", "rb") as f:

resp = client.images.edit(

model="openai/gpt-image-2",

image=f,

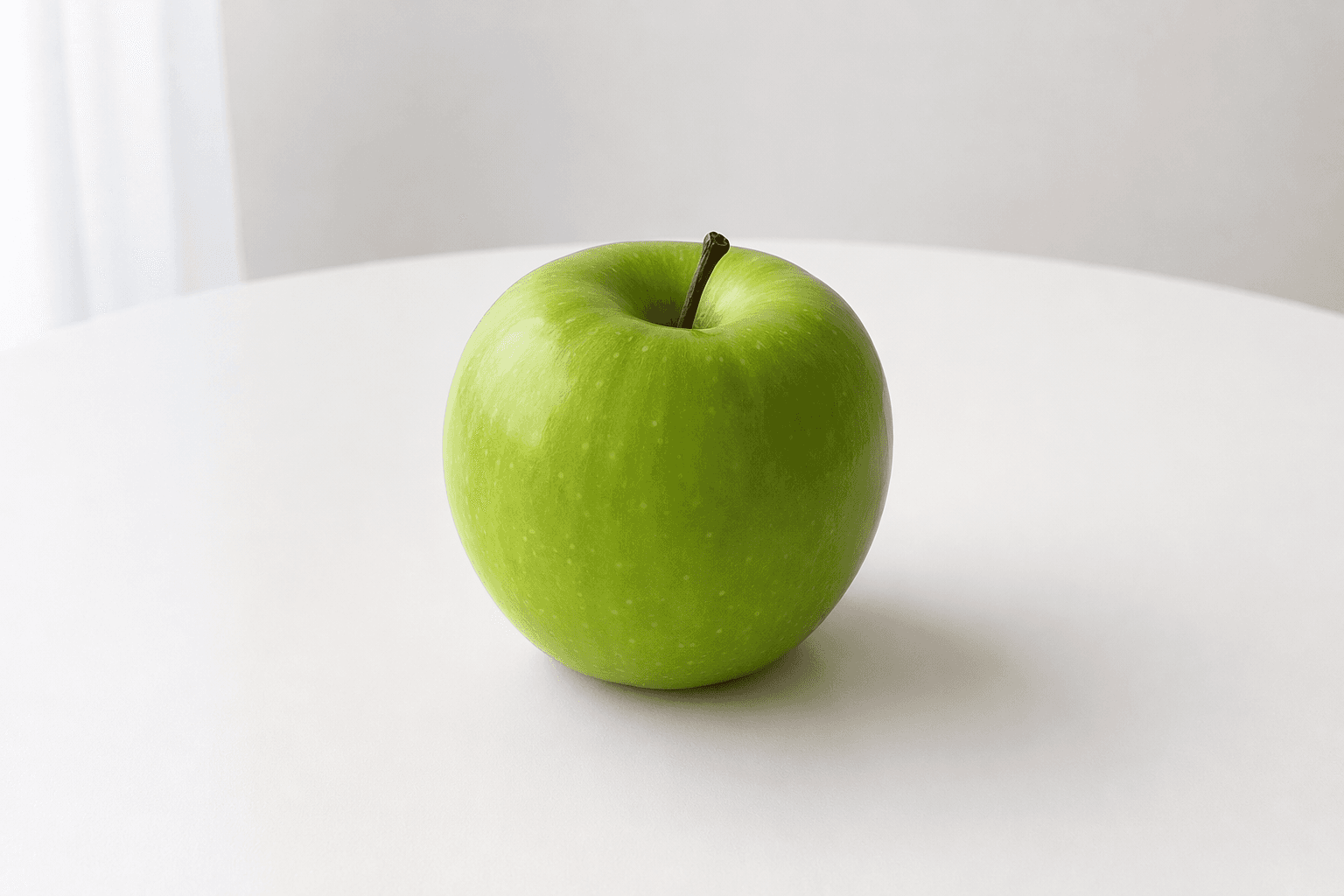

prompt="リンゴを緑色に変えて、それ以外はそのままにしてください",

size="auto",

quality="low",

)

with open("apple_edited.png", "wb") as out:

out.write(base64.b64decode(resp.data[0].b64_json))image フィールドにはローカルファイルパスを渡します(cURL では @ を前置)。URL ではありません。

実際の比較:

| 元画像 | 編集後 |

|---|---|

|  |

パラメータ

| パラメータ | 型 | 必須 | 説明 |

|---|---|---|---|

model | string | ✅ | 推奨は openai/gpt-image-2 |

image | file | ✅ | PNG / JPEG ファイル |

prompt | string | ✅ | 編集指示 |

quality | string | ✅ | low / medium / high |

n | number | — | デフォルト 1 |

size | string | — | auto は元画像と同じサイズ |

レスポンス

生成と同じ構造です:

{

"created": 1777385669,

"data": [

{ "b64_json": "<編集後画像 Base64>", "index": 0 }

],

"model": "openai/gpt-image-2",

"size": "auto",

"quality": "low",

"usage": {

"input_tokens": 1041,

"input_tokens_details": { "image_tokens": 1024, "text_tokens": 17 },

"num_input_images": 1,

"output_tokens": 358,

"total_tokens": 1399

}

}usage.input_tokens_details.image_tokens は入力画像が消費したトークン数、num_input_images は入力画像の枚数です。

対応モデルと料金は モデルカタログ をご覧ください。